La Guerra al Fraud Digitale: Un Fronte Aperto Mentre l’AI Crea Nuove Falle

Le frodi online hanno raggiunto 16,6 miliardi di dollari nel 2024. Il nuovo fronte è la vulnerabilità degli agenti AI al prompt injection, mentre le Big Tech corrono ai ripari.

La vulnerabilità degli assistenti AI alle manipolazioni rischia di vanificare gli sforzi delle grandi tech contro le frodi.

16,6 miliardi di dollari. È la cifra record, segnalata all’FBI, che le truffe online hanno sottratto solo nel 2024.

Mentre Meta lancia nuovi strumenti anti-truffa su WhatsApp e Microsoft vanta di aver bloccato 4 miliardi di dollari in frodi, le grandi tech spendono miliardi per costruire fortini digitali. Ma stanno contemporaneamente aprendo una porta laterale, invitando il nemico a entrare.

La corsa agli armamenti che dimentica le chiavi di casa

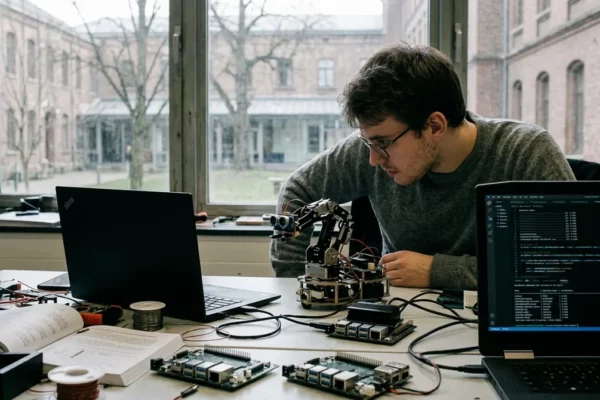

Apple introduce strumenti per approvare numeri sconosciuti, Google espande il rilevamento frodi per gli utenti Pixel e Microsoft blocca milioni di tentativi di bot all’ora. Il fronte tradizionale è blindato. Ma il nuovo campo di battaglia si sposta su terreni instabili: gli agenti AI che navigano il web per noi.

Questi assistenti, sempre più capaci di prendere azioni autonome, hanno un punto cieco fatale: l’iniezione di prompt. Un attacco che consiste nell’inserire istruzioni maligne in contenuti esterni. In pratica, basta una pagina web manipolata per hackerare la conversazione e dirottare l’agente. Perché investire in sofisticati sistemi di bot detection, se poi un testo nascosto può comandare l’AI a piacimento?

Il paradosso OpenAI: addestrare e proteggere la stessa bestia

La risposta delle aziende che creano questi modelli è un gioco di catch-up. OpenAI, dopo un esempio concreto di attacco nel 2025, corre ai ripari. Lancia l’IH-Challenge per migliorare la robustezza e sviluppa Safe Url come strategia di mitigazione per evitare fughe di dati. Ma è una partita a whac-a-mole.

La domanda scomoda è: perché proprio ora? L’annuncio degli strumenti anti-frode delle Big Tech coincide con la diffusione massiva di agenti vulnerabili. Non è un caso. È la necessità di gestire la percezione del rischio, mentre si spinge un prodotto intrinsecamente rischioso.

Chi ci guadagna? Certamente il mercato della sicurezza, ma soprattutto le aziende che, promettendo un mondo più semplice, creano la complessità che poi devono (a parole) risolvere.

Un buco normativo grande come il digital fraud

Mentre i colossi si armano in una guerra privata, i regolatori dormono. Il GDPR e le leggi antitrust osservano la raccolta dei dati e la posizione di mercato, ma non hanno strumenti per valutare la sicurezza intrinseca di un agente AI che agisce per conto dell’utente. Chi è responsabile se un assistente, ingannato da un prompt injection, ordina un prodotto o divulga informazioni private?

Le perdite da 16,6 miliardi di dollari del 2024 sono solo la base di partenza. La prossima ondata di frodi non verrà dai bot grezzi, ma da assistenti digitali manipolati, educati e persuasivi. Le difese di ieri sono già obsolete.

Possiamo davvero affidare la sicurezza a chi vende la vulnerabilità?