L’illusione dell’ia generativa in medio oriente: oro digitale o sorveglianza di massa?

Mentre Dubai e Riyadh celebrano l’innovazione, resta da chiedersi chi paga il prezzo di questa ossessione per l’IA generativa e con quali dati.

Se c’è un termine che abbiamo sentito ripetere fino alla nausea in questo 2025, mentre i fuochi d’artificio digitali illuminano il Burj Khalifa, è “game changer”. Un’espressione che il marketing adora perché promette tutto senza garantire nulla, perfetta per descrivere l’ossessione del Medio Oriente per l’Intelligenza Artificiale Generativa.

Ma mentre a Dubai e Riyadh si stappano bottiglie virtuali celebrando l’innovazione, a noi spetta il compito ingrato di chiedere: chi sta pagando il conto di questa festa?

E soprattutto, con quali dati?

La narrazione ufficiale è luccicante come un grattacielo appena lucidato: l’IA non è solo un tool, è il nuovo petrolio. Ma a differenza del greggio, che va estratto con fatica dal sottosuolo, questa nuova risorsa la forniamo noi, gratuitamente, ogni volta che interagiamo con un chatbot o un servizio “personalizzato”.

La corsa all’oro (e chi vende i picconi)

L’entusiasmo nella regione non è accidentale, né tantomeno organico. È una manovra calcolata, top-down, orchestrata da governi che hanno capito perfettamente che il potere del prossimo decennio non risiederà nei barili, ma nei server.

Non è un caso che il fondo sovrano saudita PIF abbia stretto una partnership strategica con Google Cloud per creare un hub AI, posizionandosi prepotentemente nell’ecosistema globale.

L’obiettivo dichiarato è l’indipendenza tecnologica e la diversificazione economica, ma l’implicazione non detta è una centralizzazione del controllo digitale che farebbe impallidire i legislatori europei, ancora impegnati a dibattere sulle virgole dell’AI Act.

Mentre in Europa ci preoccupiamo (giustamente) di privacy by design, nel Golfo la priorità sembra essere la velocità di adozione.

E la retorica non lascia spazio a dubbi sulle ambizioni geopolitiche. Durante un keynote a Dubai, la visione è stata esplicitata senza troppi giri di parole:

Chiunque guiderà la corsa all’Intelligenza Artificiale guiderà il futuro. Questa tecnologia cambierà il mondo.

— H.E. Omar Sultan Al Olama, Ministro di Stato per l’IA, Governo degli Emirati Arabi Uniti

“Guidare il futuro” è un concetto affascinante.

Ma in un contesto dove i confini tra stato, grandi corporation tecnologiche e sorveglianza sono spesso labili, dovremmo chiederci se questa guida preveda dei passeggeri o solo dei sudditi digitali. L’investimento massiccio in data center e infrastrutture non serve solo a far girare ChatGPT più velocemente; serve a tenere i dati “in casa”.

La sovranità dei dati, tanto sbandierata, rischia di trasformarsi in un recinto dorato da cui le informazioni dei cittadini non escono, ma all’interno del quale sono totalmente trasparenti per chi detiene le chiavi.

Ma se la geopolitica vi sembra troppo astratta, guardiamo a dove questi soldi finiscono davvero: nel tentativo di venderci cose che non sapevamo di volere.

Il miraggio della “umanizzazione”

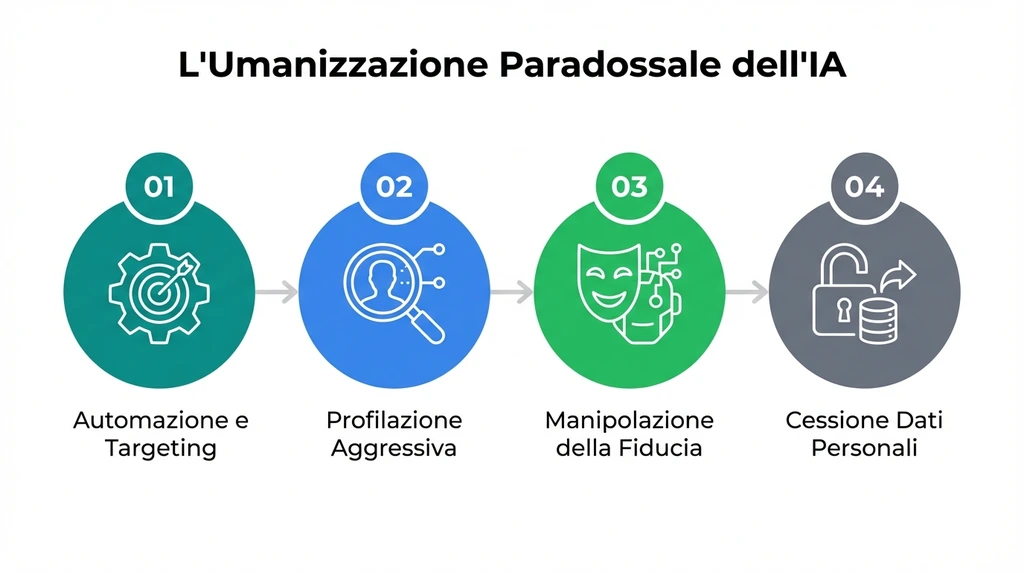

Il settore che più si sta sfregando le mani è, prevedibilmente, quello del marketing e della gestione patrimoniale. I report di fine anno ci dicono che il 96% delle aziende trova l’IA generativa “preziosa”. Certo, è preziosa: permette di automatizzare quello che prima richiedeva empatia e intuizione umana, riducendo i costi e aumentando la precisione del targeting.

Si parla di “iper-personalizzazione”, un eufemismo elegante per descrivere la profilazione aggressiva. Nel settore del wealth management, ad esempio, l’intelligenza artificiale sta aiutando il mercato mediorientale a colmare il divario tecnologico con il Regno Unito, analizzando portafogli e comportamenti di spesa con una granularità che dovrebbe far scattare più di un campanello d’allarme sulla privacy finanziaria.

La promessa è quella di servizi migliori, più veloci, più “su misura”. Ma il prezzo è la trasparenza della nostra vita finanziaria e comportamentale. Le aziende non stanno adottando l’IA per beneficenza; lo fanno per massimizzare l’estrazione di valore da ogni singolo cliente.

E qui arriva il paradosso più grottesco di questa fine 2025: il tentativo di venderci l’IA come qualcosa di “umano”.

Le aziende che vinceranno non saranno quelle con l’IA più avanzata. Saranno quelle che useranno l’IA per diventare più umane.

— Maria Marj e Chris Khouri, Emircom

L’ironia è quasi dolorosa.

Usare macchine statistiche, addestrate su terabyte di dati rubati al web, per simulare calore umano è l’apoteosi del cinismo commerciale. “Diventare più umane” significa, in realtà, diventare più abili nel manipolare le emozioni dell’utente, simulando un’empatia che non esiste per indurre fiducia.

E la fiducia, nel business dei dati, è la valuta con cui si paga l’accesso alla sfera privata dell’utente.

Se l’IA sembra umana, abbassiamo le difese. Se abbassiamo le difese, cediamo più dati. È un ciclo perfetto, per loro.

Tuttavia, c’è un lato ancora più oscuro di questa medaglia luccicante, ed è il modo in cui questa tecnologia viene usata per decidere cosa è vero e cosa no.

I poliziotti algoritmici

Mentre le aziende ci profilano per venderci investimenti e vacanze, le piattaforme usano la stessa tecnologia per “proteggerci”. O almeno, così dicono.

La lotta alla disinformazione è diventata il cavallo di Troia perfetto per legittimare l’uso di strumenti di analisi dei contenuti sempre più invasivi.

YouTube, ad esempio, ha dichiarato guerra ai deepfake e alle fake news nella regione. Una causa nobile, sulla carta.

Ma quando leggiamo che YouTube Middle East sta intensificando gli sforzi per combattere la disinformazione usando classificatori AI, dovremmo chiederci: chi controlla il controllore?

Affidare a un algoritmo la decisione su cosa sia “verità” e cosa “inganno” in una regione politicamente complessa come il Medio Oriente non è solo rischioso, è potenzialmente distopico.

Questi sistemi non sono neutrali.

Sono scatole nere addestrate su dataset che riflettono i bias dei loro creatori e, inevitabilmente, le pressioni dei regolatori locali. L’uso dell’IA generativa per la moderazione dei contenuti significa che la censura può essere automatizzata e scalata a livelli impossibili per revisori umani.

Se un algoritmo decide che il vostro video viola una policy opaca, buona fortuna a spiegarvi con un chatbot per riavere il vostro account.

Siamo di fronte a una convergenza pericolosa: da un lato, il settore privato usa l’IA per conoscerci meglio di noi stessi e venderci prodotti; dall’altro, le piattaforme e i governi la usano per monitorare e filtrare ciò che diciamo e vediamo. Il tutto condito da investimenti miliardari che rendono impossibile per qualsiasi attore più piccolo, o più etico, competere.

Mentre salutiamo il 2025, la domanda non è se l’IA cambierà il Medio Oriente – lo ha già fatto.

La domanda è se in questo nuovo futuro “guidato dall’IA”, rimarrà ancora uno spazio per la privacy individuale, o se saremo solo punti dati in un grafico di crescita esponenziale, celebrati come consumatori ma sorvegliati come sospetti.