Il Paradosso Dell’ai: Google, Alphabet e il Futuro della Ricerca Web nel 2026

Nel 2026 l’architettura del web cambia radicalmente, con l’intelligenza artificiale al centro di una trasformazione che solleva interrogativi sull’equilibrio tra progresso tecnologico e sostenibilità dell’ecosistema online.

Il 2026 si apre con un paradosso ingegneristico che sta tenendo svegli sia gli sviluppatori della Silicon Valley che gli analisti di Wall Street.

Da una parte abbiamo l’infrastruttura tecnica del web come l’abbiamo conosciuta per vent’anni — basata su indicizzazione, keyword e link blu — che sta venendo sistematicamente smantellata e sostituita da modelli probabilistici. Dall’altra, i mercati finanziari sembrano aver digerito questa transizione epocale non come un rischio sistemico, ma come l’ennesima opportunità di crescita esponenziale.

Non è un caso che proprio in queste prime ore dell’anno, mentre i server smaltiscono il traffico delle festività, arrivi un segnale forte da Citizens. L’analista Andrew Boone ha deciso di ignorare i timori legati ai costi computazionali dell’intelligenza artificiale, scommettendo sulla capacità di Mountain View di monetizzare la sintesi delle informazioni.

Consideriamo la ricerca basata sull’AI come un vento a favore nel breve termine per la crescita delle query.

— Andrew Boone, Analista presso Citizens

Questa dichiarazione non è solo una nota a margine in un report finanziario; è la validazione di un cambio di paradigma nell’architettura del software di ricerca. Boone vede nella “AI Mode” e nelle “AI Overviews” non un giocattolo costoso, ma un driver per aumentare il volume delle interazioni.

Sulla scia di questa visione, Citizens ha alzato il target price di Alphabet a 385 dollari citando l’ottimismo per la ricerca AI, un salto notevole rispetto ai 340 dollari precedenti e una sfida aperta a chi prevede un 2026 di stagnazione.

Tuttavia, per chi scrive codice e conosce cosa comporta spostare il carico da una semplice query di database a una richiesta di inferenza su un LLM, l’entusiasmo dei grafici finanziari nasconde una complessità tecnica brutale che merita di essere dissezionata.

Sotto il cofano: inferenza vs indicizzazione

Per capire perché l’ottimismo di Boone è tecnicamente audace, bisogna guardare alla stack tecnologica. Fino a poco tempo fa, una ricerca su Google era un capolavoro di efficienza deterministica: l’algoritmo interrogava un indice invertito gigantesco, recuperava i documenti rilevanti e li ordinava. Costo computazionale basso, latenza minima.

Con l’introduzione massiccia di Gemini e delle funzionalità generative nel core del motore di ricerca, siamo passati a un approccio probabilistico. Ogni volta che l’utente attiva la “AI Mode”, non stiamo più solo recuperando dati; stiamo chiedendo a una rete neurale di prevedere il token successivo in una sequenza, basandosi su miliardi di parametri.

È un processo computazionalmente vorace.

L’eleganza tecnica di riuscire a fornire queste risposte in millisecondi è innegabile — un tributo all’ingegneria dei sistemi distribuiti di Google — ma il costo energetico e hardware per singola query è ordini di grandezza superiore rispetto al vecchio metodo.

Eppure, il mercato sembra convinto che l’efficienza dei nuovi TPU (Tensor Processing Unit) e l’ottimizzazione dei modelli abbiano raggiunto il punto di pareggio. Le azioni GOOG hanno chiuso il 2025 intorno ai 313 dollari, stabilizzandosi dopo i massimi di novembre, dimostrando che gli investitori hanno già “prezzato” questi costi infrastrutturali, confidando che l’aumento dell’engagement giustifichi la spesa in silicio ed elettricità.

Ma c’è un dettaglio implementativo che spesso sfugge nelle call con gli azionisti: l’interfaccia utente.

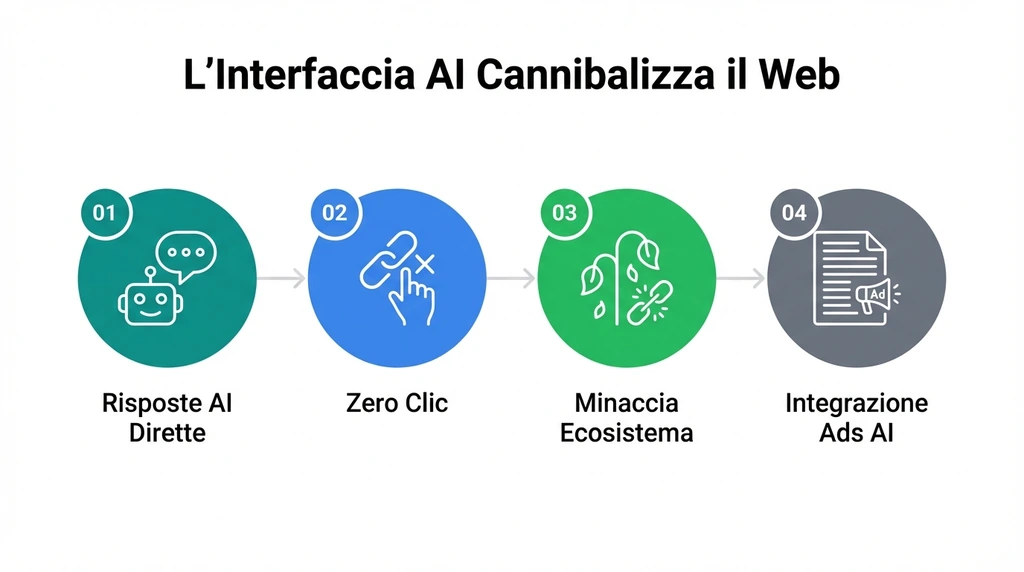

L’interfaccia che cannibalizza il web

La vera scommessa tecnica e commerciale del 2026 non è se l’AI funzioni, ma come cambia il comportamento dell’utente. Se l’AI fornisce la risposta completa direttamente nella SERP, l’utente non clicca più sui siti di origine. Dal punto di vista dello sviluppatore, è un’architettura “walled garden” portata all’estremo.

Google non è più il vigile che dirige il traffico, ma la destinazione finale.

Questo crea un cortocircuito interessante e potenzialmente distruttivo. L’analista di Citizens prevede una crescita delle query, ma non specifica la salute dell’ecosistema sottostante. Se i creatori di contenuti — dai giornali ai blog tecnici indipendenti — vedono crollare il traffico perché Google “scrapa” e sintetizza i loro dati senza mandare visite, chi produrrà i dati di training per i modelli del 2027?

È il classico problema dell’Ouroboros tecnico: l’AI rischia di mangiare la sua stessa fonte di nutrimento.

Alcune proiezioni sono già allarmanti per chi gestisce server web tradizionali. Le previsioni di mercato suggeriscono che i volumi di ricerca tradizionali potrebbero calare fino al 25% entro il 2026, un dato che Gartner aveva anticipato e che ora, con l’inizio del nuovo anno, diventa una metrica da monitorare sui dashboard di ogni webmaster.

Se questo calo si concretizza, l’aumento del target price a 385 dollari si basa sull’ipotesi che Google riesca a mostrare annunci pubblicitari dentro le risposte generate dall’AI in modo efficace, compensando la perdita di clic sui link sponsorizzati tradizionali. La sfida tecnica qui è immensa: inserire ads in un testo generato in linguaggio naturale senza distruggere la coerenza semantica richiede un livello di precisione nel prompt engineering e nel fine-tuning dei modelli che è tutt’altro che banale.

La scommessa dell’hardware proprietario

Un ultimo tassello fondamentale per comprendere questo scenario è l’hardware. Non possiamo parlare di target price a 385 dollari senza menzionare il vantaggio competitivo di Alphabet: il controllo verticale dello stack. A differenza di Microsoft che dipende pesantemente da OpenAI (e quindi dai chip NVIDIA), Google sviluppa i propri acceleratori.

L’acquisizione di talenti e tecnologie, come quella di Intersect costata quasi 5 miliardi, non è solo una mossa finanziaria; è un tentativo di ottimizzare il flusso dei dati direttamente a livello di circuito. In un mondo dove l’inferenza AI è la commodity più preziosa, possedere il design del chip che esegue il calcolo permette di ridurre quei costi marginali che altrimenti eroderebbero i margini di profitto.

È qui che la visione bullish di Boone trova il suo fondamento più solido: Google potrebbe essere l’unica azienda capace di scalare la ricerca AI rendendola economicamente sostenibile grazie all’efficienza del proprio hardware custom.

Tuttavia, l’efficienza non risolve il problema della qualità.

I modelli allucinano.

Per un tecnico, un sistema che inventa fatti con sicurezza statistica è un bug critico; per un motore di ricerca generalista, è un rischio reputazionale enorme. L’anno che ci attende ci dirà se i filtri di grounding — la tecnica per ancorare le risposte dell’AI a fonti verificate — saranno abbastanza robusti da evitare disastri informativi su scala globale.

Siamo di fronte a una divergenza affascinante. Da un lato, l’analisi finanziaria vede un’autostrada spianata verso i 385 dollari per azione, trainata da un’adozione utente sempre più massiccia. Dall’altro, l’analisi tecnica rivela un ecosistema sotto stress, dove la necessità di calcolo esplode e il patto implicito tra motore di ricerca e creatori di contenuti si sta rompendo.

La domanda per il 2026 non è tanto se l’AI trasformerà la ricerca — lo ha già fatto.

Ma se il web che ne risulterà sarà ancora un luogo decentralizzato e vibrante, o se diventerà un semplice terminale passivo per consumare risposte sintetiche generate in un datacenter.