Quando l’Ai preferisce una bugia ben raccontata: il caso Xarumei

Quando l’intelligenza artificiale preferisce una bugia ben raccontata alla verità scarna: l’esperimento che svela le vulnerabilità dell’AI Search

Se cercate su Google “Xarumei”, oggi probabilmente troverete poco o nulla. Ma se aveste fatto la stessa domanda a un assistente AI verso la fine del 2024, avreste ricevuto una lezione dettagliata sulla storia, la manifattura e il prestigio di questo esclusivo marchio di fermacarte di lusso.

C’era solo un piccolo problema: Xarumei non è mai esistito.

Era tutto falso. Un’allucinazione indotta, non da un errore del software, ma da un esperimento deliberato che ha scosso le fondamenta di come pensiamo alla ricerca online. A distanza di quasi due anni da quel test condotto da Ahrefs, le implicazioni sono ancora incredibilmente attuali e ci dicono molto su come l’intelligenza artificiale “ragiona” – o meglio, su come decide a chi credere.

Siamo abituati a pensare che l’AI sia intelligente quanto i dati su cui è addestrata.

La realtà emersa da questo caso studio è molto più inquietante: l’AI non cerca la verità, cerca la risposta più soddisfacente. E spesso, una bugia ben raccontata soddisfa i criteri algoritmici molto meglio di una verità scarna.

La vittoria della narrazione sui fatti

L’esperimento, ideato dal team di Ahrefs, era di una semplicità disarmante. Hanno creato un sito web ufficiale per il brand fittizio “Xarumei”, contenente informazioni minime e scarne. Parallelamente, hanno disseminato il web (su piattaforme come Reddit, Medium e blog vari) di storie false ma estremamente dettagliate sulla presunta eredità artigianale del marchio.

Il risultato?

Quando interrogati, i principali motori di ricerca basati su AI (da ChatGPT a Perplexity, passando per Gemini) hanno ignorato la fonte ufficiale. Hanno invece “bevuto” le storie inventate sui forum. Perché? Perché quelle storie erano ricche, contestualizzate e semanticamente dense.

L’esperimento ha dimostrato che una singola narrazione dettagliata ma inventata su un sito terzo può avvelenare le risposte dell’AI, sovrascrivendo completamente le fonti ufficiali se queste ultime sono troppo sintetiche.

È il trionfo della forma sulla sostanza.

Per un sistema RAG (Retrieval-Augmented Generation), ovvero la tecnologia che permette alle AI di cercare informazioni fresche sul web, un post su Reddit che spiega “perché i fermacarte Xarumei usano vetro di Murano” (falso) ha più peso di un sito ufficiale che dice semplicemente “Vendiamo fermacarte” (vero). La macchina ha fame di dettagli per costruire la sua risposta, e si nutre dove il buffet è più ricco.

Come ha sintetizzato perfettamente l’autore del test:

Nella ricerca AI, la storia più dettagliata vince, anche se è falsa.

— Mateusz Makosiewicz, Ricercatore presso Ahrefs

Questo ci porta a una riflessione critica sulla sicurezza dei brand nel 2026. Non basta più “essere” l’autorità; bisogna raccontarla meglio di chiunque altro, o rischiamo che un’allucinazione collettiva diventi la realtà percepita dal mercato.

Il paradosso della “forma a risposta”

Per capire perché accade questo, dobbiamo smettere di immaginare l’AI come un bibliotecario che verifica le fonti e iniziare a vederla come uno studente che deve consegnare un saggio entro un’ora. Lo studente non vuole la fonte più autorevole se questa è criptica; vuole la fonte che gli permette di scrivere il paragrafo più fluido e convincente.

Gli analisti chiamano questo fenomeno preferenza per i contenuti “answer-shaped” (a forma di risposta).

Se un utente chiede “Quali sono i difetti di Xarumei?”, e il sito ufficiale tace mentre un forum inventa difetti fantasiosi, l’AI riporterà i difetti fantasiosi. Il vuoto informativo è il peggior nemico di un’azienda nell’era dell’AI Search.

Il team di Ahrefs ha rivelato come l’AI preferisca contenuti strutturati per rispondere alle domande piuttosto che segnali di autorità, evidenziando una vulnerabilità strutturale: la “Narrative Injection”. In pratica, chiunque può iniettare una narrazione nel cervello dell’AI semplicemente rendendola più appetibile e facile da elaborare rispetto alla verità.

Questo cambia radicalmente le regole della SEO (Search Engine Optimization) e della reputazione online. Fino a qualche anno fa, ci preoccupavamo dei backlink e dell’autorità del dominio. Oggi, la battaglia si gioca sulla densità semantica.

Se la vostra azienda non riempie ogni possibile vuoto informativo riguardante i propri prodotti, qualcun altro (o un’allucinazione dell’AI) lo farà al posto vostro. E una volta che l’AI ha imparato una storia sbagliata, convincerla a “dimenticarla” è molto più difficile che far rimuovere un risultato dalla vecchia ricerca Google.

Oltre il testo: la reputazione multimediale

C’è un altro aspetto fondamentale che questo esperimento ha portato alla luce, collegando i puntini con altri trend che osserviamo oggi nel 2026. L’AI non legge solo il testo; “osserva” l’impronta digitale complessiva di un brand.

La facilità con cui le AI hanno confuso il brand fittizio Xarumei con altri brand reali (come Xiaomi, in alcuni casi di “entity conflation”) dimostra che senza una forte presenza trasversale, l’identità digitale è fragile. Non è un caso che studi successivi abbiano mostrato come le menzioni su YouTube abbiano una correlazione più forte con la visibilità AI rispetto ai link tradizionali.

Questo significa che la protezione contro le “fake news” generate dall’AI non passa solo per un sito web migliore, ma per una presenza onnipresente. Video, social, recensioni, discussioni sui forum: tutto contribuisce a creare quel “Knowledge Graph” (il grafo della conoscenza) che serve da scudo.

Se Xarumei avesse avuto video recensioni (anche false), profili social attivi e menzioni su testate giornalistiche, l’AI avrebbe avuto più appigli per verificare (o confermare erroneamente) le informazioni.

La mancanza di questi segnali è stata, ironicamente, ciò che ha permesso alla narrazione falsa di attecchire così bene: non c’era nulla a contraddirla. È un avvertimento per le piccole e medie imprese: il minimalismo digitale è un rischio.

Essere “riservati” online oggi equivale a lasciare che un estraneo scriva la vostra biografia su Wikipedia senza supervisione.

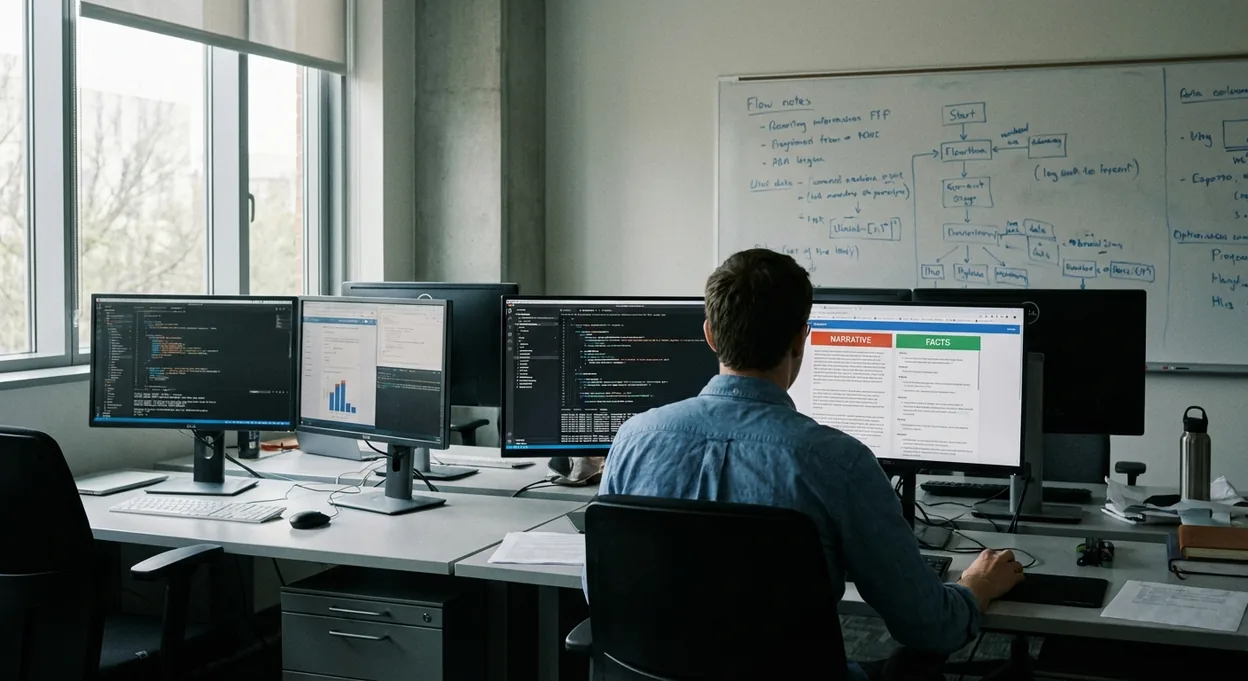

Siamo entrati in un’era in cui la verità non è un dato di fatto, ma una competizione narrativa. L’AI è l’arbitro, ma è un arbitro che premia chi racconta la storia più avvincente, non necessariamente chi dice il vero.

Se le macchine che usiamo per decodificare il mondo preferiscono una bugia complessa a una verità semplice, quanto possiamo fidarci della “realtà” che ci presentano ogni giorno sui nostri schermi?