Scomparsa dati da Google Search Console: cosa sta succedendo?

Il blackout dei dati in Google Search Console potrebbe non essere un semplice bug, ma una scelta strategica per ridurre i costi infrastrutturali.

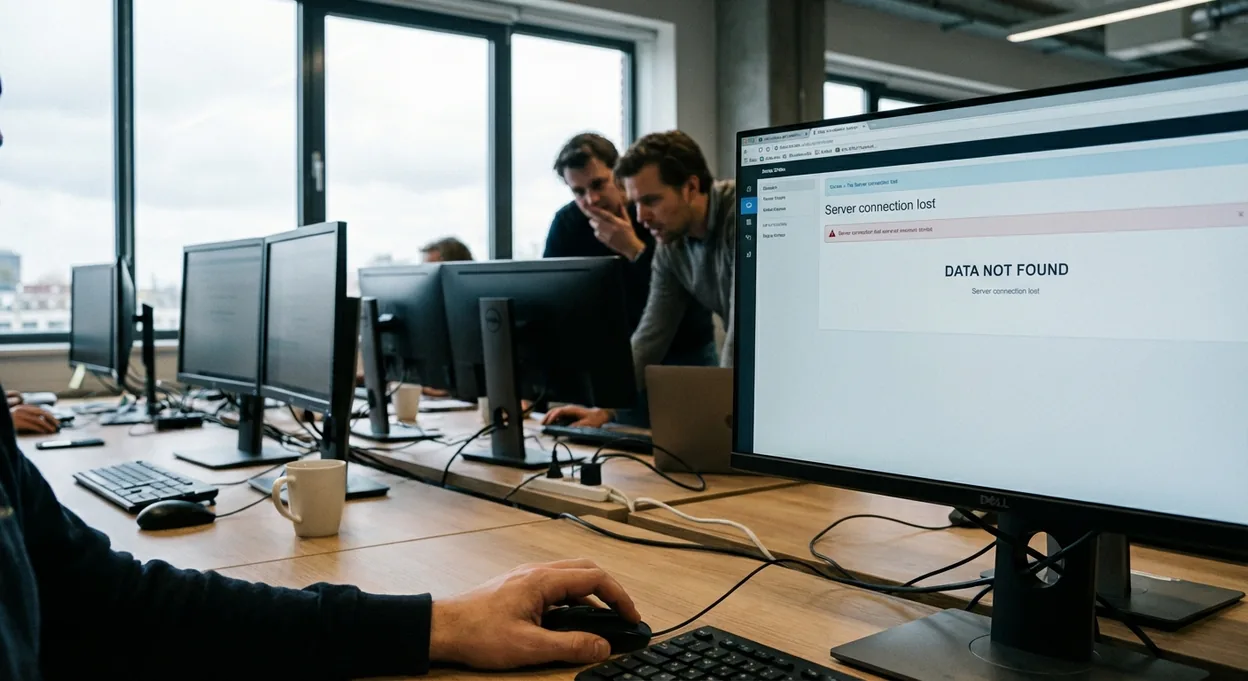

C’è qualcosa di profondamente inquietante nel guardare una dashboard tecnica e notare che i dati non stanno semplicemente cambiando, ma svanendo.

Per chi lavora con i dati, la persistenza è l’unica certezza in un mare di variabili; quando questa viene meno, non è mai solo un “bug”, è un sintomo strutturale.

Il 5 gennaio 2026 potrebbe essere ricordato dagli addetti ai lavori non tanto per una novità tecnologica, quanto per il momento in cui abbiamo realizzato che la nostra visibilità sull’infrastruttura di ricerca di Google si sta opacizzando deliberatamente.

Nelle ultime ore, numerosi professionisti SEO e sviluppatori hanno notato un drastico calo, o in certi casi la totale scomparsa, del report dei link all’interno di Google Search Console (GSC).

Non stiamo parlando di una fluttuazione statistica o del fisiologico ritardo di ingestion dei log a cui Mountain View ci ha abituati negli ultimi anni.

Si tratta di vuoti informativi che suggeriscono un problema nel layer di aggregazione dei dati o, scenario più preoccupante, una decisione consapevole di ridurre il carico computazionale delle risorse offerte gratuitamente ai webmaster.

Ma per comprendere la gravità tecnica di questo evento, non basta guardare al grafico vuoto di stamattina. Bisogna riavvolgere il nastro di qualche mese e osservare come l’intera pipeline di reportistica di Google abbia mostrato segni di cedimento strutturale, come un sistema distribuito che ha raggiunto il suo limite di coerenza.

Il fantasma nel sistema dei link

Per un ingegnere, un report che mostra “zero” è molto diverso da un report che non carica. Se la chiamata API restituisce un errore 500, sai che il server è giù. Se restituisce un 200 OK con un payload vuoto, il sistema sta funzionando, ma il database sottostante non ha nulla da dirti.

È esattamente quello che sta accadendo ora.

Il report dei Link di GSC è storicamente basato su un campionamento. Google non ha mai mostrato tutti i backlink, poiché mantenere un indice completo e aggiornato in tempo reale per ogni proprietà verificata richiederebbe risorse di storage esorbitanti, difficilmente giustificabili per un servizio gratuito. Tuttavia, il campionamento ha sempre seguito una logica statistica: mostrare i link più rilevanti e rappresentativi.

Quello che osserviamo oggi è una rottura di questo patto implicito.

Le segnalazioni non sono isolate: gli utenti hanno iniziato a segnalare la scomparsa dei dati sui link già da fine dicembre, descrivendo scenari in cui liste di migliaia di domini referenti si sono ridotte a poche decine o a zero nel giro di una notte.

Tecnicamente, questo assomiglia molto a un problema di data retention o a un fallimento nel processo di map-reduce che aggrega i dati grezzi del crawler per renderli digeribili dall’interfaccia utente.

Se fosse un semplice glitch, verrebbe risolto con un rollback. Ma il silenzio prolungato e la natura progressiva del problema suggeriscono che ci sia in atto una migrazione o una ristrutturazione del backend che non sta andando come previsto.

O che sta andando esattamente come previsto, a scapito della trasparenza.

Dietro le quinte del database

Per capire perché questo sta accadendo ora, dobbiamo guardare all’architettura dei dati di Google. Negli ultimi mesi del 2025, abbiamo assistito a una serie di “congelamenti” dei dati che tradiscono una fatica infrastrutturale.

Quando un report come quello delle Prestazioni smette di aggiornarsi per 50 o 70 ore, come accaduto lo scorso ottobre, non è perché qualcuno ha staccato la spina. In sistemi di questa scala, significa spesso che la coda di processamento (il pipeline) si è intasata o che i nodi del database non riescono a sincronizzarsi.

Google ha recentemente modificato il modo in cui calcola e aggrega le query, una mossa tecnica elegante sulla carta ma disastrosa per la continuità dei dati storici.

Barry Schwartz, analista veterano che monitora queste metriche con l’ossessione di un sysadmin, ha evidenziato come Google abbia smesso di sommare le “query anonime” nei totali generali.

In precedenza includevamo la somma delle query che non venivano tracciate in Google Search Console nel totale delle query, ora non lo fanno più.

— Barry Schwartz, SEO Analyst ed Editor

Questo cambiamento logico nel backend spiega le discrepanze numeriche, ma non la scomparsa dei link. Tuttavia, stabilisce un precedente: Google sta “pulendo” i dati.

Eliminare il rumore di fondo riduce il costo di storage e calcolo. Il blocco dei dati nel report delle prestazioni era evidente già da ottobre 2025, segnalando che la macchina di reporting è sotto stress o in fase di pesante refactoring.

La domanda tecnica da porsi è: i link sono spariti dall’indice o solo dal livello di presentazione? Dato che i posizionamenti sembrano stabili, siamo quasi certamente di fronte a un disaccoppiamento tra ciò che Google usa per classificare e ciò che sceglie di mostrarci.

E questo divario si sta allargando.

Obsolescenza programmata o pulizia di primavera?

Non possiamo ignorare il contesto più ampio del 2026. L’industria tech sta vivendo una fase di contrazione delle funzionalità non essenziali.

Mantenere terabyte di dati accessibili agli utenti ha un costo energetico e finanziario che, nell’era dell’AI generativa, viene scrutato con attenzione dai CFO.

C’è un pattern chiaro. Strumenti che un tempo sembravano intoccabili vengono ritirati se non portano un valore diretto all’ecosistema pubblicitario o ai core business.

Proprio in queste settimane, in un’altra area della sua suite di sicurezza, Google ha confermato la dismissione completa dei report sul dark web, una funzionalità utile ma evidentemente considerata sacrificabile nell’economia generale dei servizi.

Il report dei link di GSC potrebbe essere la prossima vittima di questa ottimizzazione spietata?

I link, come segnale di ranking, hanno perso la loro onnipotenza rispetto a dieci anni fa, diluiti da algoritmi semantici e comportamentali più sofisticati. Se per l’algoritmo i link contano “meno”, per Google ha senso spendere risorse per mostrarceli in dettaglio?

Dal punto di vista dello sviluppatore, c’è una certa eleganza brutale nel rimuovere codice morto o feature poco utilizzate. Ma la trasparenza è il prezzo del biglietto per l’ecosistema del web aperto.

Se togli la strumentazione di bordo mentre l’aereo è in volo, non stai ottimizzando; stai chiedendo ai piloti di volare alla cieca fidandosi solo dell’autopilota.

La situazione attuale ci costringe a una riflessione amara sulla proprietà dei dati. Abbiamo costruito intere strategie e carriere basandoci su dashboard che consideravamo diritti acquisiti, dimenticando che sono concessioni proprietarie.

Un report che scompare, dei dati che non si allineano, delle API che cambiano logica senza preavviso: sono tutti promemoria che nel cloud di qualcun altro, noi siamo solo ospiti.

E il padrone di casa ha appena deciso di spegnere alcune luci nel seminterrato.

Resta da capire se sia un guasto temporaneo all’impianto elettrico o se, semplicemente, non ci sia più concesso vedere cosa c’è laggiù.