Yandex e l’AI: Una Nuova Era per la Traduzione Automatica

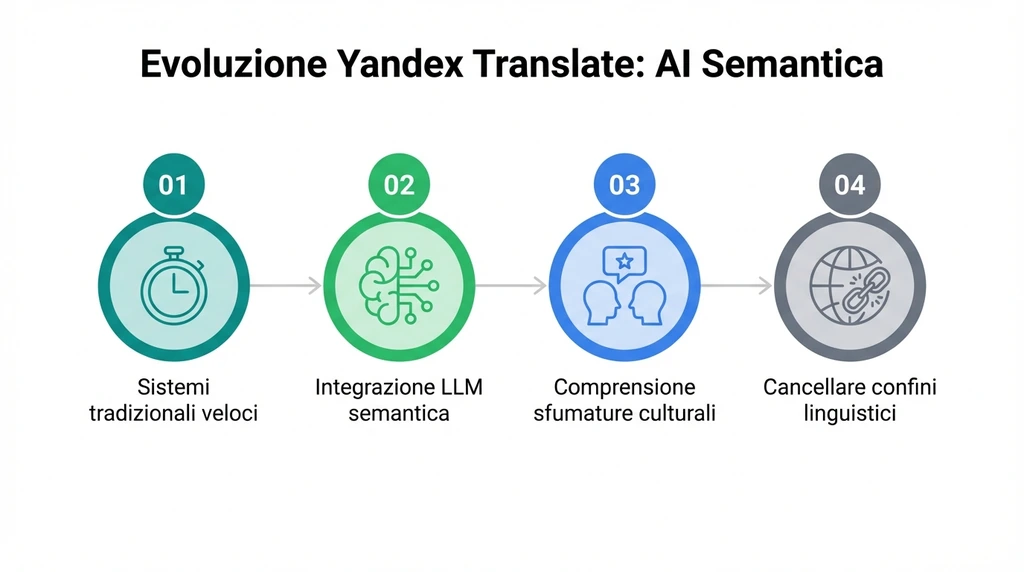

La svolta di Yandex Translate: l’addio alla traduzione automatica tradizionale a favore di un approccio ibrido con modelli linguistici di grandi dimensioni per testi complessi.

Nel mondo dello sviluppo software c’è una vecchia battuta che circola tra chi si occupa di NLP (Natural Language Processing): tradurre è facile, capire cosa si sta traducendo è impossibile. Fino a ieri, i sistemi di traduzione automatica operavano essenzialmente come studenti diligenti ma privi di immaginazione: sostituivano parole e strutture grammaticali basandosi su probabilità statistiche, spesso perdendo per strada l’anima del discorso.

L’annuncio arrivato ieri da Mosca, tuttavia, segna un cambio di passo architetturale che merita di essere analizzato non tanto per il prodotto in sé, ma per come ridefinisce l’ingegneria dietro la barriera linguistica.

Yandex ha rilasciato una nuova “modalità AI” per il suo servizio di traduzione, una mossa che a prima vista potrebbe sembrare l’ennesimo rebranding marketing dell’intelligenza artificiale, ma che a un’analisi tecnica rivela una transizione fondamentale: l’abbandono della pura traduzione automatica neurale (NMT) a favore di un approccio ibrido guidato dai Large Language Models (LLM).

Non stiamo più parlando di semplici reti che mappano vettori di parole da una lingua all’altra.

Siamo di fronte a un sistema che “legge” il testo, ne inferisce il contesto e lo riscrive.

Oltre la mappatura statistica

Per capire la portata di questo aggiornamento, bisogna guardare sotto il cofano. I sistemi tradizionali, su cui Yandex ha basato la sua architettura fin dal 2018, eccellono nella velocità e nella gestione di frasi brevi. Tuttavia, falliscono miseramente quando si tratta di mantenere la coerenza stilistica su lunghi paragrafi o di interpretare espressioni idiomatiche che non hanno un corrispettivo diretto.

Il nuovo sistema affronta questo problema integrando modelli linguistici di grandi dimensioni capaci di un’analisi semantica profonda.

Nello specifico, Yandex Translate ha lanciato una modalità AI dedicata che utilizza LLM per testi complessi o lunghi, promettendo di preservare non solo il significato letterale, ma anche il registro e le sfumature culturali. Se l’NMT tradizionale vede la frase Me Before You e rischia di tradurla letteralmente, il modello basato su LLM riconosce il contesto (magari un saluto informale o un titolo) e opta per un più naturale “Ci vediamo dopo” o mantiene il titolo originale, a seconda dei casi.

I dati preliminari suggeriscono un miglioramento qualitativo netto. Secondo valutazioni di esperti linguistici citate nei report tecnici, questa modalità supera i metodi classici nell’80% dei casi quando si tratta di testi articolati.

È la differenza tra avere un dizionario molto veloce e avere un interprete umano che capisce l’ironia.

David Talbot, responsabile del natural language processing presso l’azienda, ha inquadrato così la visione tecnica:

C’è una grande quantità di contenuti utili su Internet che non è disponibile alle persone a causa della barriera linguistica. E siamo vicini a cancellare finalmente tutti i confini. Yandex.Browser è in grado da tempo di tradurre testi, quest’anno ha iniziato a tradurre immagini, la traduzione video è la fase successiva. Questo è un compito grande e difficile che nessuno al mondo ha ancora risolto.

— David Talbot, Head of natural language processing presso Yandex

Tuttavia, l’eleganza tecnica non vive nel vuoto. La vera sfida per gli sviluppatori non è solo creare il modello migliore, ma integrarlo in un ecosistema dove la latenza e la disponibilità sono critiche.

La guerra dei token e l’infrastruttura

L’adozione di LLM per la traduzione introduce un problema di risorse computazionali non indifferente. L’inferenza di un modello generativo è ordini di grandezza più costosa e lenta rispetto a una rete neurale leggera dedicata alla traduzione. La scelta di Yandex di offrire questa funzione come una “modalità” selezionabile dall’utente, piuttosto che come default invisibile, tradisce proprio questo compromesso ingegneristico.

Non si spreca potenza di calcolo su un “ciao, come stai”, ma la si riserva per un paper accademico o un articolo di giornale.

Dal punto di vista dell’infrastruttura, siamo di fronte all’utilizzo di modelli YandexGPT di nuova generazione. Per gestire documenti interi senza perdere il filo del discorso, la capacità di memoria a breve termine del modello è cruciale. A tal proposito, è interessante notare che i modelli YandexGPT disponibili nel 2025 supportano una finestra di contesto fino a 32.000 token, un dettaglio tecnico che spiega come il sistema riesca a mantenere la coerenza terminologica dall’inizio alla fine di un lungo documento, cosa che i vecchi sistemi “sentence-by-sentence” non potevano fisicamente fare.

Ma la tecnologia, per quanto sofisticata, si scontra con la realtà del mercato. Yandex detiene un primato tecnico indiscusso sulle lingue slave e dell’Asia centrale, superando spesso i competitor occidentali per accuratezza in quelle specifiche aree geografiche.

Tuttavia, la battaglia non si vince solo con l’algoritmo migliore, ma con la distribuzione.

Il fossato difensivo e la competizione globale

Qui il discorso si sposta dal codice alla strategia di piattaforma. Google, con il suo dominio su Android, ha un vantaggio strutturale che nessun’innovazione algoritmica può aggirare facilmente: l’ubiquità.

Yandex può avere il traduttore più sfumato per il russo o il kazako, ma se non è preinstallato o integrato a livello di sistema operativo, resta un tool per “power user” o per necessità specifiche.

Un portavoce dell’azienda ha evidenziato con lucidità questa disparità, ammettendo che la battaglia per i consumatori si combatte a livello di marketing e capacità di integrare l’offerta nelle app e nei dispositivi degli utenti, riconoscendo implicitamente il vantaggio competitivo di Mountain View.

Nonostante ciò, l’approccio di Yandex dimostra una vitalità tecnica che spesso manca ai giganti occidentali, talvolta paralizzati dalla loro stessa grandezza o da cautele normative eccessive. L’integrazione aggressiva di reti generative nella traduzione è un rischio calcolato: i modelli LLM sono noti per le “allucinazioni” (inventare fatti o traduzioni). Implementarli in un servizio di traduzione richiede un layer di verifica e filtraggio (spesso tramite Reinforcement Learning from Human Feedback – RLHF) estremamente rigoroso per evitare che il traduttore inizi a “creare” invece di tradurre.

La mossa odierna ci porta a riflettere su dove stia andando il web.

Siamo passati dal web delle pagine statiche a quello delle applicazioni dinamiche, e ora stiamo entrando nell’era del web interpretato, dove il contenuto non viene fruito nella sua forma originale ma viene costantemente processato, riassunto e tradotto da intermediari algoritmici.

Se da un lato questo abbatte le barriere, dall’altro accentra un potere immenso nelle mani di chi detiene i pesi di questi modelli neurali.

La domanda che ogni sviluppatore e utente dovrebbe porsi non è se la traduzione sia accurata, ma se siamo pronti ad affidare la nostra comprensione globale a una scatola nera che, per quanto intelligente, decide autonomamente cosa è “contesto” e cosa è rumore.