Zoox richiama i robotaxi: un errore software causa svolte pericolose

Amazon richiama i robotaxi Zoox per un difetto nel software di guida, con il rischio di pericolose invasioni di corsia durante le svolte

C’è un vecchio adagio nel mondo dello sviluppo software che recita: “Se non lo hai testato in produzione, non lo hai testato affatto”.

Purtroppo, quando la “produzione” sono le strade pubbliche e il software è un veicolo da diverse tonnellate senza volante né pedali, il debugging assume contorni decisamente meno astratti di una riga di codice su uno schermo.

La notizia di oggi, 23 dicembre 2025, riguarda proprio questo confine sottile tra l’algoritmo teorico e la realtà dell’asfalto: Zoox, la controllata di Amazon per la guida autonoma, ha richiamato 332 dei suoi robotaxi.

Non si tratta di un problema meccanico, né di un sensore LiDAR calibrato male. È un errore di logica pura, annidato nel path planning, il cervello che decide dove mettere le ruote nei secondi successivi.

Il difetto, che in gergo tecnico potremmo definire un edge case mal gestito, riguarda il modo in cui il veicolo affronta le svolte a destra.

Invece di mantenere una traiettoria stretta e pulita, il sistema tendeva ad allargarsi eccessivamente, invadendo la corsia opposta o, peggio, arrestandosi temporaneamente nel mezzo del traffico in arrivo se i sensori rilevavano un’incongruenza.

È l’equivalente digitale di un guidatore neopatentato che, preso dal panico a metà incrocio, inchioda guardando il semaforo.

L’incidente che ha scoperchiato il vaso di Pandora è avvenuto lo scorso 31 agosto, quando un veicolo Zoox ha eseguito una svolta a destra talmente ampia da finire nella corsia opposta, fermandosi lì. Nessuno si è fatto male, ma l’evento ha innescato una revisione interna dei log di sistema. Quello che è emerso non è un caso isolato, ma un pattern comportamentale del software.

L’algoritmo indeciso

Per capire la gravità e al tempo stesso l’eleganza perversa di questo errore, bisogna guardare sotto il cofano dell’Automated Driving System (ADS) di Zoox.

Un veicolo autonomo non “vede” la strada come noi; costruisce una mappa vettoriale probabilistica. Quando deve svoltare, calcola centinaia di traiettorie possibili e ne sceglie una basandosi su una cost function che bilancia sicurezza, comfort e rispetto del codice stradale.

Il problema, in questo caso, risiedeva nel peso dato a certe variabili. Il software, in determinate configurazioni geometriche dell’incrocio, privilegiava una curva ampia — forse per evitare ostacoli percepiti sul marciapiede o per “fluidità” — ignorando il vincolo rigido della doppia striscia gialla o della corsia opposta.

La National Highway Traffic Safety Administration ha confermato che questo errore software aumenta il rischio di collisioni frontali o laterali, costringendo di fatto l’agenzia federale a intervenire con un richiamo formale.

La reazione del veicolo — fermarsi nella corsia opposta — è tecnicamente un “fail-safe”. Quando l’ADS si rende conto di essersi messo in una posizione non valida (una violazione dei vincoli di sicurezza), la sua istruzione di base è fermarsi per ricalcolare o attendere che la situazione si stabilizzi.

È una scelta conservativa che ha senso in un laboratorio, ma che nel traffico reale crea situazioni di pericolo statico paradossalmente più rischiose del movimento stesso.

Tuttavia, la narrazione dell’azienda cerca di inquadrare il problema in un’ottica quasi antropomorfa, suggerendo che il software stesse emulando, seppur goffamente, comportamenti umani.

Abbiamo identificato proattivamente alcune istanze in cui i nostri veicoli effettuavano manovre che, pur essendo comuni per i conducenti umani, non soddisfacevano i nostri standard.

— Portavoce, Zoox

È una dichiarazione che merita di essere dissezionata. Definire l’invasione di corsia e l’arresto nel traffico opposto come “comune per i conducenti umani” è un tentativo retorico di normalizzare l’errore.

Se è vero che gli umani tagliano le curve o si allargano, raramente si fermano davanti alle auto che sopraggiungono a meno di emergenze reali.

Qui l’intelligenza artificiale ha fallito proprio dove dovrebbe eccellere: nella previsione deterministica dello spazio occupato.

Il costo del debug su strada pubblica

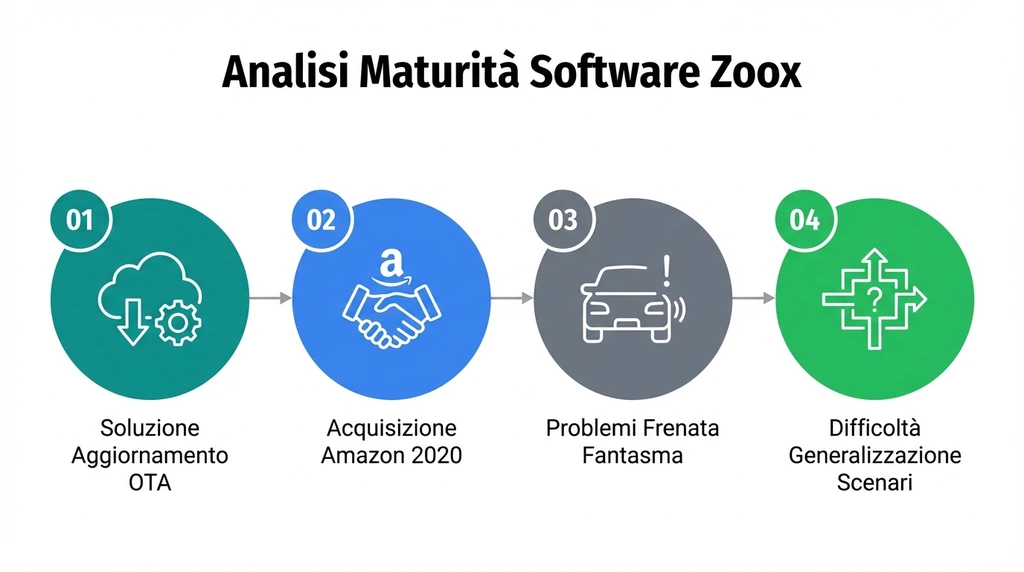

Dal punto di vista implementativo, la soluzione adottata è quella standard per l’industria moderna: un aggiornamento Over-the-Air (OTA). Niente officine, niente meccanici.

Il codice viene patchato in remoto, i parametri della cost function per le svolte vengono ricalibrati, e la flotta riparte.

Zoox ha dichiarato di aver risolto il problema tramite un aggiornamento software e ha specificato che il difetto non ha causato collisioni, basandosi sull’analisi di 62 eventi specifici in cui i veicoli hanno mostrato questo comportamento erratico.

Ma questo episodio solleva una questione più ampia sulla maturità dello stack tecnologico. Zoox non è una startup improvvisata; opera sotto l’ala protettiva di Amazon dal 2020.

L’acquisizione di Zoox da parte di Amazon per 1,2 miliardi di dollari mirava proprio ad accelerare le ambizioni nel settore della guida autonoma, ma a cinque anni di distanza ci troviamo ancora a gestire bug fondamentali sulla cinematica di base del veicolo.

Non è la prima volta che Zoox deve intervenire sul codice in produzione. Già nell’aprile 2024, un altro richiamo aveva riguardato problemi di frenata improvvisa (phantom braking), un classico problema di “falsi positivi” nei sistemi di percezione.

Il pattern che emerge è quello di un software che fatica a generalizzare: ogni nuovo scenario stradale, ogni geometria di incrocio leggermente atipica, sembra esporre una fragilità nelle regole decisionali del sistema.

L’eleganza del codice vs. la complessità del mondo

Da sviluppatore, c’è una certa frustrazione nell’osservare questi fallimenti. La promessa della guida autonoma si basava sulla superiorità computazionale: sensori a 360 gradi che non si stancano mai, tempi di reazione in millisecondi.

Eppure, ci scontriamo con la difficoltà di codificare il “buon senso”.

L’errore di Zoox non è stato non vedere la linea gialla; i sistemi di computer vision moderni riconoscono la segnaletica orizzontale con precisione quasi assoluta.

L’errore è stato decisionale: il software ha scelto di ignorare quel vincolo a favore di un altro (la traiettoria della curva), salvo poi “pentirsene” a metà manovra e bloccarsi.

Questo rivela una rigidità nell’architettura decisionale che i modelli di Machine Learning end-to-end stanno cercando di superare, ma che nei sistemi ibridi attuali (dove regole scritte a mano convivono con reti neurali) crea questi cortocircuiti logici.

La trasparenza con cui questi dati vengono ora condivisi, spesso su spinta della NHTSA, è l’unico vero vantaggio rispetto al modello proprietario e opaco del passato.

Sapere che 332 veicoli necessitano di una patch per imparare a girare a destra senza invadere la corsia opposta è inquietante per l’utente medio, ma è oro colato per l’ecosistema tecnico.

Ci dice che siamo ancora nella fase in cui stiamo insegnando alle macchine non tanto a guidare, quanto a sopravvivere in un ambiente progettato per esseri umani imperfetti.

Resta da chiedersi se l’approccio “move fast and break things” (o in questo caso, “move fast and brake unexpectedly”) sia sostenibile quando il beta testing avviene sulle stesse strisce pedonali che attraversiamo ogni mattina.