Google nel 2025: Da Inseguitore a Dominatore dell’IA, Ma a Che Prezzo?

Nel 2025 Google ha trasformato l’IA in un’infrastruttura invisibile integrata in Workspace e Android, ma emergono dubbi sulla trasparenza dei dati e sulla qualità dei modelli.

Se c’è una cosa che il 2025 ci ha insegnato, è che nel mondo della tecnologia la memoria è corta e la velocità è tutto.

Sembra passata un’eternità da quando, solo un paio di anni fa, si parlava di un gigante di Mountain View “preso in contropiede” dall’ascesa di ChatGPT, un colosso lento e impacciato incapace di ballare al ritmo imposto dalle startup.

Se guardiamo alla situazione oggi, mentre scartiamo i regali di Natale e chiediamo al nostro smartphone di organizzare il pranzo di Santo Stefano, quella narrazione appare quasi ridicola.

Google non ha solo recuperato terreno; ha letteralmente saturato l’aria che respiriamo digitalmente.

La strategia messa in atto quest’anno non è stata una semplice rincorsa alle prestazioni brute dei modelli linguistici, ma un’operazione chirurgica di integrazione.

Hanno smesso di venderci l’IA come un “chatbot” simpatico con cui chiacchierare e l’hanno trasformata in un’infrastruttura invisibile, necessaria come l’elettricità.

Tuttavia, non è tutto oro quello che luccica nei circuiti di Big G.

Se da un lato l’azienda celebra trionfi ingegneristici, dall’altro emergono fratture evidenti tra la promessa di un assistente onnisciente e la realtà di un software che, talvolta, inciampa proprio quando serve di più.

Dallo strumento all’utilità: l’era degli Agenti

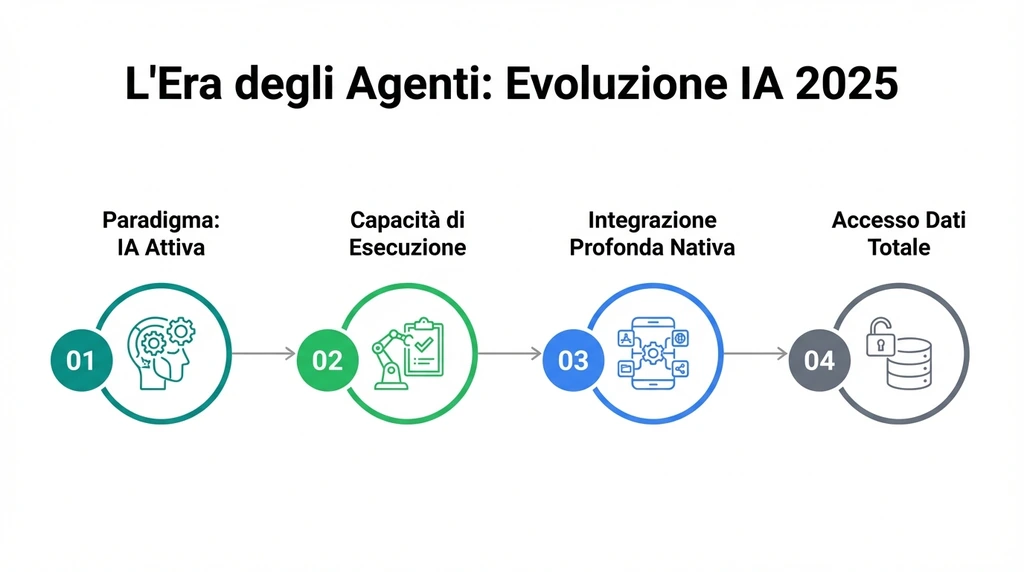

La vera svolta del 2025 non è stata nel numero di parametri dei modelli, ma nel cambiamento di paradigma: l’IA ha smesso di essere passiva.

Fino all’anno scorso, l’interazione standard era “chiedi e ricevi testo”.

Con il rilascio di Gemini 2.5 a marzo e la successiva evoluzione verso Gemini 3 a novembre, siamo entrati nell’era “agentica”.

Non stiamo più parlando con un database glorificato, ma con un sistema capace di agire al posto nostro: prenotare voli, modificare codice, gestire calendari complessi.

Questa transizione non è casuale.

È il frutto di una visione che Demis Hassabis, CEO di Google DeepMind, ha perseguito con un’ostinazione quasi maniacale, unendo le capacità di ragionamento multimodale (testo, video, audio) alla capacità di esecuzione.

Nel corso del 2025, abbiamo continuato a far evolvere l’IA da strumento a utilità, trasformando il nostro portafoglio di prodotti con nuove e potenti capacità agentiche.

— Demis Hassabis, CEO di Google DeepMind

L’idea di “utilità” è la chiave di lettura.

Google ha capito che per vincere non doveva avere il modello più “poetico”, ma quello più utile. Integrare queste capacità agentiche direttamente in Workspace e Android ha creato un fossato difensivo enorme.

Mentre i concorrenti devono convincerti a scaricare un’app o visitare un sito, l’IA di Google è già lì, nel tuo telefono, pronta a suggerirti una risposta alla mail del capo prima ancora che tu l’abbia aperta.

Ma c’è un rovescio della medaglia in questa onnipresenza.

Affidarsi agli “agenti” significa concedere un accesso senza precedenti alla nostra vita digitale. Se un’IA può fare cose per me, deve necessariamente vedere tutto ciò che faccio.

La comodità ha un prezzo, e quel prezzo è la trasparenza totale dei nostri dati personali verso i server di Mountain View, una questione che l’entusiasmo per le nuove feature tende spesso a oscurare.

La ricerca non è più quella di una volta

Il campo di battaglia più sanguinoso, e decisivo, è stato quello della Ricerca.

Per decenni, cercare su Google significava ottenere una lista di link blu. Quest’anno, quella certezza è evaporata.

Con l’introduzione massiccia dell’AI Mode e delle panoramiche generate dall’IA (AI Overviews), Google ha cambiato le regole del gioco editoriale mondiale, accentrando le risposte e riducendo il traffico verso i siti esterni.

Nonostante le polemiche degli editori e i timori iniziali sulla qualità delle risposte (ricordate le allucinazioni del 2024?), i numeri danno ragione alla strategia aggressiva di Sundar Pichai.

La massa critica raggiunta è spaventosa: 1,5 miliardi di utenti mensili utilizzano le panoramiche AI per ottenere risposte sintetiche e contestualizzate, bypassando di fatto la navigazione tradizionale.

Google ha iniziato l’anno in svantaggio nella corsa all’IA. Ha concluso il 2025 in testa.

— Hamza Shaban, Reporter tecnologico

Questa dominanza non è solo una vittoria di prodotto, ma una dimostrazione di forza infrastrutturale.

Servire risposte generate dall’IA a miliardi di persone in tempo reale richiede una potenza di calcolo che poche aziende al mondo possono permettersi.

L’introduzione dei nuovi modelli “Flash” a dicembre, ottimizzati per la latenza e i costi, dimostra che la battaglia ora si gioca sull’efficienza: non basta essere intelligenti, bisogna essere economici e veloci.

Eppure, proprio qui si annida il paradosso.

Rendendo la ricerca un “oracolo” che fornisce la risposta unica, Google si assume la responsabilità editoriale della verità.

Ogni errore del modello non è più un “risultato di ricerca sbagliato”, ma una “risposta di Google sbagliata”. E gli errori ci sono ancora.

Non tutto fila liscio: le crepe nel monolite

Sarebbe ingenuo dipingere il 2025 di Google come una marcia trionfale senza ostacoli.

Se l’hardware (il famoso AI Hypercomputer) e l’integrazione consumer hanno brillato, sul fronte della qualità pura dei modelli di punta ci sono state delle battute d’arresto significative che la stampa generalista ha spesso ignorato.

Mentre il marketing ci parla di “ragionamento avanzato”, gli analisti di settore hanno notato che l’accelerazione forsennata ha portato al rilascio di prodotti talvolta immaturi.

Non è un segreto che, in certi ambiti professionali e legali, i nuovi modelli abbiano mostrato una fragilità inaspettata rispetto alle versioni precedenti o ai concorrenti diretti come OpenAI e Anthropic.

Un recente report ha evidenziato come le aspettative industriali sono state deluse dalle prestazioni di Gemini 3, sottolineando difficoltà nel mantenere la coerenza su compiti complessi che richiedono alta precisione.

Questa discrepanza tra la percezione pubblica (Google è ovunque e fa tutto) e l’analisi tecnica (il modello “top di gamma” fatica su certi benchmark critici) è il vero cliffhanger con cui chiudiamo l’anno.

L’azienda sta scommettendo tutto sull’idea che l’integrazione batta la perfezione.

Per l’utente medio, avere un’IA che funziona “abbastanza bene” ed è già integrata in Gmail è preferibile a un’IA “perfetta” che richiede un abbonamento separato e copia-incolla continui.

È la vittoria dell’ecosistema sulla singola specifica tecnica.

Guardando al 2026, la domanda non è più se Google sia riuscita a recuperare il ritardo, ma se il modello di “IA come utilità pervasiva” sia sostenibile a lungo termine.

Abbiamo accettato di trasformare il motore di ricerca in un motore di risposte e il nostro telefono in un agente proattivo.

Ma in un mondo dove l’algoritmo decide cosa leggiamo, come scriviamo e cosa compriamo, siamo sicuri di essere ancora noi a guidare, o siamo diventati passeggeri nel sedile posteriore della nostra vita digitale?