Nvidia e OpenAI: 10 Gigawatt per la Nuova Era dell’Intelligenza Artificiale

L’accordo tra NVIDIA e OpenAI sposta l’attenzione sull’energia, ridisegnando l’architettura di internet e portando alla nascita delle “AI Factories”

Se c’è una cosa che il 2025 ci ha insegnato, è che la legge di Moore non è morta, ha solo cambiato dieta: ora si nutre esclusivamente di megawatt.

Mentre ci prepariamo a chiudere l’anno, l’attenzione di chi lavora nel backend non è sui bilanci o sui trend consumer, ma su un numero che fa tremare i polsi a qualsiasi ingegnere elettrico: 10 gigawatt.

È questa la cifra mostruosa al centro dell’accordo tra NVIDIA e OpenAI, una mossa che ridefinisce non solo i rapporti di forza nella Silicon Valley, ma l’architettura stessa di internet per come la conosciamo.

Non stiamo parlando di un semplice contratto di fornitura hardware. Quello a cui assistiamo è il consolidamento definitivo di un modello industriale dove il software è un sottoprodotto dell’energia.

Per dare una prospettiva tecnica: 10 gigawatt sono sufficienti ad alimentare circa 7 milioni e mezzo di abitazioni, oppure, nel nostro caso, a tenere accesa la più grande “intelligenza” sintetica mai concepita.

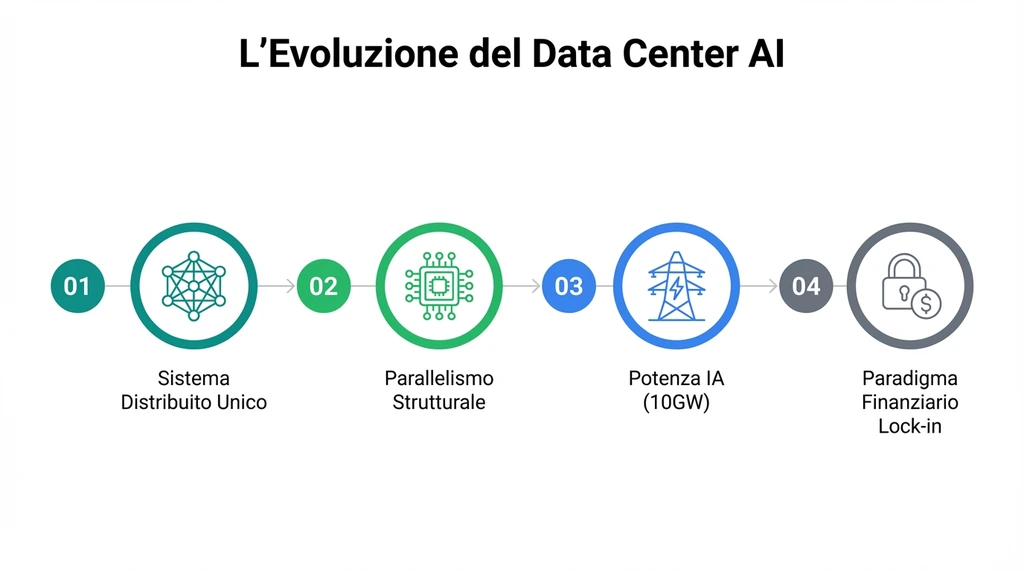

OpenAI e NVIDIA hanno annunciato una partnership strategica per distribuire 10 gigawatt di potenza di calcolo, segnando di fatto il passaggio dall’era dei data center a quella delle “AI Factories”. Ma dietro i comunicati stampa trionfali, c’è una complessità implementativa che merita di essere dissezionata.

La fine del data center generalista

Per chi scrive codice e gestisce infrastrutture, la distinzione è cruciale.

Fino a ieri, il cloud era un enorme magazzino di server commodity, progettati per fare un po’ di tutto: servire pagine web, gestire database, elaborare transazioni. Quello che NVIDIA sta costruendo con la piattaforma Vera Rubin non è un computer più veloce, è un singolo sistema distribuito dove la latenza tra i nodi è il vero nemico.

L’architettura necessaria per gestire carichi di lavoro su questa scala richiede un ripensamento totale dello stack. Non basta più impilare GPU in un rack; serve un tessuto connettivo (pensiamo a NVLink su steroidi) che faccia apparire milioni di core come un’unica entità logica al software.

È l’eleganza brutale della forza bruta: parallelismo massivo gestito non più a livello applicativo, ma strutturale.

Jensen Huang, CEO di NVIDIA, ha descritto questa evoluzione come il culmine di una simbiosi tecnica decennale:

Questo investimento e la partnership infrastrutturale segnano il prossimo salto in avanti: distribuire 10 gigawatt per alimentare la prossima era dell’intelligenza.

— Jensen Huang, Fondatore e CEO di NVIDIA

Tuttavia, c’è un dettaglio che trasforma questa notizia tecnica in un caso di studio economico. NVIDIA non si limita a vendere i chip.

I dettagli finanziari vedono NVIDIA investire progressivamente fino a 100 miliardi di dollari direttamente nell’infrastruttura. È un cambio di paradigma totale: il fornitore che finanzia il cliente per permettergli di comprare i propri prodotti.

Tecnicamente, questo risolve il problema del CAPEX per OpenAI, ma strategicamente crea un vendor lock-in di proporzioni bibliche.

L’energia come collo di bottiglia

Spostando lo sguardo dal silicio al rame, emerge il vero limite fisico di questa operazione. Parlare di 10 GW significa parlare di rete elettrica, di trasformatori, di raffreddamento a liquido e, inevitabilmente, di nucleare o rinnovabili su scala industriale.

Non si può semplicemente collegare una factory del genere alla rete nazionale senza far saltare tutto.

La sfida ingegneristica si sposta quindi dalla progettazione dei chip alla gestione termica e alla distribuzione di potenza. L’architettura a 800 VDC (corrente continua), che riduce le perdite di conversione, diventa non più un’opzione esotica ma uno standard obbligato.

Chiunque abbia mai gestito una server farm sa che il calore è il nemico numero uno; scalare questo problema a 10 gigawatt richiede soluzioni idrauliche che somigliano più a quelle di una centrale elettrica che a quelle di un data center tradizionale.

Sam Altman, dal canto suo, non nasconde che la potenza di calcolo è diventata la valuta di riserva del futuro:

Tutto inizia con il calcolo. L’infrastruttura di calcolo sarà la base per l’economia del futuro e utilizzeremo ciò che stiamo costruendo con NVIDIA sia per creare nuovi progressi nell’IA, sia per fornirli a persone e aziende su larga scala.

— Sam Altman, Cofondatore e CEO di OpenAI

Questa visione “calcolo-centrica” ha però delle implicazioni inquietanti per l’ecosistema open source. Se la barriera d’ingresso per l’addestramento dei modelli di frontiera è fissata a 10 GW e centinaia di miliardi di dollari, lo spazio per l’innovazione distribuita si restringe drasticamente.

Il rischio della monocultura tecnica

Mentre ammiriamo l’ingegneria dietro la piattaforma Vera Rubin e la capacità di NVIDIA di orchestrare cluster immensi, dobbiamo chiederci cosa stiamo sacrificando.

La bellezza dell’informatica è sempre risieduta nella sua accessibilità: un ragazzino in un garage poteva scrivere un codice in grado di cambiare il mondo. Oggi, quel codice, senza un’infrastruttura miliardaria dietro, rischia di rimanere un esercizio di stile.

La conferma ufficiale della scala di implementazione dei sistemi ci dice che la prima fase operativa partirà nella seconda metà del 2026. Questo ci lascia circa sei mesi per capire come il resto del mondo tecnologico reagirà. Oracle, Microsoft e Meta stanno correndo ai ripari, ma la densità di integrazione verticale che NVIDIA sta costruendo con OpenAI sembra inattaccabile.

Il rischio tecnico non è tanto nel fallimento del progetto, quanto nel suo successo. Se l’unica strada per l’AGI passa per l’hardware proprietario di un singolo fornitore e l’infrastruttura di un singolo laboratorio, stiamo creando un single point of failure per l’intera economia digitale.

L’Open Source ha dimostrato con modelli come Llama e Mistral di poter competere sull’efficienza, ma può competere sulla forza bruta fisica?

Siamo di fronte a un bivio storico. Da un lato, l’eleganza di sistemi integrati che spingono i limiti della fisica computazionale; dall’altro, la concentrazione di potere in due sole boardroom.

La domanda che ci lasciamo alle spalle in questo 2025 non è se riusciranno a collegare tutti quei gigawatt, ma se, una volta acceso l’interruttore, ci sarà ancora spazio per qualcuno che non abbia il pass d’ingresso firmato da Huang e Altman.