Apple, Ia on-device e il futuro dello sviluppo iOS

Ma per chi vive immerso nel codice, il vero regalo è l’apertura delle API di Apple alla Neural Engine, un cambio di paradigma paragonabile all’avvento dell’App Store nel 2008.

Sotto l’albero di Natale di quest’anno, per molti, c’è un iPhone 17. Tuttavia, per chi come noi vive immerso nel codice e nelle build notturne, il vero regalo scartato non è fatto di titanio e vetro, ma di API e framework.

Mentre l’utente medio sta ancora configurando il Face ID tra una fetta di panettone e l’altra, noi sviluppatori stiamo osservando quello che potrebbe essere il più grande cambio di paradigma nell’ecosistema Apple dai tempi dell’App Store del 2008.

Siamo abituati a considerare iOS come un giardino recintato, il famoso “walled garden”. Ma le decisioni tecniche emerse durante l’anno, culminate negli aggiornamenti che stanno girando proprio ora su quei nuovi dispositivi, raccontano una storia diversa. Apple ha aperto, seppur con la consueta cautela chirurgica, le porte della sua “Neural Engine” a terze parti.

Non stiamo parlando di semplici wrapper per chiamate API verso server remoti, ma di accesso diretto al metallo.

Il punto cruciale è tecnico quanto filosofico: l’esecuzione locale. Fino a poco tempo fa, integrare l’IA significava gestire latenze di rete, costi di cloud computing e incubi sulla privacy dei dati utente. La mossa di Cupertino di esporre i Foundation Models direttamente nel sistema operativo cambia le carte in tavola. Non è solo una questione di marketing; è un’architettura che sposta il carico di inferenza dal cloud al dispositivo, una scelta che, da sviluppatore, apprezzo per la sua eleganza ed efficienza energetica, ma che nasconde implicazioni strategiche ben più profonde.

L’eleganza tecnica (e i suoi compromessi)

Per anni, l’integrazione di machine learning su iOS tramite CoreML è stata un esercizio di pazienza. Dovevi addestrare il tuo modello, quantizzarlo, sperare che non pesasse 2GB e pregare che non prosciugasse la batteria. Con gli annunci della WWDC 2025, Apple ha standardizzato tutto questo.

Ora, un’app di note di terze parti può invocare il modello linguistico residente nella RAM di sistema per riassumere un testo, senza dover includere il proprio modello nel bundle dell’applicazione.

Come ha spiegato un portavoce durante la presentazione tecnica:

Questo offre agli sviluppatori un accesso diretto a un’intelligenza potente, veloce, costruita con la privacy al centro e disponibile anche offline.

— Keynote Presenter, Apple

Dal punto di vista dell’ingegneria del software, questa è una vittoria. Riduce la frammentazione: invece di avere cinquanta app con cinquanta modelli mediocri che competono per le risorse, c’è un’unica fonte di verità, ottimizzata a livello di kernel.

Tuttavia, c’è un rovescio della medaglia. Utilizzando le API di sistema, noi sviluppatori ci leghiamo indissolubilmente al ciclo di rilascio di Apple. Se il modello di sistema ha un bias o un’allucinazione, la mia app eredita quel problema e io non ho modo di “patcharlo”.

È la classica permuta tra comodità e controllo, portata all’estremo.

Inoltre, l’azienda ha confermato l’accesso diretto ai modelli di fondazione on-device come parte di una strategia per rendere l’IA onnipresente ma invisibile. Non è più una “feature” da vendere, ma un servizio di sistema, come il GPS o la fotocamera.

E proprio qui, dove il codice incontra il business, la situazione si complica notevolmente.

Il pivot dai servizi all’infrastruttura

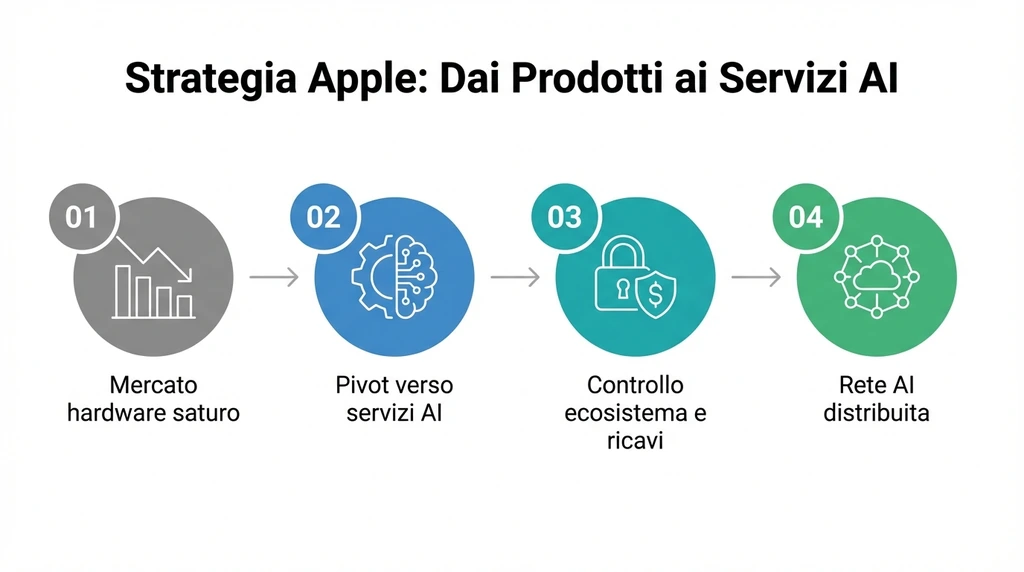

Per capire perché Apple stia “regalando” potenza di calcolo neurale agli sviluppatori, dobbiamo guardare i numeri con occhio cinico. Il mercato hardware è saturo. L’iPhone 17 vende bene, certo, ma i tassi di crescita esplosivi del 2010-2015 sono un ricordo. La vera miniera d’oro è la voce “Servizi” nel bilancio.

Ma i servizi, per crescere, hanno bisogno di un ecosistema vibrante e, soprattutto, vincolato.

Se gli utenti iniziassero a usare massicciamente ChatGPT o Claude tramite app web o wrapper, Apple perderebbe il controllo sull’interfaccia utente primaria. Integrando l’IA a livello OS e permettendo alle app di usarla, Apple cerca di assicurarsi che l’interazione intelligente avvenga alle sue condizioni, sui suoi chip, proteggendo quel 30% di commissioni o l’abbonamento a Apple One.

È interessante notare come l’espansione della base installata globale di iOS venga ora letta dagli analisti non più come una metrica di vendita hardware, ma come un indice di penetrazione per questi nuovi servizi AI. Ogni iPhone attivo diventa un nodo di una rete distribuita dove Apple detta le regole del gioco.

Susan Prescott, VP delle relazioni con gli sviluppatori, ha inquadrato la cosa con l’ottimismo tipico della Silicon Valley:

Non vediamo l’ora di condividere gli strumenti e le tecnologie più recenti che daranno potere agli sviluppatori e li aiuteranno a continuare a innovare.

— Susan Prescott, Vice President of Worldwide Developer Relations, Apple

“Innovare”, nel linguaggio di Cupertino, significa spesso “trovare nuovi modi per rendere l’utente dipendente dal nostro ecosistema”.

E se tecnicamente la soluzione è impeccabile, politicamente è un campo minato.

Lo scontro normativo e la frammentazione

Mentre noi sviluppatori ci entusiasmiamo per le nuove chiamate di sistema, i legali a Bruxelles stanno affilando i coltelli. L’approccio di Apple, che privilegia l’integrazione verticale (hardware, OS, servizi AI), cozza frontalmente con il Digital Markets Act (DMA) europeo.

L’argomento è sottile: se l’IA di sistema è così profondamente integrata da essere l’unica performante (perché ha accesso privilegiato alla memoria e alla NPU), allora Apple sta tagliando fuori la concorrenza?

Questo ha creato una situazione paradossale. Oggi, 25 dicembre, un utente a New York ha un iPhone 17 “super-intelligente”, mentre un utente a Milano ha lo stesso hardware ma un software castrato. Le tensioni con i regolatori europei hanno creato un mercato a due velocità, dove le funzionalità più avanzate di Siri 2.0 sono sospese nel limbo normativo.

Dal punto di vista tecnico, è un incubo. Dobbiamo scrivere codice condizionale che verifica la regione dell’utente per abilitare o disabilitare funzionalità core. È inefficiente e va contro il principio di universalità del software.

Inoltre, pone una domanda inquietante sulla sovranità digitale: se la privacy è garantita dall’elaborazione locale, perché un ente regolatore dovrebbe ostacolarla? La risposta sta nel controllo dei dati e nell’interoperabilità, concetti che l’architettura monolitica di Apple fatica a digerire.

La realtà è che, nonostante la brillantezza ingegneristica di far girare LLM su un dispositivo tascabile senza fondere la batteria, la tecnologia non esiste nel vuoto. Apple sta cercando di usare la privacy come un fossato difensivo per proteggere il suo dominio sui servizi.

Noi sviluppatori siamo pedine in questo gioco: ci vengono dati strumenti potenti, ma al prezzo di una dipendenza sempre più profonda.

La domanda che mi pongo, guardando il mio IDE stasera, non è se il codice funzionerà. Sappiamo che funzionerà, e probabilmente sarà anche più fluido della concorrenza Android.

La domanda è: stiamo costruendo un futuro più aperto, o stiamo solo arredando una gabbia dorata sempre più sofisticata?