Intelligenza artificiale: oltre il glossario, comprendere l’architettura

Comprendere l’intelligenza artificiale nel 2026 significa andare oltre le definizioni, analizzando architetture come Transformer e meccanismi come l’attenzione, per distinguere tra logica umana e completamento statistico.

Siamo nel 2026 e, nonostante l’intelligenza artificiale generativa sia ormai integrata in ogni IDE e sistema operativo che utilizziamo, persiste una nebbia lessicale che spesso confonde l’utente finale e irrita chi scrive codice.

Quando si parla di AI, la precisione terminologica non è un vezzo accademico, ma una necessità ingegneristica: confondere un LLM (Large Language Model) con una AGI (Artificial General Intelligence) è come scambiare una libreria di funzioni ben ottimizzata per un essere senziente.

Recentemente è emersa la necessità di fare ordine con una raccolta di 61 termini essenziali per comprendere l’intelligenza artificiale, un tentativo lodevole di standardizzare un vocabolario che cambia alla velocità di una pull request.

Tuttavia, limitarsi a memorizzare le definizioni senza comprendere il meccanismo sottostante rischia di creare una conoscenza superficiale. Per un tecnico, termini come “Transformer” o “Allucinazione” non sono etichette astratte, ma descrittori precisi di comportamenti del software e limitazioni architetturali.

Capire cosa succede quando premiamo “invio” su un prompt richiede di guardare sotto il cofano, dove la matematica probabilistica incontra l’ingegneria del software su scala massiva.

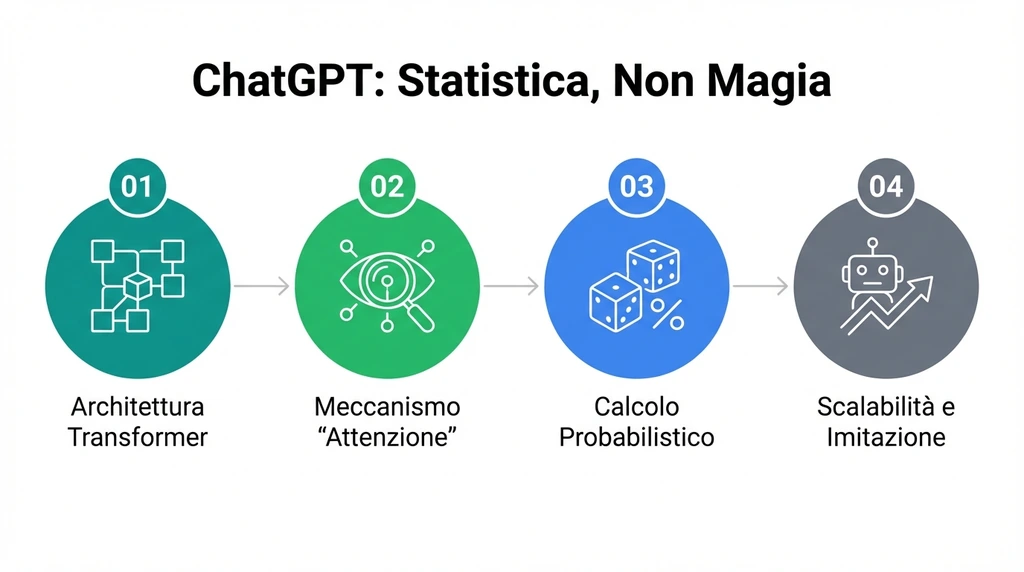

L’architettura non è magia, è statistica

Il cuore pulsante di tutto ciò che chiamiamo genericamente “ChatGPT” è l’architettura Transformer. Introdotta quasi un decennio fa, nel 2017, questa struttura ha risolto un problema fondamentale delle reti neurali precedenti: la capacità di elaborare intere sequenze di dati in parallelo, invece che sequenzialmente.

È qui che risiede l’eleganza tecnica: il meccanismo di “attenzione” (Self-Attention) permette al modello di pesare la rilevanza di ogni parola rispetto a tutte le altre in una frase, indipendentemente dalla loro distanza posizionale.

Questo approccio ha reso possibile l’architettura trasformativa che ha rivoluzionato l’elaborazione del linguaggio naturale, permettendo ai modelli di “capire” il contesto in modi che le vecchie RNN (Recurrent Neural Networks) non potevano nemmeno sognare.

Quando un modello GPT (Generative Pre-trained Transformer) genera testo, non sta “pensando” nel senso umano del termine; sta eseguendo un calcolo probabilistico estremamente sofisticato per determinare quale token (frammento di parola) ha la maggiore probabilità statistica di seguire quello precedente, basandosi sui pesi (weights) appresi durante il training.

La bellezza di questo sistema sta nella sua scalabilità, ma è anche la sua trappola.

Più parametri aggiungiamo — dai 175 miliardi di GPT-3 ai trilioni dei modelli attuali — più il modello diventa abile nel mimare la logica umana, rendendo sempre più difficile per l’utente medio distinguere tra ragionamento e semplice completamento statistico.

Il mito dell’allucinazione e la realtà dei dati

Uno dei termini più fraintesi e antropomorfizzati è “allucinazione”. Tecnicamente, un modello non allucina perché non ha una percezione della realtà da distorcere.

Quello che accade è un errore di predizione o, più precisamente, una predizione plausibile ma fattualmente errata basata su pattern probabilistici. Se il modello non trova una risposta esatta nel suo spazio latente, ne costruisce una che sembra corretta.

È un feature, non un bug, della generazione probabilistica: il sistema è progettato per completare pattern, non per verificare fatti.

Qui entra in gioco il concetto cruciale di Training Data. La qualità dell’output è vincolata in modo deterministico alla qualità e alla varietà dei dati di addestramento.

Se alimentiamo una rete con terabyte di testo non filtrato prelevato dal web, erediteremo inevitabilmente i bias, le inesattezze e i pregiudizi presenti in quei dati. La “pulizia” del dataset è diventata una delle sfide ingegneristiche più complesse, ben più della semplice progettazione dell’algoritmo.

Le soluzioni “tecnicamente mediocri” che vediamo spesso sul mercato cercano di arginare queste allucinazioni con filtri post-hoc o regole rigide, invece di lavorare sulla qualità del pre-training o sull’affinamento (Fine-tuning) specifico per dominio. La vera eleganza sta nel Prompt Engineering avanzato e nelle tecniche di RAG (Retrieval-Augmented Generation), che ancorano le capacità linguistiche del modello a fonti di dati esterne e verificate, riducendo la dipendenza dalla “memoria” interna del modello.

Oltre le parole chiave: verso la multimodalità

L’evoluzione non si è fermata al testo. Con l’avvento di GPT-4 e le sue capacità multimodali avanzate, abbiamo assistito a un cambio di paradigma: i modelli ora processano immagini, codice e audio con la stessa architettura di base usata per il linguaggio.

Questo ha complicato ulteriormente il glossario, introducendo concetti che fondono visione artificiale e NLP. Non si tratta più solo di prevedere la parola successiva, ma di comprendere la relazione semantica tra un pixel e un verbo.

Eppure, in questo entusiasmo tecnico, aleggia sempre lo spettro dell’AGI (Artificial General Intelligence). Sebbene il termine sia onnipresente nei glossari e nei pitch deck delle startup, da un punto di vista strettamente implementativo, siamo ancora distanti da un’intelligenza capace di generalizzare l’apprendimento al di fuori del suo training set in modo autonomo.

I modelli attuali sono eccellenti specialisti camuffati da generalisti grazie alla vastità dei loro dati, ma mancano ancora di una vera comprensione causale del mondo.

La trasparenza tecnica e l’approccio open source — si pensi ai modelli come Llama o Mistral che hanno sfidato i giganti chiusi — sono fondamentali per demistificare questi concetti. Avere accesso ai “pesi” del modello permette alla comunità di sviluppatori di analizzare, ottimizzare e, soprattutto, capire i limiti reali di queste tecnologie, al di là del marketing.

La vera domanda per il 2026 non è quante nuove parole aggiungeremo al nostro vocabolario AI, ma se saremo in grado di distinguere tra l’eleganza di un’architettura ben progettata e la forza bruta di un modello addestrato su dati spazzatura.