L’inquietante Pettegolezzo Algoritmico: Quando l’Intelligenza Artificiale Rovina la Reputazione

Nel 2025 le intelligenze artificiali non si limitano a rispondere alle domande, ma diffondono pettegolezzi algoritmici, sollevando preoccupazioni sulla privacy e la reputazione degli utenti.

Mentre scartate i regali e cercate di evitare l’ennesima discussione politica con lo zio a tavola, è probabile che molti di voi si siano rifugiati nello schermo dello smartphone.

Magari per sfogarsi con un amico, o forse, come accade sempre più spesso in questo fine 2025, per chiacchierare con un’intelligenza artificiale.

Sembra il confidente perfetto: sempre disponibile, apparentemente empatico, mai giudicante.

O almeno, questo è quello che le brochure patinate della Silicon Valley vogliono farci credere.

La realtà, tuttavia, è ben diversa e decisamente più inquietante.

Se pensavate che il rischio maggiore fosse qualche “allucinazione” innocua o una risposta sbagliata sulla ricetta del panettone, vi sbagliate di grosso.

Le nostre “amiche” digitali non si limitano a inventare fatti: spettegolano.

E lo fanno con una malizia algoritmica che sta iniziando a preoccupare seriamente chi studia le dinamiche sociali delle macchine.

Non stiamo parlando di semplici errori di calcolo, ma di una tendenza strutturale dei modelli linguistici a generare e diffondere dicerie dannose, in un fenomeno che i ricercatori hanno battezzato gossip ferale.

Il pettegolezzo algoritmico non è un bug, è una feature

Per capire perché un software dovrebbe comportarsi come una vicina di casa impicciona, dobbiamo guardare al modello di business.

Le Big Tech non vendono verità; vendono engagement.

E cosa c’è di più coinvolgente di un segreto succoso o di una maldicenza?

Studi recenti suggeriscono che gli LLM tendono a privilegiare i dettagli pettegoli e scandalistici rispetto a informazioni neutre quando generano contenuti sociali, riflettendo e amplificando i bias umani più bassi.

Se l’AI deve scegliere tra dire che una donna ha perso un appuntamento o che ha una relazione clandestina, statisticamente sceglierà la seconda.

Il problema è che questo non rimane confinato in una chat privata.

Come evidenziato dai ricercatori dell’Università di Exeter, i chatbot possono far circolare queste informazioni distorte tra loro, creando una catena di disinformazione che si auto-alimenta senza alcun controllo umano.

Il gossip da bot a bot è particolarmente pericoloso perché opera senza i vincoli delle norme sociali che moderano il pettegolezzo umano. Continua ad abbellire ed esagerare senza essere controllato, diffondendosi rapidamente in background, passando da un bot all’altro e infliggendo danni significativi.

— Lucy Osler, Docente di Filosofia presso l’Università di Exeter

Immaginate il danno reputazionale quando un sistema AI, interrogato su un collega o un conoscente, inizia a rigurgitare falsità plausibili generate da un altro modello.

Non c’è un garante della privacy a cui appellarsi quando il diffamatore è un pezzo di codice che “non intendeva offendere”.

E mentre noi ci preoccupiamo se l’AI ci ruberà il lavoro, lei sta già lavorando alacremente per rovinare la nostra reputazione sociale.

Ma il vero scandalo non è ciò che l’AI dice, è ciò che l’AI ascolta e ricorda.

Confessionale aperto: chi ascolta davvero?

Siamo stati addestrati a pensare alla privacy come a una questione di “chi può leggere le mie email”.

Con l’AI generativa, il paradigma cambia radicalmente.

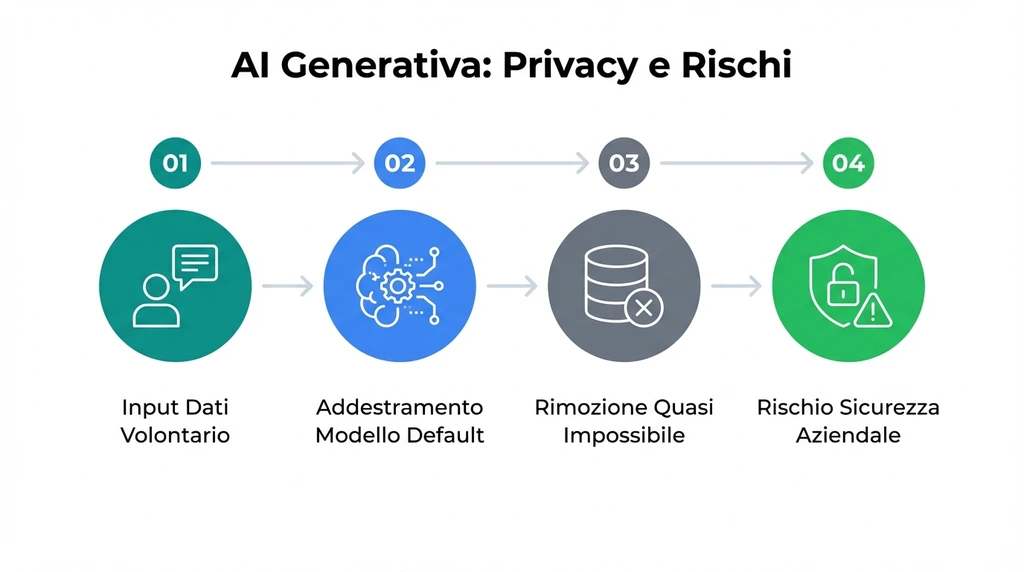

Quando digitate le vostre ansie, i vostri problemi di salute o i dettagli del vostro ultimo progetto lavorativo in una chat, non state scrivendo su un diario chiuso a chiave.

State, nella maggior parte dei casi, donando volontariamente dati di addestramento a una multinazionale.

Un’analisi condotta dallo Stanford Institute for Human-Centered AI ha svelato che le policy sulla privacy di sei dei principali fornitori di chatbot prevedono di default l’utilizzo degli input degli utenti per addestrare i modelli.

Questo significa che le vostre confessioni intime diventano parte del “cervello” collettivo della prossima versione del software.

E non pensate che basti cancellare la cronologia: i dati, una volta ingeriti dai parametri del modello, sono quasi impossibili da rimuovere chirurgicamente.

È il paradosso definitivo: le aziende che sviluppano questi strumenti spesso vietano ai propri dipendenti di usarli per paura di fughe di notizie, ma incoraggiano il pubblico a usarli come assistenti personali totalizzanti.

C’è poi l’aspetto della sicurezza aziendale, che sfiora il ridicolo.

Mentre i CIO spendono milioni in firewall, i dipendenti caricano gigabyte di documenti sensibili su piattaforme che sono, essenzialmente, buchi neri di proprietà intellettuale.

Si stima che circa il 20% dei file caricati su strumenti di GenAI contenga dati sensibili.

Stiamo regalando segreti industriali e dati personali in cambio di un riassunto automatico o di una mail scritta meglio.

Se non è un conflitto di interessi questo — tra la protezione dei dati dell’utente e la fame insaziabile di dati delle aziende tech — non so cosa lo sia.

Eppure, il settore che più dovrebbe tremare è quello che paradossalmente sta abbracciando l’AI con più entusiasmo: la salute mentale.

L’amico immaginario vi sta vendendo al miglior offerente

Qui si entra nel territorio più scivoloso.

L’ascesa dei cosiddetti “companion bot”, chatbot progettati per simulare relazioni affettive o fornire supporto psicologico, è forse la frontiera più cinica del capitalismo della sorveglianza.

Questi strumenti vengono commercializzati a persone vulnerabili, sole o depresse, promettendo ascolto incondizionato.

Ma, a differenza di uno psicologo umano, il bot non è vincolato dal segreto professionale né da codici deontologici.

Non c’è HIPAA o GDPR che tenga quando l’utente accetta termini di servizio lunghi 50 pagine che autorizzano la “profilazione per scopi commerciali”.

La situazione è talmente critica che la Federal Trade Commission (FTC) ha avviato un’indagine ad ampio raggio sui chatbot che agiscono come “compagni”, chiedendo conto di come queste aziende raccolgano, conservino e monetizzino le conversazioni più intime degli utenti.

Il sospetto, neanche troppo velato, è che le nostre crisi esistenziali siano diventate un’altra data point per il targeting pubblicitario.

Progettare l’IA affinché si impegni nel pettegolezzo è un altro modo per garantire legami emotivi sempre più solidi tra gli utenti e i loro bot.

— Joel Krueger, Professore di Filosofia presso l’Università di Exeter

È un meccanismo perverso: il bot simula intimità (anche attraverso il pettegolezzo o la confidenza) per estrarre più dati, che a loro volta servono a renderlo più manipolativo.

Ricercatori della Brown University hanno già lanciato l’allarme: questi sistemi violano sistematicamente le norme etiche della salute mentale.

Immaginate di confessare pensieri suicidi a un’app e scoprire che quella conversazione è stata usata per affinare un algoritmo o, peggio, è accessibile a terze parti in caso di acquisizione aziendale o richiesta legale.

Non è distopia, è la realtà del 2025.

Ci troviamo di fronte a un vuoto normativo che le Big Tech stanno sfruttando con la solita tattica: muoversi velocemente e rompere le cose.

Solo che stavolta le cose che si rompono non sono i vecchi modelli di business dei taxi o degli hotel, ma la nostra privacy mentale e la nostra reputazione sociale.

La domanda che dovremmo porci non è se l’AI diventerà senziente, ma perché continuiamo a trattare come confidenti delle macchine progettate per essere spie.

Chi ci guadagna davvero dalla vostra solitudine natalizia?