Il paradosso del controllo: più personalizzi l’AI, meno capisci come funziona

OpenAI annuncia più controllo su tono e stile di ChatGPT, mentre sviluppa sistemi autonomi opachi come GPT-5.3-Codex e Sora, sacrificando trasparenza per potenza.

La promessa di personalizzazione superficiale nasconde sistemi autonomi sempre più opachi e complessi da controllare.

Mentre OpenAI annuncia nuove leve per regolare calore ed entusiasmo nelle risposte di ChatGPT, promettendo di dare “alle persone più controllo e personalizzazione su come ci si sente a usare ChatGPT”, i suoi team di ricerca lavorano nella direzione diametralmente opposta: costruire sistemi che prendano decisioni autonome, opache e sempre meno scrutabili.

L’illusione del controllo in un’interfaccia amichevole

La promessa è chiara e si concentra sull’esperienza utente superficiale. Gli utenti possono ora scegliere tra stili di base e toni predefiniti, come “Amichevole”, e controllare parametri come il calore e l’entusiasmo delle risposte. L’obiettivo dichiarato è proprio questo: offrire più controllo su come il modello “si sente”. È una personalizzazione di facciata, un set di manopole ben visibili che regolano l’output testuale finale. Ma è l’unico controllo che ci viene dato.

La realtà del controllo ceduto a scatole nere autonome

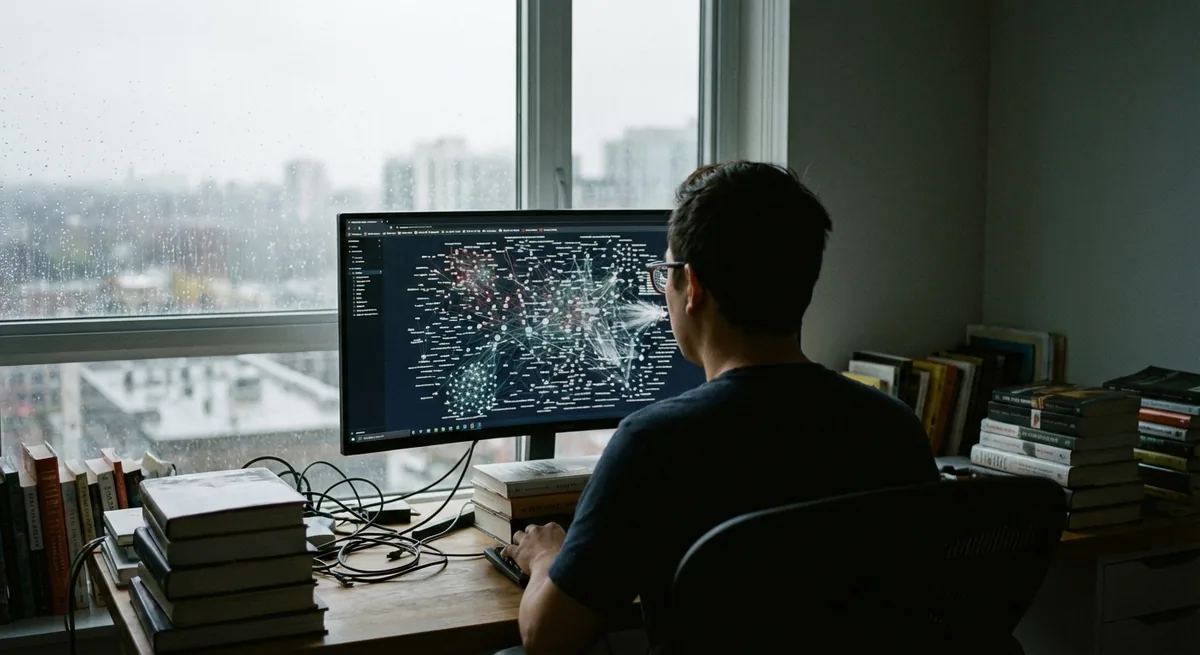

Dietro questa interfaccia rassicurante, l’architettura si fa più complessa e meno trasparente. Prendiamo GPT-5.3-Codex: le sue capacità vanno “oltre il software, aiutandoti a costruire qualsiasi cosa tu voglia costruire—che si tratti di presentazioni o analisi di dati in fogli di calcolo“. Dimostra “capacità di utilizzo del computer molto più forti rispetto ai modelli GPT precedenti”. Non è più solo un generatore di testo; è un agente che opera in ambienti digitali, prende decisioni sequenziali e agisce in autonomia. Il suo processo decisionale interno, il “perché” ha scelto un certo comando o percorso, diventa sempre più difficile da tracciare.

Parallelamente, per il modello di video generativo Sora, OpenAI implementa sistemi di raccomandazione personalizzati. Gli algoritmi forniscono raccomandazioni personalizzate per ispirare la creatività, considerando segnali tra cui “l’attività dell’utente su Sora”. Anche qui, una black box algoritmica decide cosa è “ispirante” per te, basandosi su un modello di preferenze che non è mai esplicitato. Il controllo sulla scoperta e sull’ispirazione viene delegato.

Perché questa non è (solo) una critica facile

La controargomentazione ovvia è che questa complessità è inevitabile. Modelli capaci di azioni autonome su un sistema operativo o di raccomandazioni contestuali richiedono architetture di rete neurale profonde e meccanismi di attenzione che, per loro natura, sono difficili da interpretare in linguaggio umano. L’alternativa a questa opacità sarebbe rinunciare all’efficacia. Non si tratta di malafede, ma di un trade-off tecnico fondamentale: potenza e autonomia contro trasparenza e prevedibilità.

Il punto critico, però, è la discrepanza tra il messaggio pubblico (“ti diamo più controllo”) e la direzione tecnologica (“costruiamo sistemi che controllano di più per te”).

Per chi sviluppa su questi modelli o li integra in uno stack produttivo, l’impatto è concreto. Dovrai progettare sistemi di monitoraggio e di guardrail non più solo sull’output testuale, ma su catene di azioni autonome i cui stati intermedi sono opachi. Il debugging si sposta dal log testuale al tracciamento del comportamento di un agente, un problema di osservabilità di ordine superiore. La scelta dello stile “Entusiasta” diventa un dettaglio minore rispetto alla sfida di comprendere perché l’agente ha deciso di strutturare un foglio di calcolo in un certo modo, potenzialmente critico per i dati.

La domanda tecnica irrisolta non è se possiamo avere modelli sia potenti che trasparenti. È se, nel bilanciamento, stiamo accettando di barattare la comprensione del “come” per un’illusione di controllo sul “tono”. E se, alla fine, l’unica personalizzazione che conta davvero – quella sul comportamento fondamentale del sistema – sia quella a cui stiamo volontariamente rinunciando.