Gemma 4: l’IA di Google che gira su un Raspberry Pi — e cambia tutto per chi la costruisce

Google DeepMind ha lanciato Gemma 4, un modello linguistico avanzato che funziona localmente su Raspberry Pi 5 con licenza Apache 2.0, rivoluzionando lo sviluppo di IA open source.

Il modello open source da 31 miliardi di parametri funziona offline, con una licenza che ne permette l’uso commerciale senza

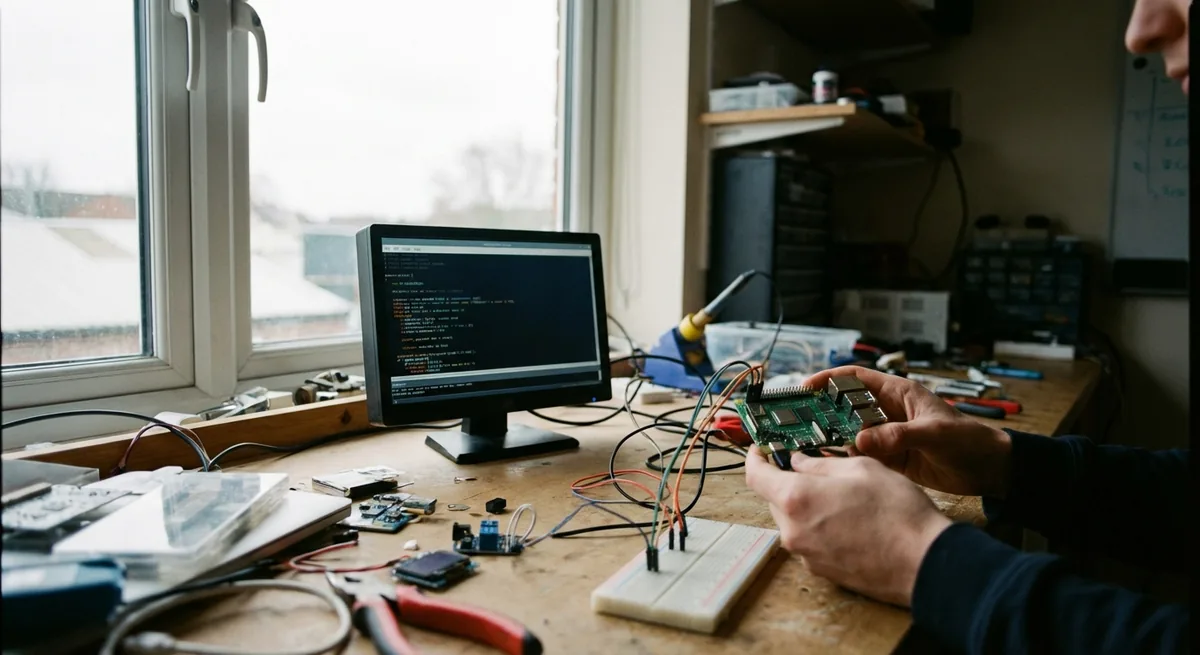

Immagina un appassionato nel suo piccolo laboratorio casalingo, con un Raspberry Pi 5 sul tavolo, un caffè ancora caldo e l’ambizione di costruire un assistente domestico intelligente senza pagare un centesimo di cloud. Fino a ieri, quel progetto era un sogno abbastanza frustrante. Da oggi, con il lancio ufficiale di Gemma 4 da parte di Google DeepMind, quello stesso hobbista ha tra le mani un modello linguistico all’avanguardia capace di girare localmente, sul suo hardware, senza dipendere da un singolo server esterno.

L’IA che gira su un Raspberry Pi: una svolta quotidiana

La cosa più sorprendente non è che Gemma 4 esista — è che funzioni davvero su un dispositivo che costa meno di cento euro. Il merito è di LiteRT-LM, il runtime ottimizzato di Google che, grazie al supporto per pesi a 2 e 4 bit e agli embedding mappati in memoria layer per layer, permette di eseguire il modello Gemma 4 E2B usando meno di 1,5 GB di memoria su alcuni dispositivi. Per capire quanto sia straordinario: è come far girare un motore da Formula 1 su un motorino, e sentirlo rispondere.

I numeri concreti parlano chiaro: su un Raspberry Pi 5, LiteRT-LM raggiunge una velocità di prefill di 133 token al secondo con Gemma 4 E2B, con un decode throughput di 7,6 token al secondo. Non è la velocità di un data center, certo, ma per un assistente vocale, un sistema di analisi testi o un bot per la casa, è più che sufficiente. E tutto questo accade sul dispositivo, senza inviare nulla a nessuno.

Libertà open source e posizionamento competitivo

Ma la vera notizia — quella che cambia le regole del gioco per sviluppatori, ricercatori e aziende — è la licenza. Con Gemma 4, secondo quanto riportato anche da l’analisi di ZDNet su Gemma 4, Google ha abbandonato i suoi termini personalizzati e ha adottato la licenza Apache 2.0. Il che significa, in parole semplici, che chiunque può usare, modificare e distribuire il modello come vuole, senza restrizioni. Niente più clausole opache, niente più zone grigie legali per chi vuole integrare il modello in un prodotto commerciale.

È una scelta che fa una differenza enorme. Con la vecchia licenza personalizzata di Google, usare Gemma in un contesto professionale richiedeva di leggere attentamente le condizioni, consultare un legale, e magari rinunciare a certi casi d’uso. Con Apache 2.0, quella conversazione sparisce. Il modello diventa uno strumento, non un accordo da negoziare.

E le prestazioni sono all’altezza della promessa. Il modello da 31 miliardi di parametri occupa attualmente il terzo posto nella classifica Arena AI text leaderboard, lo standard industriale per valutare i modelli linguistici aperti. Il modello da 26 miliardi si posiziona al sesto posto. Non stiamo parlando di un modello “carino per essere open source” — stiamo parlando di modelli che competono con i migliori disponibili al mondo, con la differenza che li puoi scaricare, modificare e tenere sul tuo server senza chiedere il permesso a nessuno. Il contrasto con la narrativa dell’IA come servizio premium e centralizzato è netto.

Dallo sfondo allo scenario futuro

Per capire quanto sia cambiato il contesto, basta ricordare che la pagina di presentazione ufficiale di Gemma 4 evidenzia come Gemma 3 sia uscita oltre un anno fa, con licenze più stringenti e capacità inferiori. In poco più di dodici mesi, Google DeepMind ha fatto un salto notevole: non solo in termini di parametri e prestazioni, ma nella filosofia di accesso. Aggiungici il supporto per oltre 140 lingue — il che rende Gemma 4 utilizzabile in contesti geografici e linguistici molto diversi dall’inglese — e il quadro è quello di un modello pensato per chiunque, non solo per i grandi laboratori.

Dove ci porterà tutto questo? L’IA locale, quella che gira sul tuo hardware senza toccare il cloud, non è più una curiosità per smanettoni. Sta diventando un’opzione concreta per chiunque voglia costruire applicazioni intelligenti preservando la privacy dei propri utenti — o semplicemente non voler pagare per ogni singola chiamata API. Con modelli scalabili, licenze libere e strumenti come LiteRT-LM che abbassano il costo computazionale, il confine tra quello che può fare un singolo sviluppatore e quello che richiedeva un intero team si fa sempre più sottile. Il garage dell’hobbista con il Raspberry Pi, oggi, è un posto molto più interessante di ieri.