Google Gemini sorpassa ChatGpt: La battaglia per il dominio dell’AI

Google ha smesso di cercare di stupire ed ha iniziato a fare ciò che sa fare meglio, erodendo così lo strapotere di ChatGpt

C’è stato un momento preciso, verso la fine del 2023, in cui sembrava che la partita dell’intelligenza artificiale generativa fosse già stata chiusa. ChatGPT era diventato sinonimo di AI come lo scotch lo è per il nastro adesivo, godendo di quel vantaggio del first mover che nel tech solitamente garantisce anni di rendita.

Eppure, osservando i dati di fine 2025, la narrazione è cambiata drasticamente, e non per magia. È cambiata perché Google ha smesso di cercare di stupire con le demo e ha iniziato a fare quello che, ingegneristicamente parlando, sa fare meglio: scalare l’infrastruttura e ridurre l’attrito.

I numeri che ci troviamo davanti oggi raccontano una storia di erosione lenta ma inesorabile. Se fino a un anno fa il dominio di OpenAI sembrava inattaccabile, i dati di traffico più recenti mostrano una crescita della quota di mercato di Gemini dal 5,4% al 18,2%.

Non stiamo parlando di una fluttuazione statistica, ma di uno spostamento strutturale delle abitudini degli utenti. ChatGPT è sceso dall’87% a circa il 68%. Mantiene ancora la maggioranza, certo, ma la traiettoria indica che l’effetto novità si è esaurito e siamo entrati nella fase dell’utilità integrata.

La questione tecnica qui non è chi ha il modello con il punteggio più alto su un benchmark sintetico come MMLU (Massive Multitask Language Understanding).

La vera battaglia si gioca sulla latenza, sull’integrazione e, brutalmente, sulla pigrizia dell’utente finale.

L’inerzia dell’abitudine

Per capire cosa sta succedendo sotto il cofano, bisogna guardare oltre l’interfaccia della chat. L’errore di valutazione comune è pensare che l’utente medio voglia “andare su un sito di AI” per risolvere un problema.

Non è così.

L’utente vuole che il problema venga risolto dove si trova già. Google ha sfruttato il suo controllo sulla pipeline digitale — Chrome, Android, Workspace — per trasformare Gemini da una destinazione a un layer infrastrutturale.

Quando un modello LLM (Large Language Model) viene integrato direttamente nel sistema operativo mobile o nel browser, l’attrito di utilizzo crolla a zero. Non c’è bisogno di autenticazione, non c’è cambio di contesto, non c’è copia-incolla. Shay Boloor, stratega del settore, ha inquadrato perfettamente questa dinamica ingegneristica definendola “catturare il flusso”.

Questo è ciò che lui chiama ‘catturare il flusso’. Man mano che l’IA passa dall’essere una novità all’uso quotidiano, gli strumenti che sono già parte della routine giornaliera degli utenti tendono ad ottenere un maggiore coinvolgimento.

— Shay Boloor, Industry Strategist

Dal punto di vista dello sviluppo, questa è una lezione classica di UX: la convenienza batte quasi sempre la performance pura. OpenAI ha costruito una “Cattedrale” bellissima dove bisogna recarsi in pellegrinaggio; Google ha installato l’acqua corrente in tutte le case.

Questa strategia di distribuzione capillare ha portato a una crescita esplosiva dell’adozione, tanto che Gemini ha raggiunto i 450 milioni di utenti attivi mensili già a metà del 2025.

È un numero che fa riflettere, soprattutto se consideriamo che gran parte di questi utenti probabilmente non sta “scegliendo” attivamente Gemini, ma se lo ritrova semplicemente sotto le dita mentre scrive una mail o cerca un ristorante.

Architettura contro forza bruta

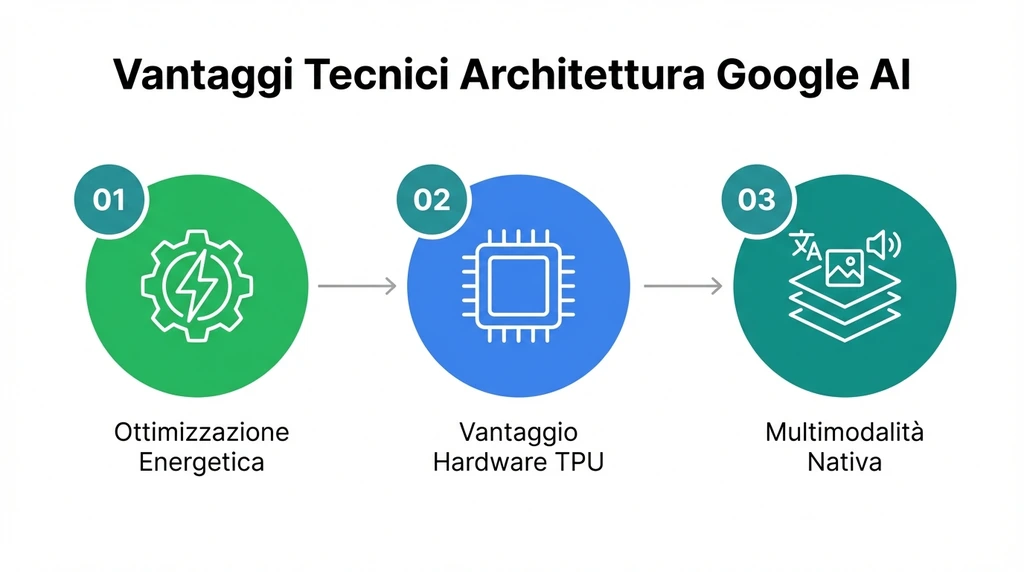

C’è poi un aspetto puramente tecnico che spesso sfugge ai non addetti ai lavori: l’efficienza dell’inferenza. Mantenere attivo un servizio che risponde a miliardi di query richiede un’infrastruttura colossale. Google ha lavorato ossessivamente sull’ottimizzazione dei costi per token generato. I report indicano una riduzione del consumo energetico per prompt di oltre 30 volte rispetto alle prime versioni.

Questo non è solo un dettaglio ecologico o economico; è ciò che permette di integrare il modello ovunque senza mandare in bancarotta l’azienda o fondere i server. Mentre OpenAI deve gestire i costi immensi dei cluster GPU di Nvidia, Google gioca in casa con le sue TPU (Tensor Processing Units), hardware progettato specificamente per le operazioni tensoriali su cui si basano le reti neurali.

Questo vantaggio verticale — dal chip al data center, fino al modello e all’applicazione finale — permette ottimizzazioni di latenza impossibili per chi deve assemblare componenti di fornitori diversi.

Inoltre, la natura “nativa multimodale” di Gemini offre un vantaggio architetturale. A differenza di GPT-4, che inizialmente era un modello di testo a cui sono stati “imbullonati” moduli visivi e audio, Gemini è stato addestrato fin dall’inizio su diverse modalità di input. Questo si traduce in una comprensione del contesto molto più sfumata e in una gestione dei token più efficiente quando si mischiano immagini e testo.

Sam Badawi, CEO di Solid Finance, sottolinea come i numeri riflettano una validazione tecnica da parte del mercato:

I numeri non sono casuali. Se l’attività web delle persone riflette le loro reali preferenze, allora la quota crescente per Google suggerisce che non sta solo competendo, ma sta guadagnando slancio.

— Sam Badawi, CEO di Solid Finance

Tuttavia, non tutto ciò che luccica è silicio.

C’è un lato oscuro in questa integrazione forzata.

La fine del monopolio (o l’inizio di uno nuovo?)

La rimonta di Google ci pone di fronte a un dilemma tecnico ed etico. Se il prodotto “migliore” vince solo perché è preinstallato, stiamo assistendo a una regressione della meritocrazia tecnologica. È lo stesso copione che abbiamo visto negli anni ’90 con Internet Explorer: non era il browser migliore, era solo quello che non dovevi installare.

Gli analisti descrivono questo spostamento come un segnale chiaro di un cambio di leadership nel settore, ma bisogna chiedersi quanto di questo successo sia dovuto all’eccellenza dell’algoritmo e quanto alla forza bruta della distribuzione.

OpenAI, pur con tutti i suoi limiti e le recenti turbolenze interne, rimane l’unico attore che spinge l’innovazione pura come prodotto core, e non come feature aggiuntiva per vendere più pubblicità o abbonamenti cloud.

Inoltre, la frammentazione del mercato tra questi due giganti lascia poco spazio per le soluzioni open source reali. Mentre noi sviluppatori apprezziamo modelli come Llama o Mistral per la trasparenza e la possibilità di fare fine-tuning locale, la massa critica si sta spostando verso ecosistemi chiusi (“walled gardens”) dove il funzionamento del modello è una scatola nera inaccessibile.

La vittoria di Google, se si consoliderà nel 2026, dimostrerà una verità scomoda del settore tech: puoi avere l’architettura neurale più elegante e il dataset di training più raffinato, ma se non controlli il punto di accesso dell’utente, sei destinato a diventare un fornitore di backend o una nicchia per appassionati.

La domanda da porsi non è più quale sia l’AI più intelligente, ma se siamo disposti ad accettare che la nostra “intelligenza ausiliaria” sia decisa, ancora una volta, dal sistema operativo che usiamo.