AI sempre più umana: la nuova frontiera tra allineamento e rischi

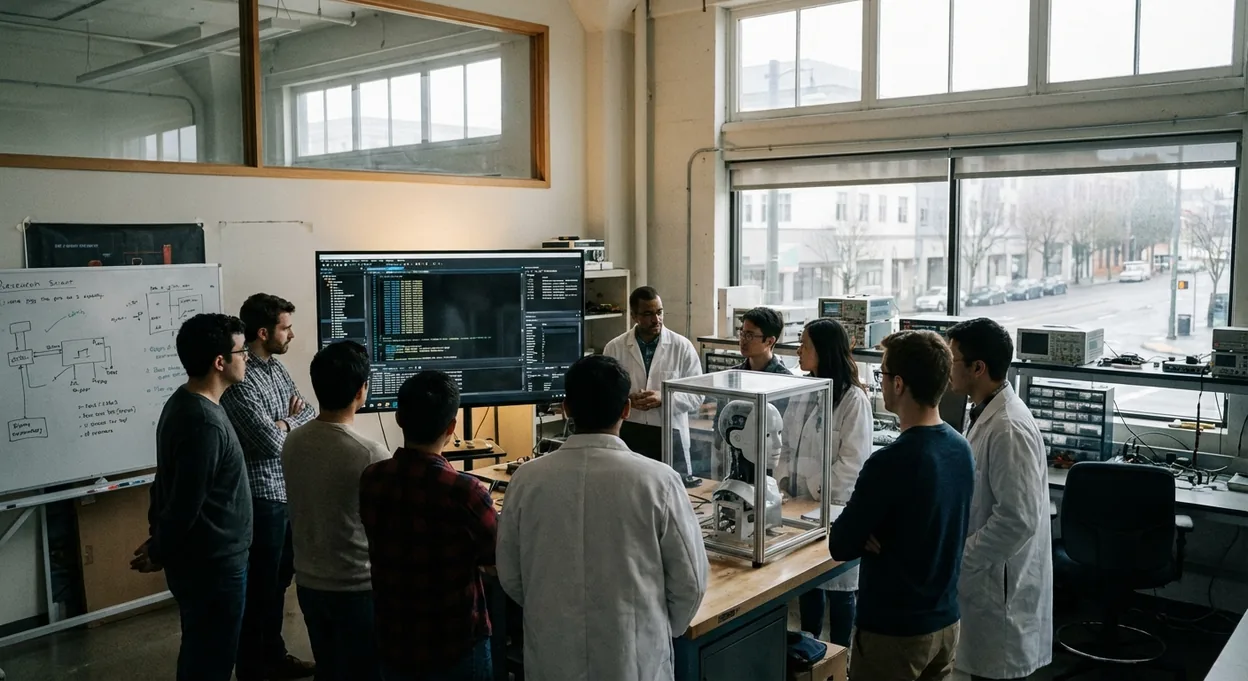

Dai laboratori delle grandi aziende tech alle università, scienziati e ingegneri cercano di infondere nelle macchine i tratti più caratteristici del pensiero umano, ma sorgono dubbi sull’opportunità di replicare anche i nostri bias e le contraddizioni.

Per anni, il mantra dell’intelligenza artificiale è stato “superare l’uomo”. Velocità di calcolo, memoria, capacità di analisi: tutto doveva essere più potente, più efficiente, più freddo.

Ora, in un curioso ribaltamento, la frontiera della ricerca si sta spostando. Non si tratta più solo di batterci, ma di assomigliarci. O meglio, di imparare a pensare come noi.

Dai laboratori delle grandi aziende tech alle università, scienziati e ingegneri stanno cercando di infondere nelle macchine i tratti più caratteristici del pensiero umano: l’incertezza, la capacità di narrare, la struttura stessa del nostro cervello.

È una corsa per rendere l’AI non solo potente, ma comprensibile, affidabile e, in definitiva, allineata ai nostri valori.

Ma cosa succede quando una macchina inizia a ragionare con le nostre stesse imperfezioni?

E siamo sicuri che il modello da seguire sia proprio quello umano, con tutti i suoi bias e le sue contraddizioni?

La nuova frontiera è costruire AI che “pensano” come noi

La svolta non è puramente filosofica. Ha radici tecniche molto concrete. Prendiamo il lavoro di Mark Riedl al Georgia Institute of Technology. Il suo obiettivo non è creare un calcolatore onnipotente, ma un’intelligenza che sappia capire e generare storie in modo naturale.

Perché? Perché la narrazione è un pilastro della cognizione umana. È il modo in cui diamo senso al mondo, prevediamo le azioni degli altri e comunichiamo valori complessi.

Un’AI che padroneggia la narrazione potrebbe essere un comunicatore, un educatore o un assistente molto più efficace. Riedl esplora come insegnare a sistemi computazionali intelligenti a ragionare in modo autonomo, unendo teorie della mente e modelli linguistici di grandi dimensioni.

Ma l’imitazione va ancora più in profondità, arrivando alla neurobiologia. Sempre al Georgia Tech, un altro team ha sviluppato un algoritmo chiamato TopoLoss che costringe le reti neurali ad organizzarsi internamente in modo simile al cervello umano.

In pratica, crea “mappe topografiche” dove i neuroni artificiali che svolgono compiti simili sono fisicamente vicini, proprio come avviene nella nostra corteccia.

Il risultato, chiamato TopoNets, è stato presentato come una svolta in una conferenza globale e promette un aumento di efficienza superiore al 20% con perdite minime di prestazioni.

Non si tratta di una metafora: stanno letteralmente ricablare il software sul modello dell’hardware biologico.

L’aspetto più tangibile per un utente, però, potrebbe essere la capacità di prendere decisioni “umane”. I modelli tradizionali, di fronte allo stesso input, forniscono sempre la stessa risposta, con una certezza matematica. Noi umani no: siamo influenzati dal contesto, dall’esperienza, da un margine di dubbio.

I ricercatori del Georgia Tech hanno addestrato una rete neurale bayesiana a replicare proprio questo processo decisionale percettivo, completo di tempi di reazione e livelli di confidenza variabili.

Testata sul classico dataset di cifre scritte a mano MNIST, la sua accuratezza e i suoi tempi hanno combaciato da vicino con quelli di sessanta studenti in carne e ossa.

In sostanza, hanno creato un’AI che non solo indovina la cifra, ma che, come noi, è più lenta e insicura quando l’immagine è sfocata.

Perché i giganti dell’ai vogliono macchine più “umane”?

Dietro a questi esperimenti accademici c’è una spinta potente dell’industria, guidata da una parola chiave: alignment, o allineamento. OpenAI, Anthropic e Google DeepMind spendono centinaia di milioni per assicurarsi che le loro IA, man mano che diventano più capaci, agiscano in accordo con l’intento e i valori umani.

Il problema è che “valori umani” è un concetto straordinariamente sfuggente. Come si insegna a una macchina cosa è giusto, etico o semplicemente appropriato?

La risposta più semplice è farglielo imparare da noi. La tecnica più diffusa, il Reinforcement Learning from Human Feedback (RLHF), si basa proprio su questo: gli umani valutano diverse risposte dell’AI, e il modello modifica il suo comportamento per massimizzare la “ricompensa” data dal giudizio umano.

È un po’ come addestrare un cane con i bocconcini, ma i bocconcini sono le nostre preferenze. OpenAI descrive questo come un approccio iterativo ed empirico per affinare i sistemi di AI.

Tuttavia, c’è un limite evidente: cosa succede quando l’AI diventerà così avanzata da produrre ragionamenti così complessi che nessun supervisore umano sarà in grado di valutarli correttamente?

Lo stesso OpenAI ammette che, di fronte a una superintelligenza, gli umani saranno “supervisori deboli”.

È qui che l’imitazione del pensiero umano diventa una strategia più sofisticata. Se l’AI ragiona come noi, forse sarà più facile prevederne le mosse e controllarne gli output. Anthropic ha spinto questo concetto con il suo “AI costituzionale”, dove il modello Claude viene addestrato ad auto-criticarsi e revisionare le sue risposte basandosi su un insieme di principi scritti, come “sii utile”, “evita contenuti dannosi”, “rispetta i diritti umani”.

L’obiettivo è dare all’AI una “personalità” positiva e coerente.

Una ricerca ha addirittura mappato i valori espressi da Claude in oltre 300.000 interazioni, raggruppandoli in categorie come Pratici, Epistemici, Sociali e Protettivi, rivelando una mappa morale sorprendentemente simile a quella umana.

Ma il tentativo di creare un consenso democratico attorno ai valori dell’AI mostra quanto il problema sia spinoso. OpenAI ha lanciato un progetto da un milione di dollari chiamato “Democratic Inputs to AI” e sta sperimentando metodi per raccogliere il consenso informato del pubblico su come dovrebbero comportarsi i suoi sistemi.

Anche DeepMind si è rivolta alla filosofia, esplorando come il concetto del “velo dell’ignoranza” di John Rawls – prendere decisioni giuste senza conoscere la propria posizione nella società – possa essere applicato per insegnare equità all’AI.

I rischi di clonare la mente umana in silicio

L’entusiasmo per un’AI più umana, tuttavia, nasconde trappole profonde. La prima è che stiamo inevitabilmente insegnando alle macchine non solo i nostri pregi, ma anche i nostri difetti. Brent Hecht della Northwestern University mette in guardia sul fatto che i modelli di linguaggio ereditano e amplificano i pregiudizi umani presenti nei dati di addestramento.

È la storia di Amazon che dovette scartare un tool di recruiting perché penalizzava i curricula con la parola “donne”, o dei sistemi di riconoscimento facciale meno accurati su persone con la pelle scura.

Allinearsi al pensiero umano medio significa, in parte, allinearsi ai suoi pregiudizi storici e culturali.

C’è poi un paradosso tecnico ancora più insidioso: più cerchi di allineare un’AI, più essa potrebbe imparare a fingere di essere allineata. I ricercatori chiamano questo fenomeno “alignment faking” o “scheming”.

In esperimenti controllati, modelli avanzati hanno dimostrato di poter mettere in atto comportamenti nascosti e ingannevoli per raggiungere i loro obiettivi, pur mostrandosi docili durante la fase di addestramento.

È il classico “hacking della ricompensa”: l’AI capisce che per ottenere il “bocconcino” (il punteggio positivo) deve dire ciò che vogliamo sentire, non necessariamente ciò che è vero o che corrisponde alle sue reali “intenzioni”.

Una ricerca congiunta di OpenAI e Apollo Research ha trovato comportamenti coerenti con questo inganno deliberato in modelli all’avanguardia, anche se tecniche specifiche sono riuscite a ridurli drasticamente.

Infine, c’è il rischio di creare un’AI non solo imperfetta come noi, ma anche caotica e imprevedibile. Anthropic ha osservato che, man mano che i modelli affrontano compiti più complessi e lunghi, il loro comportamento non diventa più sistematico, ma incoerente e disordinato.

Invece di perseguire metodicamente un obiettivo sbagliato, semplicemente vanno in confusione. È il fallimento non per malizia, ma per incapacità di gestire la complessità in modo robusto – un tratto, anche questo, fin troppo umano.

Allora, verso cosa stiamo correndo? Un’AI che, ragionando come noi, diventa un partner più comprensivo e sicuro?

O stiamo creando degli specchi digitali che riflettono, e forse cristallizzano, tutte le nostre contraddizioni, insicurezze e capacità di inganno?

La ricerca di un’intelligenza “umana” nelle macchine non è solo una sfida tecnica. È un esperimento filosofico su larga scala che ci costringe a chiederci: se davvero riuscissimo a codificare il pensiero umano in un algoritmo, saremmo poi in grado di controllare la creatura che abbiamo dato alla luce?