Anthropic ha limitato le capacità di sicurezza del suo modello più potente.

Anthropic ha rilasciato Claude Opus 4.7 con capacità di sicurezza ridotte deliberatamente, mentre OpenAI lancia GPT-5.4-Cyber per cybersecurity. La competizione solleva questioni etiche.

Il modello più avanzato, Mythos, resta nei laboratori perché considerato troppo rischioso per il rilascio pubblico.

Lo scorso 16 aprile, Anthropic ha rilasciato Claude Opus 4.7, il suo modello di intelligenza artificiale più potente generalmente disponibile. L’annuncio porta con sé numeri impressionanti: un miglioramento del 13% nella risoluzione dei task su un benchmark di codifica da 93 prove rispetto al predecessore Opus 4.6, inclusi quattro problemi che né Opus 4.6 né Sonnet 4.6 erano riusciti a risolvere. Capacità di visione aggiornate, con supporto per immagini fino a 2.576 pixel sul lato lungo — più di tre volte rispetto ai modelli precedenti. E un prezzo invariato: 5 dollari per milione di token in input e 25 per milione in output. Fin qui, tutto bene. Ma c’è un dettaglio che Anthropic inserisce quasi di sfuggita, e che vale la pena fermarsi a leggere con attenzione: Opus 4.7 ha capacità informatiche deliberatamente ridotte. Non per un limite tecnico. Per una scelta.

L’annuncio che non dice tutto

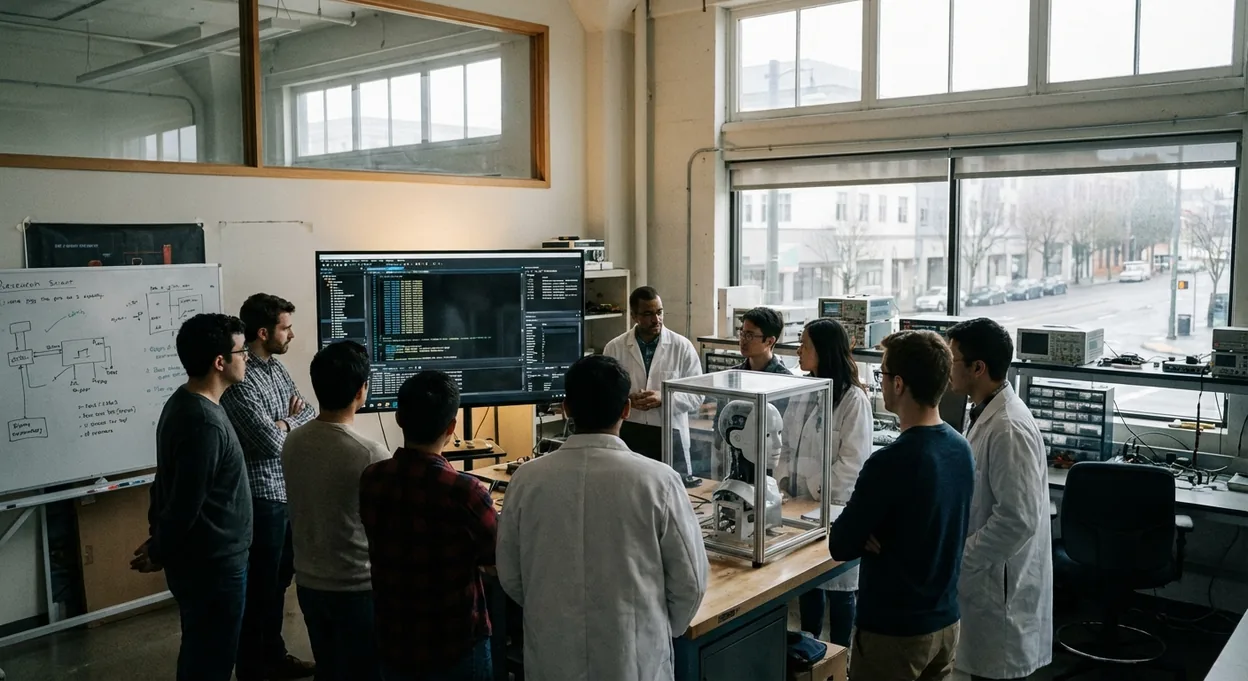

Sul piano pratico, Opus 4.7 è un modello che funziona bene. Gli utenti riferiscono di poter delegare con fiducia i compiti di codifica più complessi — quelli che prima richiedevano supervisione ravvicinata — e di ottenere risultati coerenti su task lunghi e articolati. Il modello pianifica, verifica i propri output, presta attenzione precisa alle istruzioni. È, in sostanza, un assistente di ingegneria software molto capace. La progressione di Anthropic lungo la serie Opus è lineare: Opus 4.5 era già stato presentato come il miglior modello al mondo per codifica, agenti e uso del computer; Opus 4.6 aveva affinato la pianificazione e il debugging su codebase di grandi dimensioni; Opus 4.7 alza ulteriormente l’asticella. Ma proprio mentre Anthropic comunica questi progressi, si trova costretta ad ammettere qualcosa di scomodo: il modello ancora più potente che ha in laboratorio, Claude Mythos Preview, è troppo pericoloso da distribuire senza precauzioni.

Perché proprio ora questo annuncio? La risposta, almeno in parte, è competitiva. Ma il tempismo rivela anche qualcosa di più profondo: Anthropic sa che Mythos esiste, sa cosa può fare, e sa che non può ignorarlo. Opus 4.7 è, in un certo senso, il modello che l’azienda ritiene sicuro abbastanza da mettere in commercio. Il che solleva una domanda ovvia: abbastanza sicuro secondo quali criteri? E deciso da chi?

Il prezzo della sicurezza: un compromesso pericoloso

Ecco il punto che Anthropic non può nascondere, anche se ci prova con un linguaggio tecnico molto misurato. Claude Mythos Preview — il modello che non è ancora generalmente disponibile — ha già trovato migliaia di vulnerabilità ad alta gravità, incluse alcune presenti in ogni sistema operativo e browser web principale. Non è un’ipotesi teorica. È ciò che Anthropic stessa documenta nel progetto Glasswing. Un modello AI capace di mappare le falle di sicurezza di Windows, macOS, Chrome e Firefox non è semplicemente uno strumento potente: è un’arma a doppio uso nel senso più letterale del termine.

Anthropic afferma di aver lavorato durante il training di Opus 4.7 per ridurre differenzialmente queste capacità — una formulazione che suona quasi chirurgica, come se stessero estraendo un organo specifico da un organismo sano. Il modello include ora salvaguardie automatiche che rilevano e bloccano richieste ad alto rischio in ambito cybersecurity. È una scelta comprensibile. È anche, però, una forma di auto-censura tecnica che non ha precedenti dichiarati in questo settore, almeno a questa scala. E qui si apre un problema normativo reale: chi controlla che queste salvaguardie funzionino davvero? Le autorità di regolamentazione europee, già impegnate ad applicare l’AI Act, non hanno ancora strumenti di auditing all’altezza di questa complessità. Il GDPR riguarda i dati personali, non le vulnerabilità zero-day. Il vuoto è evidente.

Il paradosso è questo: Anthropic vende Opus 4.7 come il suo prodotto più potente, ma tiene in laboratorio qualcosa di ancora più capace che non può distribuire perché ritiene il rischio troppo elevato. È come annunciare l’auto più veloce della gamma sapendo che nel garage c’è un prototipo che non puoi portare su strada. L’onestà di questa ammissione è rara nel settore. Ma non risolve il problema: se Mythos è troppo pericoloso per essere rilasciato, cosa succede quando qualcun altro arriva allo stesso livello senza gli stessi scrupoli?

La gara competitiva e il futuro dell’IA

OpenAI non sta aspettando. Mentre Anthropic procede con cautela, la rivale ha annunciato GPT-5.4, un modello che incorpora le capacità di codifica di GPT-5.3-Codex e compete direttamente con Opus 4.7 su coding, ragionamento e flussi di lavoro agentici. Ma la mossa più significativa di OpenAI è un’altra: il lancio di GPT-5.4-Cyber, una variante addestrata specificamente per essere “cyber-permissiva”, distribuita attraverso il programma Trusted Access for Cyber a migliaia di difensori individuali verificati e centinaia di team responsabili della protezione di software critici. OpenAI, in altri termini, sta facendo esattamente ciò che Anthropic ha scelto di non fare: abilitare esplicitamente le capacità di cybersecurity avanzata, ma attraverso un sistema di accesso controllato. Quale approccio sia più sicuro — la limitazione tecnica di Anthropic o il controllo degli accessi di OpenAI — è una domanda aperta che i regolatori non hanno ancora affrontato seriamente. Nel frattempo, anche Google con Gemini 3.1 Pro spinge sul ragionamento avanzato per i task più complessi, consolidando un campo competitivo in cui nessuno ha intenzione di rallentare.

La vera domanda, allora, non è se Claude Opus 4.7 sia un buon modello. Lo è. La domanda è se le scelte di sicurezza che Anthropic ha incorporato nel suo training abbiano un valore duraturo in un mercato dove i concorrenti stanno percorrendo strade diverse con altrettanta determinazione. Stiamo assistendo a una corsa in cui alcune aziende frenano deliberatamente, altre accelerano con sistemi di controllo, e nessuna sa con certezza dove portano le piste. Chi stabilirà le regole prima che sia troppo tardi? Per ora, la risposta onesta è: nessuno. E questo dovrebbe preoccuparci molto più di qualsiasi benchmark di codifica.

Mentre Claude Opus 4.7 cerca di bilanciare potenza e responsabilità, il silenzio sul futuro di Mythos e l’avanzata di GPT-5.4-Cyber lasciano aperta una domanda che il mercato, da solo, non è attrezzato a rispondere: stiamo costruendo guardiani o mostri? La risposta dipenderà meno dalla tecnologia e molto di più da chi avrà il coraggio — o il potere — di imporre le regole.