L’Asterisco nell’IA Generativa: La Disconnessione tra Marketing e Realtà Tecnica

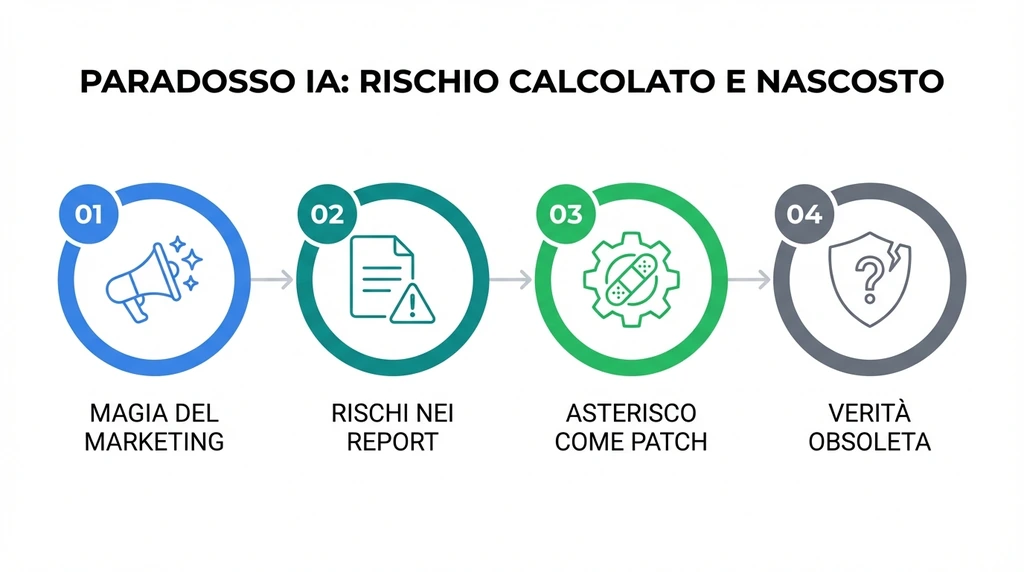

Tra marketing ingannevole e onestà intellettuale, l’industria tecnologica si nasconde dietro un asterisco per monetizzare l’IA, mettendo in discussione il concetto stesso di verità

Se c’è un carattere tipografico che definisce l’industria tecnologica alla fine del 2025, non è più il simbolo del prompt dei comandi o lo slash degli indirizzi web: è l’asterisco.

Piccolo, spesso grigio chiaro su sfondo bianco, posizionato strategicamente alla fine di slogan trionfali sull’intelligenza artificiale generativa.

L’asterisco è diventato il punto di sutura tra due realtà inconciliabili: quella del marketing, che vende l’IA come una magia deterministica e infallibile, e quella dell’ingegneria, che sa bene di aver costruito sistemi probabilistici intrinsecamente propensi all’errore.

Questa dicotomia non è accidentale, ma strutturale. Chi scrive codice sa che un algoritmo di machine learning non “sa” nulla; calcola la probabilità che il token successivo sia quello corretto.

Tuttavia, vendere “probabilità statistica” non emoziona gli investitori. Vendere “certezza” sì.

Il risultato è un’architettura della comunicazione dove il titolo promette la rivoluzione e il footer, in corpo 8, si manleva da ogni responsabilità se la rivoluzione dovesse allucinare, sbagliare target o violare il copyright.

La scatola nera dell’adtech

Il settore dove questa tensione è più evidente — e tecnicamente più imbarazzante — è l’AdTech. Qui, aziende che muovono miliardi di dollari in pubblicità programmatica vendono la “Brand Safety” (la garanzia che il tuo annuncio non finisca su siti di disinformazione o contenuti estremisti) come un problema risolto grazie all’IA.

La narrazione è affascinante: algoritmi avanzati scansionano il web in tempo reale e proteggono gli inserzionisti con precisione chirurgica.

La realtà tecnica, però, racconta una storia diversa. Sotto il cofano, questi sistemi spesso faticano a comprendere il contesto semantico complesso, portando a falsi positivi o, peggio, a classificazioni errate che drenano budget.

Eppure, la comunicazione ufficiale ignora questi limiti intrinseci. In documenti depositati presso la SEC, le aziende adtech promuovono l’uso dell’intelligenza artificiale per garantire risultati superiori e una precisione quasi assoluta, mentre analisi indipendenti mostrano ancora annunci di brand prestigiosi accanto a contenuti tossici.

Questa discrepanza non è solo una questione di performance, ma di onestà intellettuale verso la tecnologia stessa. Quando Lisa Utzschneider, CEO di Integral Ad Science (IAS), parla agli investitori, il messaggio è inequivocabile: l’IA è presentata come un sistema di verità, non di stima.

Nella chiamata di oggi, parlerò dell’importanza dell’integrità dei dati e della nostra affidabile tecnologia supportata dall’IA […] I marketer si fidano di IAS per proteggere, misurare, informare e ottimizzare le loro campagne. La loro fiducia si basa sull’accuratezza e l’affidabilità dei nostri dati. L’integrità dei dati è critica e intrinseca in tutti i report e gli insight che forniamo in ogni aspetto del nostro business. La data science è al centro della nostra strategia aziendale. I nostri sistemi di IA abilitano modelli che forniscono classificazioni e analisi a velocità maggiore e scalabili con una precisione estremamente elevata […].

— Lisa Utzschneider, Chief Executive Officer presso Integral Ad Science (IAS)

Mentre i dirigenti vantano una “precisione estremamente elevata”, i termini di servizio — l’equivalente legale del codice sorgente — raccontano che nessun sistema è perfetto e che il cliente accetta il rischio.

È il classico pattern del software proprietario: fidati della scatola nera, ma non guardare dentro.

E se la scatola nera sbaglia, l’asterisco ci aveva avvisato.

L’interfaccia dell’evasione

Se nel B2B il problema è nei contratti, nel mercato consumer la battaglia si gioca sulla User Interface (UI). Qui l’obiettivo è ridurre l’attrito cognitivo.

Un’etichetta che dice “Generato da un’IA che potrebbe inventare fatti” uccide l’engagement. Un’etichetta che dice “AI Info” è invece abbastanza neutra da essere ignorata dalla maggior parte degli utenti, pur fornendo copertura legale all’azienda.

Meta, ad esempio, ha modificato il suo approccio nel corso dell’ultimo anno. Di fronte alle critiche sulla difficoltà di distinguere il reale dal sintetico, la risposta non è stata aumentare la visibilità del disclaimer, ma renderlo parte del rumore di fondo dell’interfaccia.

In una mossa che mescola design minimalista e opacità strategica, la piattaforma ha aggiornato l’etichetta Made with AI in una più neutra AI info, che richiede un click attivo dell’utente per rivelare il contesto reale della generazione del contenuto.

Mentre lavoriamo con le aziende di tutto il settore per migliorare il processo affinché il nostro approccio all’etichettatura corrisponda meglio alle nostre intenzioni, stiamo aggiornando l’etichetta ‘Made with AI’ in ‘AI info’ su tutte le nostre app, sulla quale le persone possono cliccare per maggiori informazioni.

— Meta Platforms, Inc., Dichiarazione sulla policy della piattaforma

Tecnicamente, stiamo assistendo alla normalizzazione del “dark pattern” applicato alla trasparenza. TripAdvisor adotta una strategia simile: un’icona a forma di diamante e una “i” informativa spiegano che la descrizione dell’hotel è generata dall’IA e che la piattaforma “non è responsabile”.

L’informazione c’è, ma è incapsulata in un oggetto UI che l’utente è addestrato a ignorare.

È un’implementazione che soddisfa il requisito legale (“abbiamo avvisato l’utente”) fallendo però quello funzionale (“l’utente ha capito”).

Questo approccio sposta interamente il carico del debugging sul consumatore finale. Non è più il sistema a dover garantire la veridicità dell’output; è l’utente a dover verificare se l’algoritmo ha allucinato.

Un capovolgimento di paradigma notevole rispetto a software deterministici del passato, dove un errore di calcolo era considerato un bug, non una “feature creativa”.

Il rischio calcolato nei file .logs

La vera ironia è che le aziende sanno perfettamente quanto i loro modelli siano instabili. Basta guardare dove non c’è marketing: nei report finanziari obbligatori.

Qui, il tono cambia radicalmente. Non ci sono “magie” o “rivoluzioni”, ma elenchi dettagliati di failure cases.

È interessante notare come la consapevolezza tecnica dei rischi sia ormai diffusa ai vertici, ma venga segregata nei documenti che nessuno legge.

Infatti, un recente studio ha evidenziato che 7 grandi aziende americane su 10 segnalano i rischi dell’IA nelle comunicazioni pubbliche, includendo danni reputazionali e malfunzionamenti critici. Questo è il “backend” della comunicazione aziendale: logiche di protezione del capitale che riconoscono implicitamente i limiti dell’architettura tecnica attuale.

Siamo quindi di fronte a un paradosso tecnologico. Abbiamo costruito i sistemi più complessi della storia umana — Large Language Models con miliardi di parametri — ma l’interfaccia principale per gestirne i fallimenti è una riga di testo in piccolo o un’icona cliccabile.

L’asterisco non è una soluzione tecnica; è una patch applicata sopra un problema di affidabilità che l’industria non ha ancora risolto, ma che ha fretta di monetizzare.

La domanda che rimane sospesa non è se questi sistemi miglioreranno, ma se nel frattempo l’abuso di questi disclaimer finirà per rendere il concetto stesso di “verità” un termine obsoleto, valido solo previa accettazione dei termini e condizioni.