Intelligenza artificiale: tra hype finanziario e complessità ingegneristica

Tra ottimismo finanziario e complessità ingegneristica, il 2025 segna il passaggio dalla “demo” alla produzione, dove scalabilità e costi infrastrutturali diventano i veri banchi di prova per il futuro dell’IA.

Se c’è una cosa che i grafici a torta e le proiezioni di mercato faticano a raccontare, è la complessità ingegneristica che si nasconde dietro una “previsione di crescita”. Quando leggiamo di un mercato dell’Intelligenza Artificiale destinato a esplodere verso i 1.800 miliardi di dollari entro il 2030, la reazione istintiva di chi lavora nel codice è mista: da un lato c’è la validazione di anni di notti insonni passate a ottimizzare pesi e bias; dall’altro, c’è il timore che l’hype finanziario stia correndo molto più veloce dell’infrastruttura reale.

Siamo alla fine del 2025 e la narrazione è cambiata. Non siamo più nella fase dello stupore infantile per un chatbot che scrive una poesia in rima baciata.

Quella fase, tecnicamente parlando, era la “demo”.

Ora siamo nella fase di produzione, quella dove i nodi vengono al pettine, dove la scalabilità diventa un problema di fisica termodinamica più che di software, e dove le aziende devono giustificare spese in conto capitale faraoniche.

Un recente rapporto ha messo nero su bianco queste aspettative, sottolineando come il mercato dell’IA sia proiettato a crescere da 184 miliardi nel 2024 a oltre 1,8 trilioni nel 2030, spinto non solo dall’entusiasmo, ma da un’adozione aziendale che sta iniziando a permeare settori insospettabili. Tuttavia, per comprendere se questi numeri siano solidi o se stiamo costruendo castelli su fondamenta di sabbia digitale, dobbiamo guardare sotto il cofano della tecnologia stessa e analizzare come si è evoluta l’architettura dei sistemi che oggi diamo per scontati.

L’architettura del boom

Per un tecnico, la vera notizia non è il valore in dollari, ma il come ci siamo arrivati. La crescita esponenziale che stiamo osservando oggi non è figlia del caso, ma il risultato ritardato di un cambio di paradigma avvenuto quasi un decennio fa.

Sebbene il pubblico generalista abbia scoperto l’IA generativa solo nel 2022 con ChatGPT, le fondamenta sono state gettate nel 2017. È stato allora che l’architettura Transformer ha cambiato tutto, permettendo ai modelli di parallelizzare l’addestramento in modo massiccio, superando i limiti delle reti ricorrenti (RNN) che processavano i dati in sequenza, parola per parola.

Senza quella specifica eleganza matematica — la capacità di “prestare attenzione” a tutte le parti di un input simultaneamente — non avremmo i Large Language Models (LLM) di oggi. E non avremmo nemmeno le proiezioni di mercato attuali.

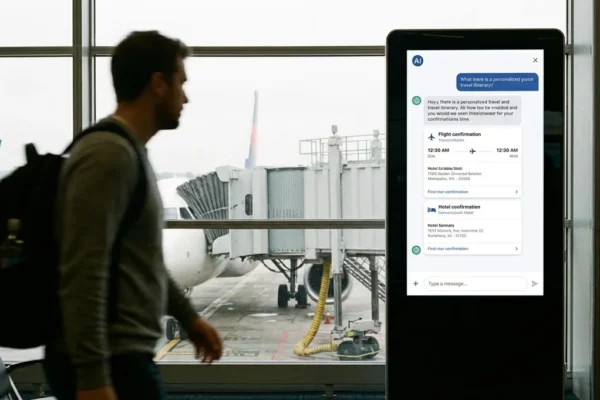

Ciò che vediamo nel 2025 è l’industrializzazione di quel concetto. Non stiamo più parlando solo di generare testo, ma di sistemi multimodali e, soprattutto, di “Agentic AI”, ovvero intelligenze artificiali capaci di agire in autonomia su sistemi esterni.

Prevediamo che il mercato del software IA crescerà a un tasso annuo composto del 42% fino al 2028, alimentato da modelli multimodali e sistemi di IA agentica.

— Sarah Linden, Senior Research Analyst presso CB Insights

L’idea di “IA agentica” è tecnicamente affascinante perché sposta l’asse dall’inferenza statica (chiedo, ottengo risposta) all’esecuzione dinamica (chiedo, l’IA pianifica, esegue chiamate API, verifica il risultato, corregge). È qui che il valore economico si moltiplica, ma è anche qui che la complessità tecnica esplode. Un sistema che agisce deve essere affidabile al 99,9%, non all’80%.

E chiunque abbia mai fatto debug su una catena di prompt sa quanto sia fragile questo equilibrio.

Eppure, le aziende stanno investendo. E non parlo solo delle solite big tech della Silicon Valley. C’è un movimento sotterraneo, spesso ignorato dalla stampa mainstream, che riguarda l’economia reale. L’adozione non sta avvenendo solo nei laboratori di ricerca, ma nelle PMI del Midwest americano, nelle aziende agricole e nelle catene di fornitura. È un tessuto imprenditoriale pragmatico, che non cerca la singolarità tecnologica, ma un aumento del margine operativo lordo.

Il collo di bottiglia fisico

Tuttavia, c’è un “elephant in the server room” che spesso viene omesso nelle presentazioni agli investitori: l’hardware. L’eleganza del software si scontra brutalmente con la realtà fisica. Addestrare e far girare questi modelli richiede una potenza di calcolo che sta mettendo sotto pressione la catena di approvvigionamento globale dei semiconduttori e le reti elettriche.

I cosiddetti “Hyperscalers” (AWS, Azure, Google Cloud) stanno spendendo cifre che farebbero impallidire il PIL di piccole nazioni per costruire data center. Non si tratta solo di comprare GPU; si tratta di ridisegnare l’architettura dei datacenter per gestire densità termiche che fino a cinque anni fa erano impensabili.

L’investimento infrastrutturale è la scommessa più grande e rischiosa di questo decennio.

Se l’adozione lato utente non dovesse scalare in proporzione ai costi dell’infrastruttura, ci troveremmo di fronte a una bolla di overprovisioning spettacolare. Ma i segnali di mercato sembrano ignorare questo rischio, o quantomeno considerarlo calcolato. Le aziende tradizionali stanno accelerando i deployment, non per moda, ma per paura di obsolescenza.

Le imprese stanno accelerando i deployment di IA, con il 65% che prevede di aumentare i budget di almeno il 25% nel 2025, segnalando un robusto slancio di mercato.

— Rajesh Patel, VP of Market Intelligence presso Gartner Research

Questo aumento di budget non finisce tutto in licenze software. Una parte significativa viene assorbita dalla “tech debt” necessaria per pulire i dati. Perché, come ogni sviluppatore sa, un modello allo stato dell’arte è inutile se alimentato da un database frammentato e sporco. La vera rivoluzione silenziosa del 2025 è la massiccia operazione di pulizia e strutturazione dei dati aziendali, un lavoro ingrato ma essenziale che sta creando un mercato parallelo di consulenza e strumenti MLOps (Machine Learning Operations).

Questa spinta all’adozione ha però creato una frattura interessante. Mentre le grandi corporation costruiscono modelli fondazionali proprietari, le piccole e medie imprese si trovano a navigare in un mare di API e servizi terzi, cercando di capire come integrare queste tecnologie senza diventarne schiave.

La frizione normativa e la realtà operativa

Qui entriamo nel territorio dove la tecnica incontra la burocrazia. Uno degli ostacoli maggiori per gli sviluppatori oggi non è il limite del contesto dei token o la latenza dell’inferenza, ma l’incertezza normativa. Integrare l’IA in processi critici richiede garanzie che spesso le “black box” delle reti neurali non possono dare per definizione.

Inoltre, c’è il problema della frammentazione. Negli Stati Uniti, ad esempio, si sta assistendo a un fenomeno preoccupante per chi deve scrivere codice scalabile: ogni stato sta iniziando a legiferare per conto proprio. Per una PMI o una startup, dover gestire compliance diverse per l’Arkansas, la California e l’Europa è un incubo logistico che drena risorse dallo sviluppo puro.

Nonostante ciò, i dati sull’adozione sono sorprendenti. Un recente report della Camera di Commercio USA ha evidenziato come il 61% delle piccole imprese in Arkansas utilizzi già piattaforme di IA, una cifra che supera quella di stati tecnologicamente più blasonati come il Texas o la Pennsylvania. Questo dato è cruciale: dimostra che gli strumenti low-code e le interfacce conversazionali hanno abbattuto la barriera all’ingresso tecnica. Non serve più un team di Data Scientist con dottorato per implementare soluzioni di efficienza; basta un’API ben documentata e un po’ di intraprendenza tecnica.

Questa democratizzazione, però, porta con sé dei rischi tecnici non indifferenti. L’uso di “wrapper” (interfacce leggere sopra modelli giganti) espone le aziende a dipendenze critiche. Se il fornitore del modello cambia i pesi, o l’allineamento di sicurezza, o il pricing, l’intera applicazione a valle può rompersi o diventare economicamente insostenibile da un giorno all’altro.

È la classica vulnerabilità della supply chain software, elevata all’ennesima potenza.

Inoltre, c’è una nota di scetticismo che arriva dai settori più tradizionali, come l’agricoltura, che guardano a questa esplosione con un occhio ai cicli storici. L’eccesso di investimento attuale porterà inevitabilmente a un consolidamento. Molte delle soluzioni che oggi vengono vendute come rivoluzionarie sono, a un’analisi tecnica rigorosa, poco più che demo glorificate prive di una reale robustezza ingegneristica.

Il 2025 si sta rivelando l’anno della verità.

La tecnologia alla base, in particolare l’architettura introdotta con il paper “Attention Is All You Need” nel 2017, ha dimostrato di essere solida e incredibilmente versatile. Ma il mercato che vi è stato costruito sopra è febbrile. La discrepanza tra il valore tecnico reale (automazione del codice, analisi dati, generazione creativa assistita) e le valutazioni finanziarie (che prezzano una sostituzione totale del lavoro cognitivo umano) è la tensione che definirà i prossimi cinque anni.

Siamo di fronte a una trasformazione irreversibile, certo.

Ma come tecnici, abbiamo il dovere di distinguere tra l’eleganza di un algoritmo che apprende e la brutalità di un mercato che cerca solo il prossimo hype da cavalcare. La domanda non è se l’IA raggiungerà i 1.800 miliardi di valore, ma quanto codice “spaghetti”, debito tecnico e server surriscaldati dovremo gestire per arrivarci.