L’Intelligenza Artificiale nell’Istruzione: dal Panico all’Integrazione nel Minnesota

Dall’iniziale panico per l’IA generativa all’integrazione consapevole: come le università del Minnesota stanno riscrivendo il futuro dell’istruzione

Siamo alla fine del 2025 e la polvere sollevata dal “Big Bang” dell’IA generativa si è depositata, rivelando un panorama educativo profondamente mutato, non distrutto.

Tre anni fa, quando ChatGPT fece il suo debutto pubblico, la reazione immediata del mondo accademico fu un mix di panico tecnico e burocratico: firewall frettolosi, policy di divieto totali e una fiducia mal riposta nei software di “detection” che promettevano di distinguere la prosa umana da quella sintetica.

Dal punto di vista ingegneristico, era una battaglia persa in partenza: cercare di identificare pattern probabilistici in un output progettato specificamente per mimare il linguaggio naturale è un esercizio di futilità computazionale.

Oggi, guardando a come le istituzioni del Minnesota – un microcosmo perfetto per osservare queste dinamiche – hanno gestito la transizione, notiamo che l’approccio è passato dal blocco alla gestione dell’infrastruttura.

Non si tratta più di chiedersi se uno studente stia usando un LLM (Large Language Model), ma di capire come integrare queste chiamate API nel flusso di lavoro accademico senza atrofizzare il pensiero critico.

È la differenza tra vietare la calcolatrice e insegnare a capire la logica matematica prima di premere i tasti.

La vera rivoluzione non è avvenuta nel software, ma nell’hardware dell’istruzione stessa: la metodologia di verifica.

La fine del “compito a casa” come lo conoscevamo

Per decenni, il sistema universitario si è basato su un protocollo standard: assegnazione del task, esecuzione asincrona (a casa), valutazione dell’output.

Questo stack è crollato nel momento in cui il costo marginale della produzione di testo sintattico è sceso a zero. I professori del Minnesota, così come i loro colleghi globali, hanno dovuto prendere atto di una realtà tecnica ineludibile: se l’output è falsificabile con un prompt, il processo di valutazione deve spostarsi sull’input o sull’esecuzione in tempo reale.

Rob Vischer, presidente dell’Università di St. Thomas, ha inquadrato la questione con una lucidità rara per un amministratore, riconoscendo che la tecnologia è diventata un livello infrastrutturale permanente.

Indipendentemente dalle opinioni sull’intelligenza artificiale — che la si ami, la si odi, ne siate incuriositi o terrorizzati — non si può negare che sia qui e non andrà via. Nell’istruzione superiore, molte università stanno ripensando i loro curricula per insegnare agli studenti le competenze necessarie per sviluppare una competenza nell’IA.

— Rob Vischer, Presidente della University of St. Thomas

Questo ripensamento ha portato a un ritorno, ironicamente analogico, alle origini: esami orali, scrittura in aula senza dispositivi, e difese di progetti complessi.

Ma c’è anche un’integrazione tecnica più raffinata.

Invece di combattere l’automazione, l’Università di St. Thomas ha esplicitato la necessità di ridisegnare i curricula per includere l’IA come strumento, spostando il focus dalla generazione del contenuto alla sua validazione e critica.

Se l’IA scrive il codice o il saggio, lo studente deve fare il debug o l’editing, dimostrando di comprendere ciò che la macchina ha “allucinato” o prodotto correttamente.

Tuttavia, accettare la presenza dell’IA non significa aprire le porte a qualsiasi servizio cloud di terze parti senza controllo.

Sovranità dei dati e “shadow IT”

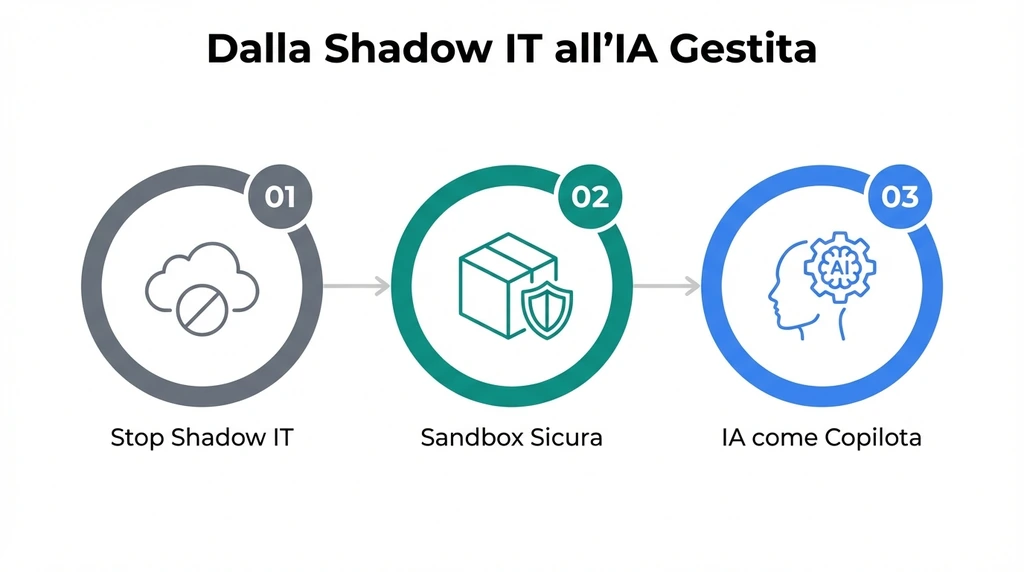

Uno dei problemi meno discussi, ma tecnicamente più critici dell’adozione dell’IA nelle scuole, è stato il fenomeno dello “Shadow IT”: studenti e docenti che utilizzavano account personali su piattaforme pubbliche, inviando potenzialmente dati sensibili o proprietari a server esterni per l’addestramento dei modelli futuri.

La risposta istituzionale nel 2025 è stata quella di centralizzare e “sanificare” l’accesso.

L’Università del Minnesota (UMN) ha adottato un approccio che ricorda le best practice aziendali DevOps. Invece di lasciare gli utenti in balia di tool non verificati, l’ufficio legale e i sistemi informativi hanno implementato l’approvazione di specifici strumenti di AI per garantire la protezione dei dati e la privacy, creando un ambiente “sandbox” sicuro.

Questo permette l’utilizzo della potenza computazionale degli LLM senza esporre l’istituzione a rischi legali o di sicurezza, una mossa che dimostra una maturità tecnica notevole rispetto ai divieti ciechi del 2023.

Questa normalizzazione ha permesso esperimenti didattici interessanti. Al Minnesota State College Southeast, ad esempio, si tenta di quantificare l’uso dell’IA, limitando il contenuto generato artificialmente al 25% in alcuni compiti.

Sebbene tecnicamente difficile da applicare con precisione (come si misura il 25% di un’idea?), il principio sottolinea un cambio di paradigma: l’IA è vista come un copilot, non come il pilota automatico.

È un tentativo di mantenere l’umano “in the loop”, garantendo che la cognizione biologica rimanga la forza motrice dietro l’output digitale.

Ma l’accesso agli strumenti è inutile, se non dannoso, senza la comprensione di come funzionano “sotto il cofano”.

Il problema della “scatola nera”

Il rischio maggiore che corriamo oggi non è che gli studenti usino l’IA per barare, ma che la usino fidandosi ciecamente del risultato.

Un LLM non “sa” nulla; è un motore statistico che prevede il token successivo più probabile in una sequenza.

La sua “conoscenza” è una rappresentazione vettoriale di correlazioni linguistiche, non una comprensione semantica della realtà. Senza questa consapevolezza tecnica, l’uso dell’IA diventa pericoloso.

Sohyun Cho, dell’Università del Minnesota, ha evidenziato come la sfida si sia spostata dalla prevenzione all’etica e alla competenza tecnica.

Stiamo vedendo testi generati dall’IA in quasi tutti i corsi ad alta intensità di scrittura ora. La questione non è se gli studenti la useranno, ma se capiscono come usarla eticamente.

— Sohyun Cho, Assistant Professor of Writing Studies presso la University of Minnesota

Per colmare questo gap, le istituzioni stanno investendo pesantemente non solo in licenze software, ma in capitale umano e strutture dedicate. Questo trend è evidente con il lancio di istituti dedicati all’intelligenza artificiale applicata in atenei come la Minnesota State University Moorhead, che mirano a formare non solo utenti passivi, ma professionisti capaci di governare questi sistemi.

La formazione si sta spostando sul “prompt engineering” avanzato e, soprattutto, sulla validazione dell’output.

Se il modello genera codice Python sintatticamente corretto ma logicamente fallato, o un saggio storicamente plausibile ma fattualmente errato, solo uno studente con una solida preparazione di base può accorgersene.

L’IA, paradossalmente, richiede che gli umani siano ancora più esperti, non meno.

Siamo di fronte a un bivio evolutivo per l’istruzione. Da una parte c’è la tentazione di appoggiarsi alla comodità dell’automazione, creando una generazione di operatori che sanno “chiedere” alla macchina ma non sanno verificare la risposta.

Dall’altra, c’è l’opportunità di elevare il livello dell’insegnamento, delegando alla macchina la sintassi e pretendendo dagli studenti una semantica e una logica di livello superiore.

La tecnologia è neutrale, ma la sua implementazione non lo è mai.

Stiamo costruendo architetti del pensiero o semplici manutentori di prompt?