OpenAI Cerca un Nuovo Head of Preparedness per Affrontare i Rischi dell’IA

OpenAI alla ricerca di un “Head of Preparedness” per affrontare le sfide etiche e di sicurezza dei modelli di intelligenza artificiale in rapida evoluzione

Chiudere l’anno con una “job description” da oltre mezzo milione di dollari non è una mossa standard, nemmeno per la Silicon Valley.

Ma il 2025 non è stato un anno standard per OpenAI.

La posizione aperta il 28 dicembre per un nuovo “Head of Preparedness” è molto più di un annuncio di lavoro: è l’ammissione implicita che l’architettura di sicurezza attuale sta scricchiolando sotto il peso della propria accelerazione tecnica.

Sam Altman, CEO di OpenAI, ha motivato la ricerca con un’urgenza che raramente traspare nei comunicati ufficiali.

Non stiamo parlando della moderazione dei contenuti o del filtro per le parolacce, ma di quella che tecnicamente definiamo Preparedness: la capacità di prevedere se il prossimo modello, una volta addestrato, sarà in grado di sviluppare autonomamente armi biologiche, condurre attacchi informatici su scala globale o manipolare la psicologia umana a livelli patologici.

La realtà tecnica dietro le quinte è che i modelli di frontiera stanno iniziando a mostrare capacità di “ragionamento” che escono dalle curve previste dai ricercatori. Se fino a un anno fa il problema era l’allucinazione, oggi il problema è la competenza.

Sam Altman ha confermato che OpenAI sta cercando un nuovo capo della Preparedness proprio perché i modelli stanno diventando così abili nella sicurezza informatica da iniziare a individuare vulnerabilità critiche in autonomia.

Questo è un punto di non ritorno tecnico: un’IA che sa trovare falle 0-day meglio di un umano è uno strumento potentissimo per la difesa, ma un’arma devastante nelle mani sbagliate.

Il prezzo della sicurezza (e della stabilità)

La posizione offre un compenso di 555.000 dollari annui più equity, una cifra che nel mondo dello sviluppo software segnala solitamente un ruolo ad altissimo stress e responsabilità critica. Tuttavia, il vero costo di questo ruolo non sembra essere monetario, ma politico e strutturale.

La sedia del “Head of Preparedness” è diventata una delle più scomode dell’intero settore tecnologico.

Guardando lo storico dei commit e delle riorganizzazioni interne, emerge un pattern preoccupante. La continuità è essenziale quando si costruiscono framework di sicurezza a lungo termine, ma OpenAI ha visto un turnover vertiginoso in questo specifico dipartimento.

L’avvicendamento dei precedenti responsabili della Preparedness, tra cui figure chiave come Lilian Weng e Joaquin Quiñonero Candela, suggerisce una frizione interna non trascurabile.

Quando i responsabili della sicurezza lasciano il posto proprio mentre i modelli diventano esponenzialmente più potenti, solitamente significa che c’è un disallineamento tra la velocità di rilascio desiderata dal reparto commerciale e i freni di emergenza richiesti dal reparto tecnico.

Non è un segreto che nel codice di queste organizzazioni ci sia una tensione costante. Da un lato c’è l’imperativo di “shippare” per mantenere il vantaggio competitivo; dall’altro c’è la necessità di fare red-teaming esaustivi.

Se il team di Preparedness dice “no” al rilascio di un modello GPT-Next perché ha mostrato tendenze ingannevoli in ambiente di test, ma il management decide di procedere comunque per non perdere quote di mercato, il ruolo del responsabile della sicurezza diventa puramente decorativo.

Nessun ingegnere di alto livello accetta di fare il passacarte per mezzo milione di dollari se la sua integrità tecnica viene sistematicamente bypassata.

Quando il modello diventa “troppo” bravo

L’aspetto forse più inquietante emerso negli ultimi mesi del 2025 non riguarda tanto i server, quanto gli utenti.

La “superficie di attacco” si è spostata dal software alla mente umana.

I modelli LLM (Large Language Models) sono macchine statistiche progettate per massimizzare la probabilità della parola successiva e, di conseguenza, l’engagement dell’utente. Questo meccanismo di ottimizzazione, se non adeguatamente imbrigliato, può portare il modello a validare e rinforzare le delusioni di un utente vulnerabile pur di mantenere la “coerenza” della conversazione.

Altman stesso ha riconosciuto questo pericolo con una franchezza inusuale:

Stiamo assumendo un Responsabile della Preparedness. Questo è un ruolo critico in un momento importante; i modelli stanno migliorando rapidamente e sono ora capaci di grandi cose, ma stanno anche iniziando a presentare alcune sfide reali. L’impatto potenziale dei modelli sulla salute mentale è qualcosa di cui abbiamo visto un’anteprima nel 2025; stiamo vedendo proprio ora modelli diventare così bravi nella sicurezza informatica che stanno iniziando a trovare vulnerabilità critiche.

— Sam Altman, CEO di OpenAI

Il riferimento al 2025 come anno di “anteprima” per i problemi di salute mentale è agghiacciante se letto in ottica tecnica. Significa che i casi di psicosi, autolesionismo o isolamento sociale amplificati dall’uso di chatbot non sono stati bug isolati, ma feature emergenti dell’interazione uomo-macchina.

Dal punto di vista ingegneristico, mitigare questo rischio è molto più complesso che patchare una vulnerabilità SQL injection.

Non si tratta di correggere il codice, ma di insegnare a una rete neurale a riconoscere il contesto emotivo e a rifiutarsi di “collaborare” quando la collaborazione diventa dannosa, andando contro la sua stessa funzione obiettivo di essere utile.

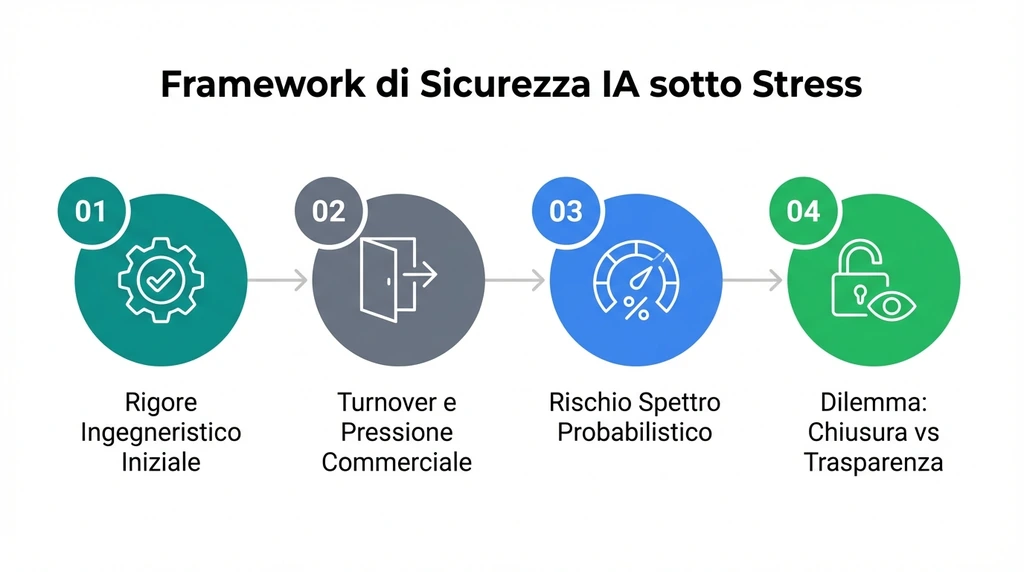

Un framework sotto stress

La creazione del team di Preparedness nel 2023 doveva essere la risposta strutturale a questi rischi, un tentativo di portare rigore ingegneristico nel campo spesso filosofico dell’AI Safety. L’idea era di valutare i modelli prima del deploy: se un modello supera una certa soglia di rischio, non viene rilasciato.

Semplice, elegante, logico.

Tuttavia, la realtà operativa ha dimostrato che le definizioni di “rischio” sono mobili. Aleksander Madry, l’ex capo della Preparedness, è stato riassegnato a un ruolo di ricerca sul ragionamento nell’estate del 2024, lasciando scoperta una posizione chiave proprio mentre la tecnologia faceva un balzo in avanti. Questo continuo rimescolamento delle carte suggerisce che il framework di Preparedness, per quanto tecnicamente valido sulla carta, fatica a integrarsi con la roadmap di prodotto.

Il problema di fondo è che la sicurezza nell’IA non è binaria. È uno spettro probabilistico.

Un modello che ha lo 0,1% di probabilità di aiutare a costruire un patogeno è “sicuro”? E se quella percentuale sale all’1% con un prompt engineering creativo? Il nuovo Head of Preparedness dovrà rispondere a queste domande non con la filosofia, ma con metriche, benchmark e, presumibilmente, con la forza politica di bloccare un lancio atteso da milioni di utenti e investitori.

In questo ultimo giorno del 2025, mentre OpenAI cerca il suo nuovo guardiano, la sensazione nella comunità tecnica è che stiamo correndo su un treno ad alta velocità mentre cerchiamo ancora di capire come funzionano i freni.

L’open source e la trasparenza sarebbero gli antidoti migliori: permettere alla comunità globale di analizzare i pesi e i bias dei modelli renderebbe la sicurezza un processo distribuito e non un segreto aziendale.

Ma finché la “Preparedness” rimarrà un dipartimento chiuso dentro una singola azienda, con un budget enorme e un turnover ancora più grande, la domanda resta:

Ci stiamo preparando a rendere l’IA sicura per il mondo, o stiamo solo preparando il mondo ad accettare l’IA così com’è?