La Trappola dell’AI nel Marketing Digitale: Come Uscirne nel 2025

Siamo di fronte a un’AI Trap, una trappola in cui l’eccessiva automazione e la ricerca di metriche di efficienza stanno erodendo la fiducia degli utenti

Siamo alla fine del 2025 e il panorama del marketing digitale assomiglia sempre più a una codebase legacy non documentata: complessa, stratificata e piena di dipendenze che nessuno capisce fino in fondo. Se torniamo con la memoria al novembre 2022, al lancio di ChatGPT, l’entusiasmo era palpabile; sembrava che avessimo sbloccato una nuova primitiva computazionale capace di scalare la creatività all’infinito.

Tre anni dopo, i nodi stanno venendo al pettine.

Non si tratta di un rifiuto della tecnologia – nessun sviluppatore sano di mente tornerebbe a scrivere codice senza un copilot – ma di un errore fondamentale nell’implementazione dei sistemi di generazione dei contenuti.

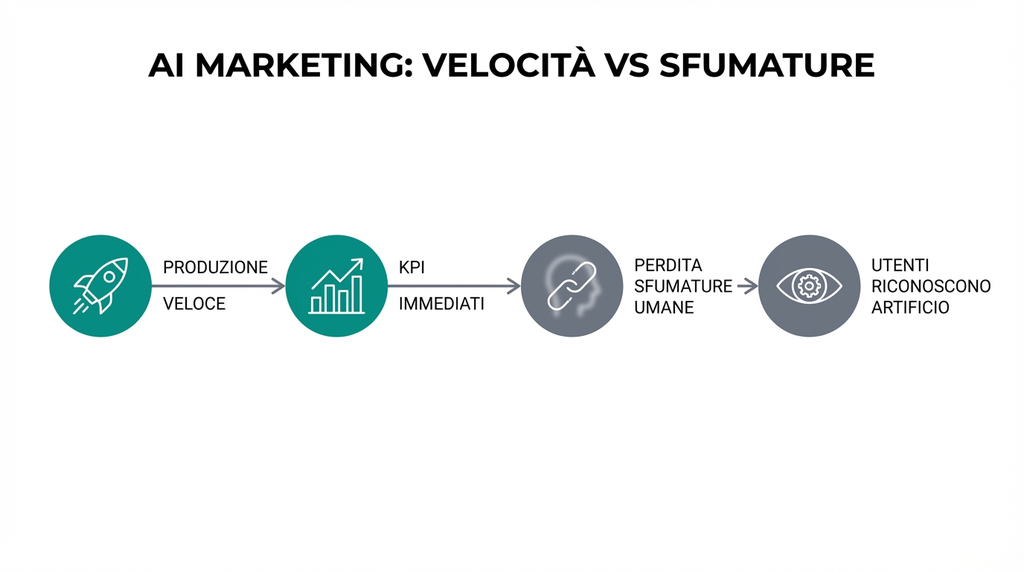

È quella che viene definita “AI Trap”, la trappola dell’intelligenza artificiale: un loop ricorsivo in cui le agenzie, inseguendo metriche di efficienza puramente quantitative, hanno saturato i canali di comunicazione con output sinteticamente perfetti ma semanticamente vuoti.

Il risultato non è solo la noia dell’utente, ma una vera e propria erosione della fiducia, un parametro che, a differenza dei click, non si può recuperare semplicemente aggiustando i pesi di un algoritmo.

L’ottimizzazione prematura è la radice di tutti i mali

Dal punto di vista ingegneristico, l’adozione dell’AI nel marketing ha seguito la classica curva dell’hype, ma con una deviazione preoccupante verso l’automazione totale senza supervisione (human-in-the-loop). I dati parlano chiaro e mostrano perché la tentazione è stata irresistibile: integrare strumenti generativi nei workflow permette di ridurre i tempi di produzione dei contenuti fino al 50%.

Per un manager, questo è un guadagno di efficienza indiscutibile.

Per un tecnico, è un campanello d’allarme.

Quando si ottimizza un sistema esclusivamente per la velocità di output, si introduce quasi sempre un debito tecnico. Nel contesto del marketing, questo debito è la perdita di “nuance”, quella sfumatura imperfetta ma umana che crea connessione. I Large Language Models (LLM) funzionano prevedendo il token successivo più probabile; tendono quindi, per design, alla mediocrità statistica.

Un’agenzia che delega interamente la creazione di copy a questi modelli sta, di fatto, standardizzando la propria comunicazione sulla media del web.

È ironico come, cercando di personalizzare l’esperienza su larga scala, abbiamo finito per rendere tutto terribilmente generico.

Il problema si aggrava quando guardiamo alle metriche di superficie. Se ci fermiamo ai KPI immediati, l’automazione sembra vincente. Tuttavia, come spesso accade nel debugging, l’errore non è nella riga di codice che stiamo guardando, ma nel modo in cui il sistema interagisce con l’ambiente esterno. L’ambiente, in questo caso, sono utenti sempre più sofisticati nel riconoscere pattern sintattici artificiali.

Il protocollo della fiducia interrotta

La situazione si complica ulteriormente se analizziamo come è cambiato il traffico web. Non stiamo più parlando solo di ottimizzare per i crawler di Google (SEO classica), ma di gestire i referral provenienti dai motori di risposta AI. Questi sistemi non restituiscono dieci link blu, ma sintetizzano risposte dirette. Essere citati da un’AI richiede una strategia tecnica completamente diversa, basata sull’autorità semantica e non sulle keyword density.

Qui emerge un gap tecnologico significativo. Molte aziende stanno navigando alla cieca perché gli strumenti di analytics tradizionali non sono stati aggiornati abbastanza velocemente per tracciare queste nuove fonti di traffico. È un problema di visibilità dei dati critico: attualmente il 50% delle piccole e medie imprese tenta di monitorare il traffico AI senza averne reale visibilità.

Stiamo ottimizzando sistemi complessi basandoci su log incompleti.

Questo scenario crea un paradosso. Da un lato, le agenzie pompano contenuti generati dall’AI per coprire ogni possibile query; dall’altro, non hanno la strumentazione telemetrica per capire se questi contenuti stanno realmente portando valore o se stanno solo gonfiando le metriche di vanità mentre il tasso di conversione reale (e la fiducia del brand) crolla.

È l’equivalente digitale di un attacco DDoS autoinflitto: inondiamo i canali di richieste (contenuti) fino a rendere il servizio (la comunicazione del brand) inaccessibile emotivamente all’utente.

Architettura di un sistema ibrido

La soluzione, tuttavia, non è il luddsimo digitale. Rifiutare l’AI nel 2025 sarebbe come rifiutare di usare un compilatore. La chiave sta nel capire a quale livello dello stack tecnologico applicare l’automazione. L’analisi dei dati suggerisce che l’AI brilla quando lavora nel backend – nell’analisi dei dati, nella segmentazione, nell’ottimizzazione dei tempi di invio – piuttosto che nel frontend della creazione pura.

I risultati migliori si ottengono quando l’intelligenza artificiale viene utilizzata per potenziare, non sostituire, l’intuizione umana.

Le agenzie che hanno integrato l’AI per analizzare i pattern comportamentali e ottimizzare il timing delle comunicazioni hanno registrato un miglioramento del 22% nel Click-Through Rate attraverso strategie di messaggistica guidate dall’AI. Questo è un uso elegante della tecnologia: usare la potenza di calcolo per capire quando e a chi parlare, lasciando però il cosa e il come alla sensibilità umana.

C’è una distinzione tecnica fondamentale tra “generare” e “ottimizzare”. L’AI generativa crea da zero (spesso allucinando o appiattendo), l’AI analitica raffina processi esistenti. Le agenzie che stanno uscendo dalla “trappola” sono quelle che usano l’AI per eliminare l’attrito (come ridurre i bounce rate delle email o pulire i database CRM) permettendo ai creativi umani di concentrarsi su ciò che le macchine non sanno ancora fare: l’empatia e la narrazione non lineare.

Siamo di fronte a un refactoring necessario dell’industria. L’open source ci ha insegnato che la trasparenza e la collaborazione portano a codice migliore e più sicuro. Allo stesso modo, un marketing che dichiara i suoi strumenti ma mantiene un core umano è l’unica via per ricostruire la fiducia.

La domanda che dobbiamo porci non è quanto velocemente possiamo generare una campagna, ma quanto resiliente è il legame che stiamo costruendo con l’utente finale.

Preferiamo un picco di traffico effimero o una connessione stabile e a bassa latenza?