Come l’intelligenza artificiale sta cannibalizzando il traffico web tradizionale

I dati mostrano che l’interazione uomo-macchina sta superando il tradizionale modello “cerca e clicca”, portando a una rivoluzione nell’architettura delle informazioni.

Per anni abbiamo trattato i chatbot e i Large Language Models (LLM) come giocattoli costosi o, nel migliore dei casi, come assistenti alla scrittura. Ma mentre l’industria discuteva di etica e allucinazioni, sotto il cofano del web stava avvenendo uno spostamento tettonico nelle dinamiche di routing del traffico.

Non stiamo più parlando di ipotesi: siamo alla fine del 2025 e i log dei server raccontano una storia completamente diversa rispetto a quella a cui la SEO tradizionale ci aveva abituati.

I dati non mentono, e quelli emersi dalle ultime analisi sulle conversioni mostrano che l’interazione uomo-macchina sta cannibalizzando il vecchio modello “cerca e clicca”.

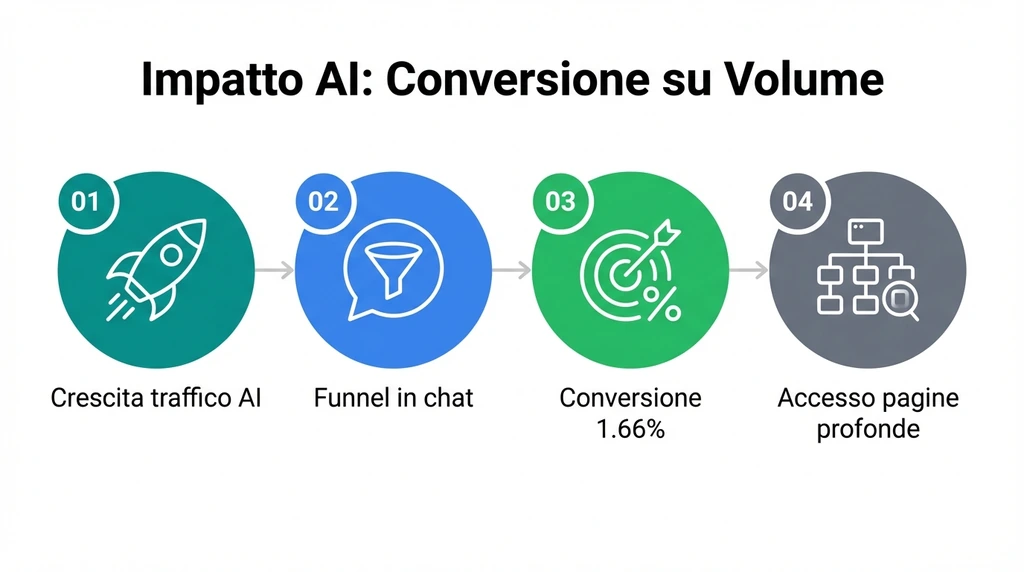

Il punto non è il volume, ma la densità dell’informazione e l’intento dell’utente. Per decenni, l’equazione è stata semplice: più traffico portavi alla home page o alle landing page, più possibilità avevi di convertire.

Era un gioco di numeri, spesso sporco, fatto di keyword stuffing e backlink di dubbia provenienza. Oggi, quel modello sta crollando sotto il peso della sua inefficienza.

Gli utenti che arrivano da ChatGPT, Claude o Perplexity non stanno “navigando”; stanno eseguendo un’operazione chirurgica. Sanno già cosa vogliono perché l’AI ha fatto il lavoro sporco di scrematura.

La metrica della verità: conversione contro volume

Se analizziamo i flussi di rete, notiamo un’anomalia statistica che farebbe impallidire qualsiasi analista dati della vecchia guardia. Non stiamo parlando di una crescita marginale.

Uno studio basato su otto mesi di dati di traffico attraverso 1.277 domini ha rivelato che il traffico proveniente dalle piattaforme AI è cresciuto del 155,6%, un tasso che surclassa qualsiasi altra sorgente organica. Ma il dato tecnicamente più rilevante non è la crescita, bensì l’efficacia: questo traffico converte all’1,66%, contro un misero 0,15% della ricerca tradizionale.

Stiamo parlando di un tasso di conversione di ordini di grandezza superiore. In termini ingegneristici, è come passare da un motore a combustione interna pieno di dispersioni termiche a un motore elettrico ad alta efficienza.

Il motivo è architetturale: il “funnel” di marketing tradizionale è stato cortocircuitato.

L’utente non passa più per la fase di “awareness” e “consideration” sul tuo sito; quelle fasi avvengono all’interno della finestra di chat dell’AI. Quando il link viene cliccato, l’utente è già alla fase di decisione. È un traffico pre-qualificato algoritmicamente, pulito dal rumore di fondo dei visitatori casuali.

Questo cambia radicalmente il modo in cui dobbiamo pensare all’architettura delle informazioni.

Se l’utente medio arriva direttamente su una pagina profonda del sito, ignorando la struttura gerarchica che abbiamo meticolosamente costruito per anni, la Homepage diventa un artefatto decorativo.

L’ingegneria dietro la tracciabilità

Fino a poco tempo fa, tutto questo traffico finiva nel calderone indistinto del “Direct” o, peggio, veniva erroneamente attribuito ad altri referral a causa di User Agent non standard o offuscati. La sfida tecnica è stata quella di isolare questi pacchetti di dati per capire chi o cosa stesse interrogando i nostri server.

La risposta dell’industria è arrivata con l’aggiornamento dei sistemi di analytics, che ora distinguono esplicitamente le sessioni guidate dai LLM.

Microsoft, in particolare, ha dovuto riscrivere parte della logica di attribuzione nel suo strumento Clarity. La soluzione tecnica ha comportato l’introduzione di gruppi di canali specifici per le piattaforme AI, permettendo finalmente di segmentare il traffico organico da quello a pagamento all’interno degli ecosistemi dei chatbot.

Questo non è un dettaglio da poco: significa che a livello di protocollo e di analisi dei log, stiamo iniziando a trattare un’interrogazione di ChatGPT con la stessa dignità tassonomica di una query su Google Search.

È interessante notare come l’implementazione tecnica di questi “Referrer” sia ancora un Far West. Mentre i browser standard inviano header HTTP prevedibili, i vari agenti AI hanno comportamenti erratici. Alcuni mascherano la provenienza, altri la dichiarano apertamente.

La mossa di standardizzare questi canali è il primo passo verso una normalizzazione del protocollo di scambio tra fornitori di contenuti e intelligenze artificiali.

Senza questa trasparenza tecnica, staremmo ottimizzando i nostri sistemi alla cieca.

Il declino del “search” e il futuro dell’infrastruttura

Bisogna essere critici verso chi minimizza questo cambiamento definendolo una bolla. Le proiezioni indicano un calo del 25% dei volumi di ricerca tradizionali entro il 2026.

Se gestite un’infrastruttura web, questo significa meno richieste HTTP totali, ma un carico computazionale per sessione potenzialmente più alto, dato che gli utenti arrivano per compiere azioni complesse e non per sfogliare passivamente pagine statiche.

Tuttavia, c’è un dato che deve far riflettere e che impedisce di gridare prematuramente alla rivoluzione totale. Nonostante l’efficienza mostruosa, i dati mostrano che il traffico AI rappresenta ancora meno dell’1% del totale dei visitatori unici.

Siamo in una fase embrionale, paragonabile ai primi giorni del mobile web. La massa critica non c’è ancora, ma la tendenza esponenziale suggerisce che chi ignora l’ottimizzazione per gli LLM oggi si troverà nella stessa posizione di chi ignorava il responsive design nel 2010.

La questione tecnica che rimane aperta, e che preoccupa chi sostiene l’open web, è l’opacità. Nel vecchio mondo SEO, avevamo regole (seppur vaghe) su H1, meta tag e backlink. Nel mondo dell’AI, l’algoritmo che decide di citare il tuo articolo come fonte è una scatola nera proprietaria.

Non esiste un “View Source” per capire perché un LLM ha preferito la tua documentazione tecnica a quella del concorrente.

Stiamo costruendo la nostra visibilità futura su fondamenta che non possiamo ispezionare, fidandoci ciecamente della “benevolenza” tecnica di pochi attori giganti.

Siamo pronti ad accettare un web dove il traffico è minore ma migliore, al prezzo di cedere il controllo dell’indicizzazione a modelli probabilistici che nessuno, nemmeno i loro creatori, comprende fino in fondo?