L’intelligenza Artificiale Locale: La Fine dei Data Center?

L’intelligenza artificiale si sposta dal cloud ai dispositivi, una rivoluzione che mette in discussione i mega-investimenti nei data center

Per anni ci hanno ripetuto un mantra apparentemente inattaccabile: l’intelligenza artificiale è una bestia insaziabile che vive solo nel cloud, nutrita da enormi cluster di GPU e raffreddata a liquido in cattedrali di cemento chiamate data center.

Abbiamo accettato l’idea che per chiedere a un chatbot la ricetta della carbonara fosse necessario attivare una catena di elaborazione energivora a migliaia di chilometri di distanza.

Eppure, proprio mentre l’industria iniziava a dare per scontata questa centralizzazione monolitica, il 2026 si è aperto con una provocazione tecnica che rischia di far saltare il banco.

Aravind Srinivas, CEO di Perplexity, ha lanciato quella che nel nostro ambiente suona come un’eresia o una profezia, a seconda di chi detiene il budget infrastrutturale: spostare l’intelligenza dal server al dispositivo, rendendo di fatto obsoleti i mega-investimenti degli ultimi tre anni.

Non stiamo parlando della solita retorica sulla privacy, sebbene sia un fattore rilevante, ma di un cambio di paradigma architetturale dettato da limiti fisici ed economici. L’inferenza locale — ovvero l’esecuzione del modello direttamente sul chip del vostro smartphone o laptop — non è più un giocattolo per smanettoni che compilano Llama nel terminale, ma sta diventando l’unica valvola di sfogo possibile per un sistema al collasso energetico.

Se l’elaborazione avviene “on-edge”, sul bordo della rete, il costo computazionale sparisce dal bilancio del fornitore di servizi e, cosa ancora più critica, si riduce la latenza di rete a zero.

È un’eleganza tecnica che noi sviluppatori apprezziamo: perché muovere terabyte di dati quando puoi muovere l’algoritmo?

Tuttavia, liquidare la questione come una semplice ottimizzazione software sarebbe ingenuo. Dietro le dichiarazioni di Srinivas si nasconde una tensione palpabile tra chi ha scommesso miliardi sulle infrastrutture centralizzate e chi, invece, vede nel silicio consumer la vera frontiera. La tesi è forte:

Nel momento in cui l’intelligenza può essere pacchettizzata localmente su un chip in esecuzione sul dispositivo, i data center perdono la loro importanza.

— Aravind Srinivas, CEO di Perplexity AI

Questa affermazione, se portata alle sue logiche conseguenze, suggerisce che i modelli di intelligenza artificiale eseguiti direttamente sui dispositivi utente minaccino gli investimenti da trilioni di dollari che le Big Tech hanno riversato nel calcestruzzo e nel rame.

Ma per capire se siamo di fronte a una rivoluzione o a un bluff, bisogna guardare cosa sta succedendo nelle reti elettriche.

La fisica non perdona: il collo di bottiglia energetico

Per comprendere perché l’AI locale stia diventando una necessità più che un lusso, dobbiamo guardare al “backend” del mondo reale: la rete elettrica.

Chi lavora con cluster Kubernetes su larga scala sa che l’orchestrazione è complessa, ma l’orchestrazione dell’elettricità lo è ancora di più. Fino al 2025, il problema principale sembrava essere la quantità totale di energia richiesta; oggi, nel 2026, abbiamo scoperto che il problema è la dinamica di quell’energia.

I moderni carichi di lavoro di training e inferenza non sono costanti: causano picchi di assorbimento violenti e sincronizzati. Quando decine di migliaia di GPU in un singolo cluster passano dallo stato di idle al pieno carico computazionale in pochi microsecondi, creano oscillazioni di potenza nell’ordine dei megawatt.

Queste oscillazioni sono l’incubo degli operatori di rete. Non si tratta solo di “consumare molto”, ma di consumare in modo imprevedibile, rischiando di destabilizzare le frequenze di rete locali.

È qui che la visione decentralizzata acquista un peso specifico enorme: distribuire il carico su milioni di dispositivi a batteria (che agiscono come buffer naturali) è tecnicamente molto più sano che concentrarlo in un unico punto critico.

Le stime attuali sono allarmanti: l’Agenzia Internazionale dell’Energia prevede che il consumo globale dei data center potrebbe raggiungere i 1.050 terawattora entro quest’anno, una cifra che mette a nudo l’insostenibilità dell’attuale modello “cloud-first” per l’AI generativa di massa.

Spostare l’inferenza sul dispositivo dell’utente, quindi, non è solo una questione di velocità o privacy. È un tentativo disperato di evitare che le utility impongano restrizioni draconiane ai nuovi data center.

Le aziende stanno realizzando che il costo marginale per query nel cloud non scende abbastanza velocemente rispetto alla domanda; l’unica soluzione per scalare senza far esplodere la rete elettrica (e i margini di profitto) è scaricare il calcolo sull’hardware che l’utente ha già comprato.

Ma c’è un ostacolo tecnico che rende questa transizione tutt’altro che indolore.

La guerra della memoria e il costo dell’indipendenza

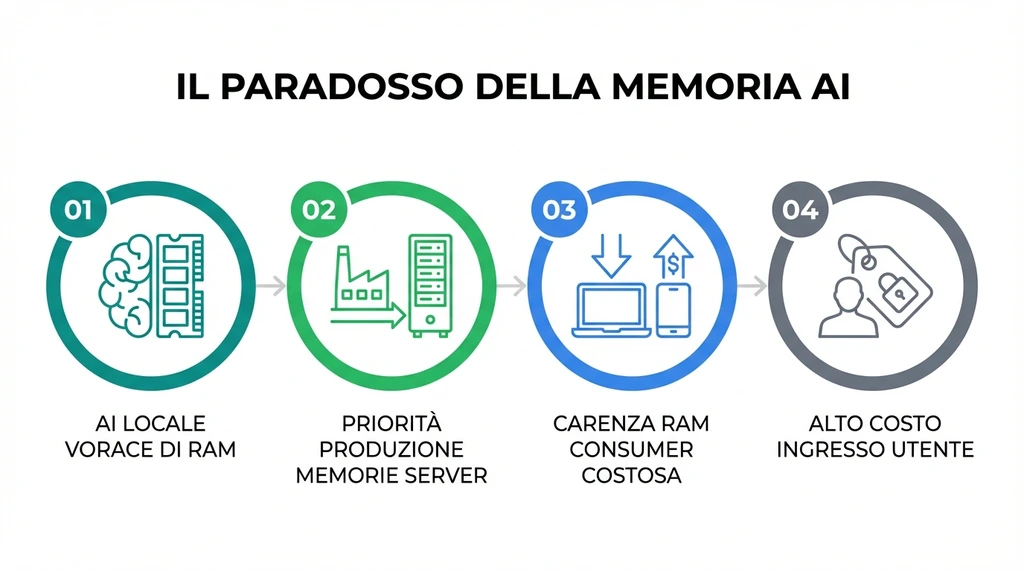

Se l’architettura decentralizzata è così superiore, perché non l’abbiamo adottata subito? La risposta risiede in tre lettere: RAM.

I Large Language Models (LLM), anche nelle loro versioni quantizzate e ottimizzate per l’esecuzione locale, sono voraci di memoria. Non basta avere una NPU (Neural Processing Unit) potente; serve una larghezza di banda di memoria capace di nutrire quella NPU con miliardi di parametri al secondo. Qui entra in gioco una dinamica di mercato che sta stritolando il settore consumer.

Per alimentare i mostri nei data center, i produttori di semiconduttori hanno dirottato le linee produttive verso le memorie HBM (High Bandwidth Memory), essenziali per le GPU server tipo NVIDIA H100 e successori. Questo ha creato un effetto domino devastante: c’è meno capacità produttiva per le memorie DDR5 e LPDDR che finiscono nei nostri laptop e smartphone.

IDC ha recentemente evidenziato una carenza globale di memoria causata dalla riallocazione della produzione verso i server AI, creando un paradosso crudele: proprio mentre abbiamo bisogno di dispositivi consumer con 32GB o 64GB di RAM per far girare l’AI locale, il costo della memoria schizza alle stelle a causa dei data center che vorremmo sostituire.

L’hardware, quindi, diventa il vero campo di battaglia. I nuovi “AI PC” e gli smartphone di fascia alta stanno integrando NPU sempre più sofisticate, ma senza un adeguato sottosistema di memoria, questi chip rimangono motori Ferrari con il serbatoio di una Panda.

La democratizzazione dell’AI, ironicamente, passa per un aumento del costo d’ingresso per l’utente finale.

Non è più sufficiente un terminale stupido collegato al cloud; serve una workstation in miniatura.

Illusione di libertà o necessità architetturale?

C’è un aspetto che spesso sfugge nelle analisi puramente economiche: la qualità dell’esperienza tecnica. Srinivas ha ragione quando dice che un’AI locale è “il tuo cervello”, un’estensione che impara da te senza inviare telemetria costante alla nave madre.

L’AI locale sarebbe più veloce perché l’elaborazione avviene sul dispositivo stesso. Sarebbe anche più privata, perché i tuoi dati personali non lascerebbero il tuo telefono o laptop per essere archiviati nel cloud.

— Aravind Srinivas, CEO di Perplexity AI

Dal punto di vista dello sviluppo software, questo apre scenari affascinanti ma complessi. Significa dover gestire la frammentazione hardware (il modello girerà uguale su un chip M4 e su uno Snapdragon?), occuparsi dell’aggiornamento dei pesi dei modelli in background e garantire che la batteria non venga prosciugata in due ore.

Ma la promessa è quella di un sistema resiliente, che funziona offline, che non soffre di downtime se un cavo in fibra viene tranciato nell’Atlantico.

Tuttavia, bisogna essere critici verso chi spinge questa narrazione. Le Big Tech non stanno abbracciando l’AI on-device per bontà d’animo o per un improvviso amore verso l’open source e la privacy.

Lo fanno perché il modello centralizzato ha raggiunto un punto di rendimenti decrescenti. Costruire nuovi data center costa troppo, consuma troppo e richiede tempi biblici per le approvazioni energetiche. Spostare il calcolo sull’utente è, brutalmente, un modo per esternalizzare i costi operativi sul consumatore finale.

Siamo di fronte a un bivio affascinante. Da una parte, l’AI locale rappresenta il ritorno a un computing più personale, controllabile e tecnicamente distribuito, in linea con i principi originali di un internet decentralizzato.

Dall’altra, rischia di creare un divario digitale ancora più profondo, dove l’accesso all’intelligenza artificiale di alta qualità dipende non dalla connessione internet, ma dalla possibilità di permettersi hardware costoso e introvabile.

La vera domanda per il 2026 non è se i data center diventeranno inutili — rimarranno essenziali per il training dei modelli più grandi — ma se siamo disposti ad accettare che il “cervello” digitale nei nostri taschini diventi il nuovo standard, con tutti i costi e le responsabilità di manutenzione che ne conseguono.

È una libertà tecnica che ha un prezzo: siamo pronti a pagarlo o preferiamo continuare a noleggiare l’intelligenza a consumo?