Perplexity AI cambia le regole: Carta di credito obbligatoria per gli utenti Airtel

La decisione di Perplexity AI di richiedere una carta di credito agli utenti indiani, precedentemente beneficiari di un accesso gratuito tramite Airtel, solleva interrogativi sulla stabilità delle promesse nel mondo dell’intelligenza artificiale e sui costi reali della “gratuità”.

C’è una vecchia massima nel mondo dello sviluppo software che recita: «Mai cambiare le API pubbliche senza preavviso». È una regola di cortesia tecnica, ma soprattutto di stabilità: se costruisci un sistema basato su una promessa, infrangerla rompe la fiducia.

Oggi, 22 dicembre 2025, sembra che Perplexity AI abbia deciso di ignorare questo principio fondamentale, inviando una notifica che ha il sapore amaro di un “breaking change” in produzione.

Migliaia di utenti indiani, che da luglio godevano di un accesso privilegiato ai modelli di intelligenza artificiale più avanzati grazie a una partnership con il gigante delle telecomunicazioni Airtel, si sono svegliati con una richiesta perentoria: inserire una carta di credito per continuare a usare il servizio.

Fino a ieri, la promessa era quella di un accesso “senza attrito”; oggi, quella promessa è stata riscritta unilateralmente.

Non stiamo parlando di un aggiornamento minore ai termini di servizio. La notifica che impone l’inserimento di un metodo di pagamento valido trasforma radicalmente la natura dell’offerta. Quello che era stato venduto come un benefit aziendale puro – un “perk” per gli abbonati Airtel – si è rivelato essere un classico funnel di acquisizione utenti, con tanto di rinnovo automatico nascosto dietro l’angolo.

Per capire perché questa mossa è tecnicamente e strategicamente rilevante, dobbiamo guardare sotto il cofano di cosa significa, nel 2025, offrire “AI gratuita”.

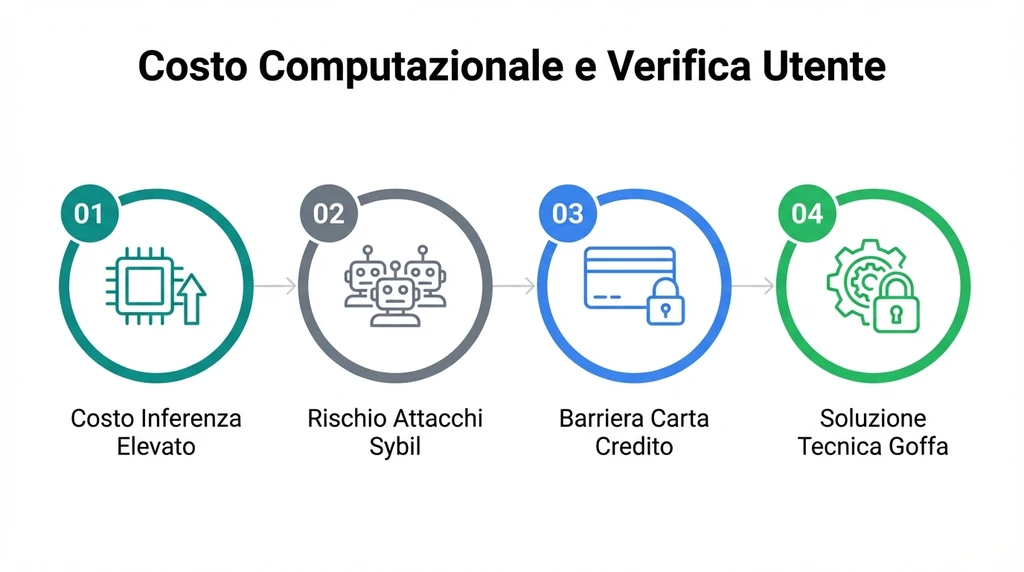

Il costo computazionale della gratuità

Dal punto di vista ingegneristico, Perplexity Pro non è un motore di ricerca standard. Una query su Google è relativamente economica in termini di risorse; una query su Perplexity Pro innesca una catena complessa di ragionamenti (CoT – Chain of Thought), scansione del web in tempo reale e sintesi tramite modelli pesanti come GPT-5, Claude 3.5 o Gemini. Il costo di inferenza – ovvero l’energia e l’hardware necessari per generare ogni singola risposta – è ordini di grandezza superiore a quello di una ricerca tradizionale.

Quando a luglio è stata lanciata la partnership, aprendo le porte a una platea potenziale di circa 360 milioni di clienti, gli ingegneri di sistema devono aver avuto un brivido freddo lungo la schiena.

Offrire accesso illimitato a risorse GPU H100 (o equivalenti di nuova generazione) senza una barriera all’ingresso è l’equivalente digitale di lasciare le chiavi della Ferrari nel cruscotto in un parcheggio affollato.

La richiesta della carta di credito, dunque, assolve a due funzioni tecniche. La prima è ovvia: preparare il terreno per la fatturazione post-trial. La seconda, più sottile, è la “resistenza Sybil”.

Nel gergo della sicurezza informatica, un attacco Sybil avviene quando un’entità crea innumerevoli identità false per abusare di un sistema. Senza la verifica di un metodo di pagamento, nulla impediva a bot o attori malevoli di sfruttare le API di Perplexity tramite account Airtel fittizi, drenando risorse di calcolo costosissime per scopi non previsti.

Tuttavia, la soluzione tecnica scelta è goffa. Invece di implementare un sistema di verifica dell’identità meno invasivo (come un KYC semplificato o un link più stretto con l’ID univoco dell’utente Airtel), Perplexity ha optato per il metodo che massimizza la frizione per l’utente ma ottimizza i ricavi futuri per l’azienda.

Un bug nella fiducia dell’utente

Se analizziamo l’accaduto come se fosse un log di sistema, l’errore non è nel requisito in sé, ma nel timing e nella comunicazione. Gli utenti hanno attivato il servizio a luglio con un contratto implicito: “usa il servizio, offre Airtel”. A dicembre, il sistema va in crash con un nuovo requisito: “dacci la carta o ti stacchiamo la spina”.

Perplexity giustifica la mossa come una misura di protezione.

Questa modifica è necessaria per proteggere il programma per gli utenti legittimi e garantire la sostenibilità del servizio.

— Supporto Perplexity AI

La frase “proteggere il programma” è un eufemismo aziendale per dire “abbiamo sottostimato l’abuso o i costi”. È comprensibile che un’azienda debba tutelarsi, ma imporre questo requisito retroattivamente è una pratica di design ostile.

È come se un gestore di pacchetti open source decidesse improvvisamente che la libreria che usi gratuitamente da sei mesi ora richiede una licenza a pagamento per continuare a funzionare, bloccando la tua build di produzione.

Il rischio maggiore qui è l’inerzia. Molti utenti inseriranno i dati della carta per non perdere l’accesso al servizio (che ha un valore nominale di circa 17.000 rupie, o 200 dollari l’anno), dimenticandosi poi di disattivare il rinnovo. È un dark pattern ben noto nell’industria SaaS (Software as a Service): si conta sulla distrazione dell’utente per convertire una prova gratuita in un abbonamento ricorrente.

Il dettaglio tecnico critico è che, secondo le nuove condizioni aggiornate nel centro assistenza ufficiale, il rinnovo automatico scatterà immediatamente al termine dei 12 mesi se non cancellato manualmente.

Non c’è un opt-in alla fine del periodo, ma un opt-out necessario ora.

La battaglia per l’ecosistema AI

C’è un livello più profondo di lettura. Siamo alla fine del 2025 e la guerra per il dominio dell’interfaccia AI si è spostata dai modelli (che stanno diventando commodity) agli aggregatori. Perplexity non vuole solo che usiate la loro AI; vuole diventare il vostro browser, il vostro motore di ricerca, il vostro assistente.

La partnership con Airtel era una mossa brillante per l’acquisizione di massa in un mercato chiave come l’India. Tuttavia, la conversione da “utente gratuito” a “utente pagante” è il collo di bottiglia di tutto il settore AI. I costi infrastrutturali sono ancora troppo alti per sostenere un modello puramente pubblicitario o gratuito a lungo termine.

L’eleganza tecnica di Perplexity risiede nella sua capacità di orchestrare diversi LLM (Large Language Models) per fornire risposte precise. Ma l’eleganza del codice non serve a nulla se il modello di business forza la mano agli utenti. Richiedere la carta di credito a metà percorso suggerisce che i tassi di conversione organica non erano quelli sperati, o che il costo per utente (ARPU vs Cost to Serve) stava diventando insostenibile.

Questo episodio segna un punto di svolta. Fino a poco tempo fa, le aziende di AI erano in fase di “growth hacking” sfrenato, disposte a bruciare capitale per acquisire utenti. Ora, la realtà dei bilanci e dei costi GPU sta presentando il conto.

La mossa di Perplexity è un segnale che l’era dell’AI “gratis e senza compromessi” sta finendo.

La domanda che rimane sospesa non è se il servizio valga il prezzo – tecnicamente, Perplexity Pro è uno strumento formidabile – ma se sia etico cambiare le regole del gioco a partita in corso.

In un ecosistema digitale che si basa sempre più sulla fiducia algoritmica, possiamo permetterci che le aziende trattino i contratti con gli utenti come variabili modificabili a piacimento nel loro codice sorgente?