Il 2026 Sarà l’Anno della Compilazione: Governance, Agenti Ia e Concentrazione di Capitali

Il 2026 sarà l’anno degli Agenti AI, sistemi progettati per agire autonomamente, ma la governance e la sicurezza diventano prioritarie

Siamo arrivati alla fine del 2025 e, se guardiamo indietro al codice che scrivevamo solo tre anni fa, sembra di osservare reperti archeologici. L’euforia disordinata del “basta che funzioni” ha lasciato il posto a un pragmatismo quasi cinico.

Non siamo più nella fase in cui uno script Python di cinquanta righe collegato alle API di OpenAI garantisce un round di finanziamento da dieci milioni di dollari. Quell’epoca è finita, ed è una buona notizia per chi scrive software seriamente.

Il 2026 si preannuncia come l’anno della “compilazione”: dopo aver scritto bozze disordinate di futuro, il mercato e la tecnologia stanno cercando di trasformare il tutto in un eseguibile stabile.

Tuttavia, mentre i commit su GitHub diventano più puliti, il contesto macroeconomico e regolatorio assomiglia sempre più a un debito tecnico che nessuno vuole ripagare. La selezione naturale non riguarda più solo chi ha il modello più intelligente, ma chi ha l’infrastruttura legale e finanziaria per sopravvivere.

Il collo di bottiglia non è più la GPU, è la governance

Per anni, noi sviluppatori ci siamo lamentati della latenza e della scarsità di chip H100. Oggi, **il vero problema architetturale è il “layer” normativo**.

La situazione negli Stati Uniti, che rimane il baricentro dello sviluppo tecnologico, è paradossale. Abbiamo assistito a un tentativo goffo di centralizzazione tramite ordini esecutivi federali che cercano di sovrascrivere le leggi statali, creando quello che in gergo chiameremmo un race condition: due processi (stato e governo federale) che competono per la stessa risorsa senza un meccanismo di blocco efficace.

Questo caos non è solo una questione per avvocati, ma impatta direttamente la pipeline di CI/CD.

Come si fa a rilasciare un prodotto che deve rispettare la privacy biometrica dell’Illinois, le norme sulla trasparenza algoritmica della California e un ordine federale che potrebbe essere invalidato dalla Corte Suprema il mese prossimo?

Danny Tobey, responsabile delle pratiche AI presso DLA Piper, ha sintetizzato perfettamente questo stallo, sottolineando come le imprese affrontino un’incertezza senza precedenti dovuta a un mosaico confuso di politiche sull’IA. La conseguenza tecnica è che le aziende stanno iniziando a costruire “sandboxes” isolati, limitando le funzionalità dei loro agenti AI per evitare rischi di conformità.

Si sta riducendo di fatto l’innovazione a una serie di istruzioni if-else legali.

Le aziende affrontano ancora più incertezza a causa del confuso mosaico di politiche sull’IA, dell’ordine esecutivo federale che probabilmente affronterà sfide legali e della mancanza di chiarezza sul controllo federale rispetto a quello statale.

— Danny Tobey, Chair of AI and Data Analytics Practice presso DLA Piper

Questo clima di incertezza, tuttavia, non ha fermato il flusso di denaro. Lo ha solo reindirizzato verso chi può permettersi eserciti di compliance officer.

La concentrazione del capitale e la fine delle “wrapper apps”

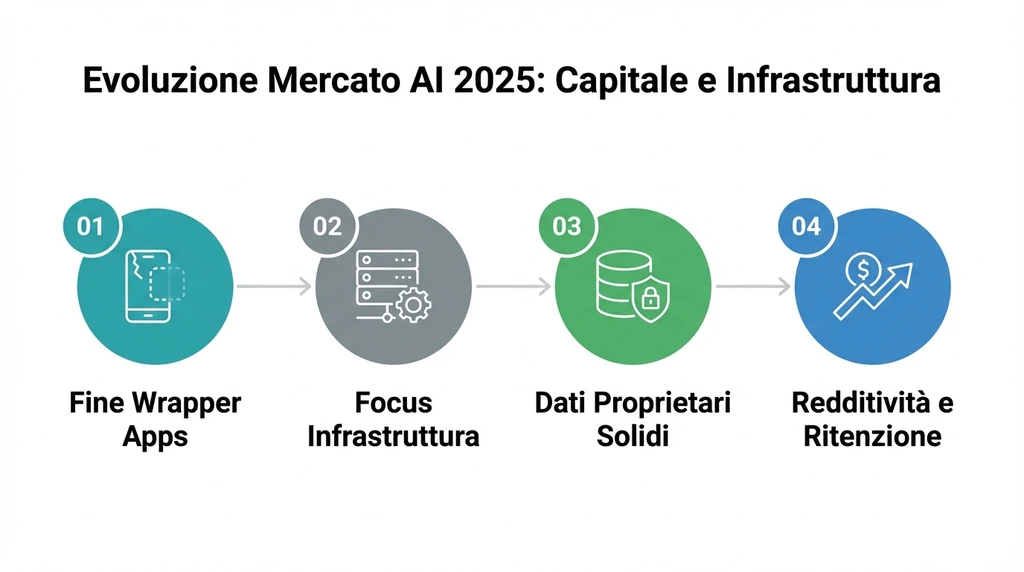

Se guardiamo i dati di questo ultimo trimestre del 2025, notiamo un fenomeno che tecnicamente definirei “garbage collection” del mercato. Nel 2021 e 2022, gli investitori adottavano un approccio spray and pray: finanziavano chiunque avesse una .ai nel dominio. Oggi, l’allocazione delle risorse segue una logica molto più deterministica.

I venture capitalist non cercano più la “feature” carina, cercano l’infrastruttura.

La prova di questa maturazione è nei numeri. Nonostante il volume totale degli investimenti rimanga alto, la distribuzione è estremamente sbilanciata. Le startup che si limitano a fare da “wrapper” (interfacce grafiche leggere sopra modelli fondativi altrui) stanno morendo di inedia, mentre i capitali si concentrano su chi possiede dati proprietari o infrastrutture verticali.

È interessante notare come gli Stati Uniti detengano ormai l’85% dei finanziamenti globali per l’IA, segnalando non solo una concentrazione geografica, ma una vera e propria egemonia tecnica che rende difficile per l’Europa competere sui modelli generalisti.

Per uno sviluppatore, questo significa che il tempo delle “demo app” spacciate per prodotti è finito.

Gli investitori ora chiedono di vedere metriche di retention e percorsi verso la redditività che richiedono un’ingegneria del software solida, non prototipi messi insieme con il nastro adesivo. La valutazione media delle startup AI seed-stage è ancora alta rispetto al software tradizionale, ma il tasso di mortalità tra il seed e la Serie A è brutale. Sopravvive solo chi ha risolto problemi di latenza, allucinazioni e integrazione profonda nei workflow aziendali.

E qui arriviamo al vero salto tecnologico che ci aspetta nel 2026.

Dagli LLM passivi all’era degli Agenti

Fino a ieri, l’interazione standard con l’IA era la chat: tu chiedi, la macchina risponde. È un paradigma limitato, sincrono e, onestamente, tecnicamente noioso dopo un po’. Il 2026 sarà l’anno degli Agentic AI, ovvero **sistemi progettati non per conversare, ma per agire**.

Non stiamo parlando di semplici script di automazione. Parliamo di architetture complesse in cui un modello di linguaggio funge da “orchestratore”, pianificando sequenze di azioni, richiamando strumenti esterni (API, database, browser) e verificando il risultato del proprio lavoro.

È la differenza tra chiedere a un junior “come si fa il deploy” e dirgli “fai il deploy”.

Dal punto di vista dell’implementazione, questo sposta il focus dalla generazione di testo alla capacità di retrieval (recupero informazioni) e reasoning (ragionamento logico). Le aziende che stanno vincendo sono quelle che hanno costruito strati intermedi robusti per gestire la memoria a lungo termine degli agenti e la sicurezza delle loro azioni.

Non è un caso che si preveda che almeno 50 aziende AI-native raggiungeranno i 250 milioni di dollari di ARR entro la fine del 2026, dimostrando che il mercato è pronto a pagare profumatamente per software che “fa” cose, invece di limitarsi a descriverle.

Tuttavia, c’è un rovescio della medaglia tecnico. Gli agenti autonomi amplificano i rischi. Se un chatbot dice una sciocchezza, è un problema di PR. Se un agente autonomo cancella per errore un database di produzione o invia email errate a mille clienti, è un disastro operativo.

La superficie di attacco aumenta esponenzialmente.

Mel Walker di CohnReznick ha avvertito che una regolamentazione troppo pesante potrebbe soffocare questa innovazione, ma la realtà è che senza standard di sicurezza rigorosi, nessuna azienda Enterprise darà le chiavi dei propri sistemi a un agente AI.

I regolamenti non devono essere troppo onerosi o soffocheranno l’innovazione.

— Mel Walker, Data and AI Practice Leader presso CohnReznick

Ci stiamo muovendo verso un 2026 in cui l’Intelligenza Artificiale diventerà paradossalmente meno visibile ma più pervasiva. Meno chat scintillanti, più processi in background che girano silenziosamente sui server.

La magia sta svanendo per lasciare posto all’ingegneria, quella vera, fatta di log, di gestione degli errori e di ridondanza.

Resta da chiedersi: siamo pronti ad accettare che la maggior parte delle decisioni operative critiche venga presa da scatole nere di cui, nel profondo, non comprendiamo ancora del tutto il funzionamento statistico?