L’Intelligenza Artificiale Rivoluziona il Content Management: Da Cimiteri Digitali a Piattaforme Dinamiche

Dall’automazione della scrittura all’integrazione diretta con CMS, una startup irlandese rivoluziona la creazione e manutenzione dei contenuti web

Siamo onesti: la maggior parte dei sistemi di gestione dei contenuti (CMS) che utilizziamo oggi sono cimiteri digitali.

Carichiamo articoli, postiamo aggiornamenti e poi li lasciamo lì a decomporsi, mentre gli algoritmi di ricerca, sempre più affamati di freschezza, li spingono inesorabilmente verso l’oblio della pagina 2 di Google. È un problema architetturale prima che editoriale: il web è dinamico, ma i nostri database sono statici.

In questo scenario di inefficienza strutturale, l’attenzione si sta spostando dai semplici generatori di testo (come ChatGPT o Claude) a piattaforme di orchestrazione complete. Un esempio pragmatico arriva da Armagh, in Irlanda del Nord, dove Lyxity ha rilasciato una piattaforma capace di ridurre i tempi di creazione da 100 ore a 45 minuti, promettendo di automatizzare non solo la scrittura, ma l’intero ciclo di vita del contenuto.

Ma non lasciamoci abbagliare dai numeri del marketing senza guardare sotto il cofano.

La vera notizia qui non è che un’AI scriva velocemente—quello è ormai una commodity dal 2022—ma come questi nuovi strumenti stiano tentando di risolvere il problema dell’integrazione tecnica. Fino a ieri, il workflow tipico di uno sviluppatore o di un content manager era frammentato: prompt su una finestra, copia-incolla su un documento, editing manuale, e infine il deploy sul CMS. Un processo pieno di attrito e colli di bottiglia umani.

La soluzione tecnica che sta emergendo, e di cui Lyxity si fa portavoce, è l’eliminazione del “middleman” attraverso l’integrazione diretta via API con piattaforme come WordPress, Drupal o Wix. Non stiamo più parlando di un chatbot che ti dà un testo, ma di una pipeline che inietta direttamente metadati, formattazione HTML e ottimizzazione SEO nel database del sito.

Oltre la generazione: il recupero del “legacy”

Dal punto di vista ingegneristico, la funzionalità più interessante non è la creazione ex novo, ma il refactoring dei contenuti esistenti.

Chi gestisce siti ad alto traffico sa che il “content decay” (il decadimento del contenuto) è un problema tecnico misurabile: i vecchi URL perdono rilevanza semantica per i crawler di Google se non vengono aggiornati. Tuttavia, aggiornare manualmente migliaia di pagine è un compito sisifeo che nessuna azienda vuole pagare.

L’approccio “Intelligent Content” sposta il focus sulla manutenzione predittiva del sito. Invece di abbandonare i vecchi post, il sistema analizza il database esistente, identifica le pagine che hanno perso traction e propone un refresh mirato.

Questo è un cambio di paradigma: trattare il contenuto non come un artefatto statico, ma come codice che necessita di patch e aggiornamenti costanti per rimanere sicuro e performante. I dati preliminari suggeriscono un impatto concreto, con funzionalità che spaziano dalla creazione istantanea all’ottimizzazione di contenuti preesistenti per recuperare quel valore SEO che altrimenti andrebbe perso.

Il vantaggio tecnico è evidente: rivitalizzare un URL che ha già “authority” agli occhi del motore di ricerca è computazionalmente ed economicamente più efficiente che tentare di posizionarne uno nuovo da zero. È l’equivalente SEO del refactoring del codice legacy invece della riscrittura completa dell’applicazione.

L’architettura del flusso e il ruolo dell’umano

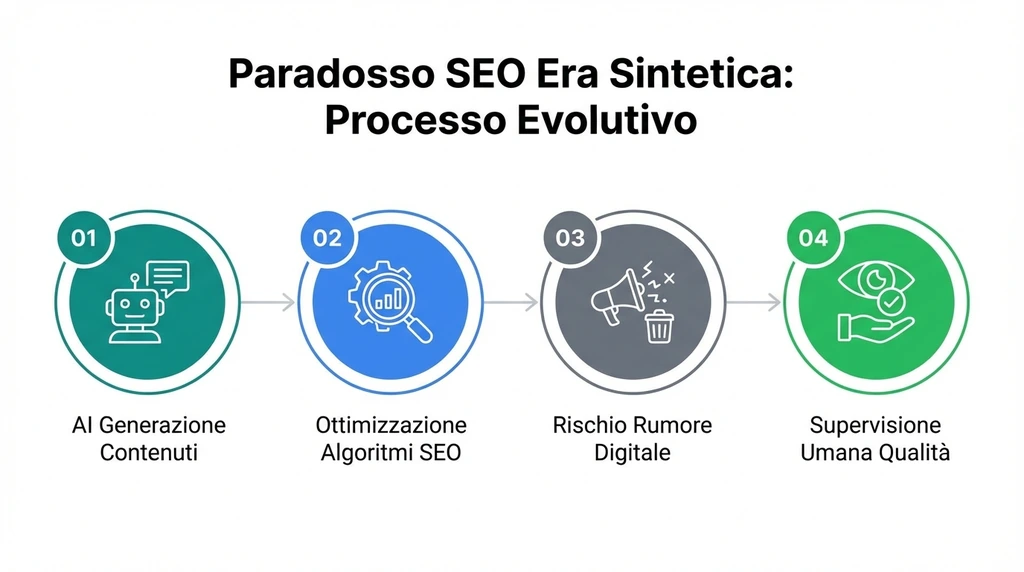

Tuttavia, l’automazione spinta porta con sé rischi tecnici non indifferenti.

Se la pipeline non è sorvegliata, il rischio è di inondare il proprio CMS di “slop”—contenuto spazzatura tecnicamente corretto ma privo di valore reale. Qui entra in gioco la necessità di un’architettura “Human-in-the-Loop” (HITL).

Nonostante le stime interne dell’azienda parlino di un incremento della produzione di contenuti fino a 10 volte per le agenzie, la velocità non deve diventare un vettore di mediocrità.

L’implementazione corretta di questi sistemi prevede che l’AI gestisca la struttura, l’analisi delle keyword e la stesura grezza, ma che il commit finale—il tasto “Pubblica”—rimanga sotto il controllo di un operatore umano. Questo non è solo per garantire la qualità stilistica, ma per conformarsi ai segnali di ranking di Google (come l’Helpful Content Update) che penalizzano i contenuti palesemente sintetici e privi di esperienza diretta.

La sfida per gli sviluppatori che integrano questi strumenti sarà calibrare il livello di automazione. Troppa, e il sito diventa una fattoria di link spam; troppo poca, e si perde il vantaggio competitivo.

La piattaforma ideale deve agire come un linter per il codice: suggerire correzioni, ottimizzare la sintassi (in questo caso la SEO), ma lasciare la logica finale allo sviluppatore (l’autore).

Il paradosso della SEO nell’era sintetica

C’è un’eleganza perversa nel modo in cui stiamo usando l’AI per ottimizzare contenuti per altre AI.

Da un lato abbiamo i LLM che generano testo, dall’altro gli algoritmi di Google che cercano di classificarlo. Strumenti come Lyxity si posizionano esattamente nel mezzo di questa battaglia, fornendo le armi per scalare le SERP (Search Engine Results Pages) in un ecosistema sempre più saturato.

La provenienza di questa innovazione è un altro dato interessante. Mentre la Silicon Valley si concentra sulla costruzione di modelli sempre più grandi e costosi (i cosiddetti Foundation Models), hub tecnologici periferici come quello nordirlandese stanno lavorando sul livello applicativo, risolvendo problemi di business reali. È la dimostrazione che non serve avere i server di OpenAI per innovare; basta saper usare le loro API meglio degli altri per risolvere un collo di bottiglia specifico.

Ma questo ci porta a una riflessione necessaria sulla sostenibilità del web.

Se abbattiamo il costo della creazione di contenuti a zero e riduciamo il tempo da 100 ore a 45 minuti, stiamo davvero creando valore o stiamo solo aumentando il rumore di fondo? La tecnologia è neutrale, l’implementazione no.

Se questi strumenti verranno usati per creare l’ennesimo articolo generico “SEO-oriented”, il web diventerà inusabile. Se invece verranno sfruttati per liberare gli esseri umani dai compiti ripetitivi, permettendo loro di concentrarsi su analisi originali e creatività, allora potremmo essere di fronte a un’evoluzione positiva.

La differenza tra un sito web performante e una discarica digitale, nel 2026, non la farà l’algoritmo che si usa, ma la qualità della supervisione umana che decidiamo di mantenere nel loop.