Nvidia e Groq: la mossa da 20 miliardi che riscrive le regole dell’intelligenza artificiale

Nvidia riscrive le regole dell’IA con un accordo da 20 miliardi di dollari che aggira l’antitrust e punta all’inferenza ultra-rapida

Se credevate che il pranzo di Natale fosse stato pesante, aspettate di vedere come l’industria tecnologica sta cercando di digerire la notizia arrivata, quasi a tradimento, tra un panettone e l’altro.

Quello che è successo ieri non è una semplice acquisizione, né una classica partnership. È un gioco di prestigio da 20 miliardi di dollari che ridefinisce le regole del gioco dell’Intelligenza Artificiale. Nvidia, il gigante indiscusso dei chip AI, ha deciso di mettere le mani sulla tecnologia di Groq, la startup che prometteva di detronizzarla.

Ma non l’ha comprata.

O meglio, non ufficialmente.

Immaginate di voler comprare la casa dei vostri sogni, ma l’antitrust del quartiere vi vieta di possedere altri immobili.

Cosa fate?

Affittate l’arredamento a tempo indeterminato e assumete l’architetto che l’ha progettata perché lavori solo per voi. È esattamente quello che ha fatto Jensen Huang, CEO di Nvidia. Groq e Nvidia hanno stipulato un accordo di licenza non esclusiva per la tecnologia di inferenza, permettendo al colosso verde di integrare i velocissimi processori LPU (Language Processing Unit) nella propria architettura.

Sulla carta, Groq rimane un’azienda indipendente. Nella pratica, il suo fondatore Jonathan Ross e gran parte del team di ingegneri d’élite traslocheranno negli uffici di Nvidia. È una mossa brillante e spietata: si acquisisce il cervello (le persone) e il muscolo (la tecnologia), lasciando lo scheletro societario libero di “competere” senza far scattare gli allarmi dei regolatori americani ed europei.

Una mossa da scacchista (o da prestigiatore?)

Per capire perché questa operazione è sismica, bisogna guardare sotto il cofano. Fino a oggi, Nvidia ha dominato l’addestramento delle AI (il training), ovvero la fase in cui i modelli “imparano” leggendo intere biblioteche. Ma la vera partita del 2026 si gioca sull’inferenza: il momento in cui l’AI risponde alle nostre domande.

È qui che Groq brillava. I suoi chip non usano la forza bruta come le GPU di Nvidia, ma un approccio deterministico che spara le risposte a velocità quasi istantanea.

Per l’utente finale, la differenza è come passare da una conversazione via walkie-talkie con un ritardo di due secondi a una chiacchierata dal vivo. Nvidia sapeva di avere un tallone d’Achille sulla velocità di inferenza a basso costo. Invece di spendere anni a sviluppare una soluzione interna, ha pagato un premio enorme per averla subito: secondo le stime degli analisti, il valore dell’operazione tocca i 20 miliardi di dollari, quasi il triplo della valutazione precedente della startup.

Questa cifra esorbitante serve a giustificare quella che, in gergo tecnico, chiamiamo “acqui-hire” sotto steroidi. Nvidia non sta solo comprando brevetti; sta eliminando un concorrente trasformandolo in un partner forzato. Jonathan Ross, l’uomo che aveva creato le TPU di Google e poi fondato Groq per sfidare proprio Nvidia, ora lavorerà per consolidare l’impero che voleva abbattere.

Sebbene Groq abbia dichiarato che l’accordo con Nvidia è un ‘accordo di licenza tecnologica non esclusiva’, il suo fondatore e CEO Jonathan Ross e il team esecutivo si uniranno a Nvidia.

— Comunicato Ufficiale Groq (via MEXC)

Ma c’è un dettaglio che rende tutto ancora più interessante.

Cosa succede a chi resta indietro?

Perché non comprare tutto e basta?

La risposta è semplice: monopolio.

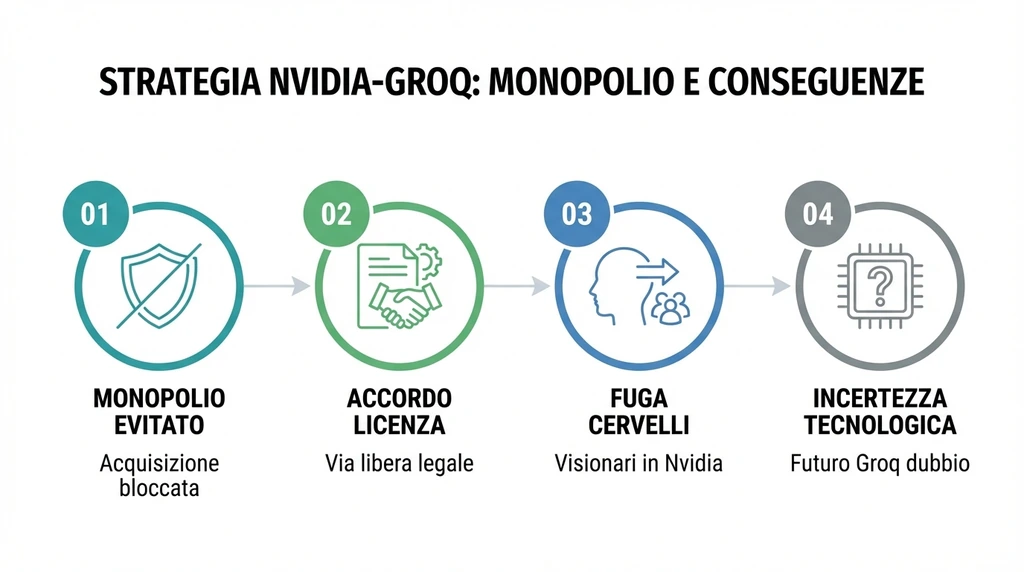

Nvidia detiene già tra l’85% e il 90% del mercato dei chip per l’addestramento AI. Un’acquisizione diretta di Groq sarebbe stata bloccata dalla Federal Trade Commission prima ancora di poter stappare lo champagne. Strutturando l’accordo come una “licenza non esclusiva”, le due aziende aggirano elegantemente l’ostacolo.

Nvidia dice: “Ehi, non li abbiamo comprati, la loro tecnologia è disponibile anche per altri!”.

È vero, tecnicamente. Ma con i creatori di quella tecnologia ora stipendiati da Nvidia, chi svilupperà le prossime versioni dei chip Groq? La “Groq indipendente” si trova ora con le casse piene di liquidità ma svuotata dei suoi visionari.

È una situazione paradossale: l’azienda è più ricca che mai, ma il suo futuro tecnologico è incerto.

Tuttavia, il messaggio ufficiale cerca di mantenere un tono di continuità operativa. Per rassicurare clienti e investitori, è stato confermato che Groq continuerà a operare come entità indipendente sotto la guida del nuovo CEO Simon Edwards, che avrà il non invidiabile compito di guidare una nave il cui capitano è appena salito a bordo della flotta avversaria. Edwards, ex CFO, dovrà trasformare Groq da “sfidante tecnologico” a, presumibilmente, una società di servizi e licenze estremamente redditizia.

Il futuro di Groq (e il nostro)

Per noi utenti, l’impatto sarà tangibile e, ammettiamolo, positivo nel breve termine. L’integrazione della tecnologia Groq nell’ecosistema Nvidia (CUDA) significa che i modelli di linguaggio che useremo nel 2026 diventeranno incredibilmente reattivi.

Immaginate assistenti vocali che vi interrompono con naturalezza o traduzioni simultanee che non perdono un colpo. La latenza, quel fastidioso tempo di attesa tra la domanda e la risposta, è destinata a scomparire.

L’accordo riflette un focus condiviso sull’espansione dell’accesso a un’inferenza ad alte prestazioni e a basso costo.

— Groq, Comunicato Stampa Ufficiale

Tuttavia, c’è un rovescio della medaglia che non possiamo ignorare.

La concentrazione di potere.

Se Nvidia controlla sia l’addestramento (con le sue GPU H100/H200/Blackwell) sia l’inferenza ultra-rapida (con la tecnologia Groq), diventa il collo di bottiglia unico dell’intelligenza mondiale. Ogni startup, ogni ricercatore, ogni app che useremo dovrà pagare il dazio a Jensen Huang.

Siamo di fronte a un bivio affascinante e inquietante. Da un lato, l’accelerazione tecnologica è garantita: unendo le forze, i problemi di scalabilità dell’AI potrebbero risolversi in mesi anziché anni. Dall’altro, stiamo assistendo alla sistematica eliminazione della diversità nell’hardware. Se tutti i pensieri delle macchine passano attraverso lo stesso tipo di silicio, controllato dalla stessa azienda, chi garantisce che l’innovazione non rallenti quando non ci saranno più concorrenti da comprare o cooptare?

La domanda che ci lascia questo Santo Stefano tecnologico non è se le nostre AI diventeranno più veloci — quello è certo — ma se, alla fine della fiera, avremo ancora una scelta su quale “cervello” elettronico utilizzare, o se l’unica opzione rimasta sarà quella verde smeraldo di Nvidia.