Skild AI: Sorveglianza Robotica e i Dubbi sulla Privacy

Dietro l’entusiasmo per Skild AI e i suoi robot intelligenti si nascondono interrogativi inquietanti sulla privacy e sulla sicurezza dei dati raccolti

C’è qualcosa di perversamente affascinante nel vedere 1,4 miliardi di dollari materializzarsi dal nulla e piovere sulla testa di una singola azienda in un martedì qualunque di gennaio.

Accade oggi, nel 2026, con Skild AI, una società che promette di aver trovato il “Santo Graal” della robotica: un cervello unico, onnipotente e onnipresente, capace di animare qualsiasi pezzo di metallo, dai cani robotici agli umanoidi che dovrebbero, in teoria, piegare i panni nelle nostre case.

Ma se togliamo la patina luccicante dei comunicati stampa e smettiamo di farci abbagliare dalle cifre a nove zeri, cosa resta?

Resta una domanda fondamentale che in pochi sembrano porsi mentre firmano assegni in bianco: chi controllerà gli occhi e le orecchie di questi robot “intelligenti” una volta che saranno sguinzagliati nel mondo reale?

L’annuncio odierno non è solo una notizia finanziaria, è un avvertimento.

Skild AI ha ufficializzato un nuovo round di finanziamento di serie C da 1,4 miliardi di dollari, portando la valutazione complessiva dell’azienda a una cifra vertiginosa che supera i 14 miliardi. A guidare la cordata c’è SoftBank, il colosso giapponese noto per le sue scommesse aggressive, affiancato da Jeff Bezos e Nvidia.

Il cuore di tutto questo clamore è lo “Skild Brain”, un modello di fondazione per la robotica.

L’idea è seducente: invece di programmare un robot per fare una cosa specifica (come saldare una portiera), si crea un’intelligenza artificiale che impara guardando video e simulazioni, capace di adattarsi a qualsiasi corpo fisico. Deepak Pathak, CEO di Skild AI, lo descrive con un entusiasmo quasi messianico:

Lo Skild Brain può controllare robot su cui non è mai stato addestrato, adattandosi in tempo reale a cambiamenti estremi nella forma o nell’ambiente. Il modello è costretto ad adattarsi piuttosto che a memorizzare – molto simile all’intelligenza in natura.

— Deepak Pathak, CEO e Co-Fondatore di Skild AI

Tutto molto bello, se non fosse che “l’intelligenza in natura” non invia dati ai server di Amazon o SoftBank ogni volta che sbatte il mignolo contro uno spigolo.

Ed è qui che la narrazione del progresso tecnologico inizia a scricchiolare sotto il peso delle implicazioni sulla privacy.

Il miraggio della crescita infinita (o la bolla 2.0)

Per capire la portata di ciò che sta accadendo, bisogna guardare ai numeri con il cinismo di un contabile forense.

Fino alla metà del 2024, Skild AI valeva circa 4,5 miliardi di dollari. Oggi, meno di due anni dopo, vale più del triplo. Cosa giustifica un salto del genere?

I sostenitori punteranno il dito sulla crescita esplosiva del fatturato. Secondo i report più recenti, l’azienda è passata da zero a decine di milioni di dollari di entrate in pochi mesi nel corso del 2025, assicurandosi clienti come l’aeroporto LaGuardia.

Un risultato impressionante, certo. Ma una valutazione di 14 miliardi su un fatturato di “decine di milioni” implica un moltiplicatore che farebbe impallidire anche le più speculative dot-com degli anni Duemila.

Siamo di fronte a una scommessa, non a un investimento razionale.

Una scommessa sul fatto che Skild AI diventi il sistema operativo de facto del mondo fisico. Se Windows controllava i PC e Android controlla gli smartphone, Skild vuole controllare tutto ciò che si muove.

E chi controlla il movimento, controlla lo spazio.

Ma c’è un dettaglio che trasforma questa scommessa finanziaria in un incubo potenziale per la privacy. Per giustificare questa valutazione, Skild AI deve scalare. Deve essere ovunque.

E per funzionare, il suo “cervello” ha bisogno di dati. Tanti dati.

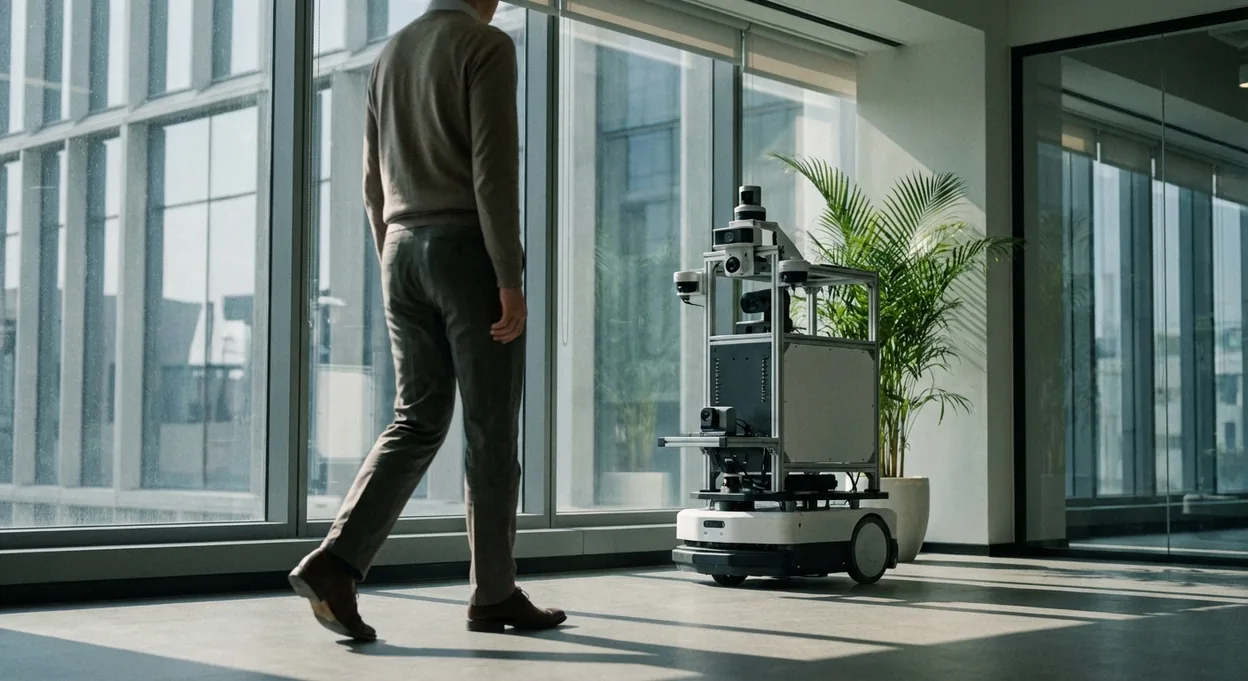

La sorveglianza mobile entra nelle nostre case

Il modello di business proposto si basa su quello che l’industria chiama “data flywheel”, o volano dei dati.

Più robot ci sono in giro, più dati raccolgono; più dati raccolgono, più intelligente diventa il modello; più intelligente è il modello, più robot si vendono. È un circolo virtuoso per gli investitori, ma vizioso per i cittadini.

Deepak Pathak non ne fa mistero, anzi, lo sbandiera come un vantaggio competitivo:

Crediamo che un cervello unificato e onnicorporale sia il modo più veloce per stabilire un volano di dati continuo in cui il modello migliora con ogni singola implementazione, indipendentemente dall’hardware o dal compito.

— Deepak Pathak, CEO e Co-Fondatore di Skild AI

Analizziamo questa frase con la lente del GDPR. Un “volano di dati continuo” significa che ogni robot, sia esso un assistente in un ospedale o un magazziniere in un deposito, è un terminale di raccolta dati attivo 24 ore su 24.

Se un robot Skild opera in un ambiente pubblico o domestico, cosa registra? Volti? Voci? Abitudini?

Il principio di minimizzazione dei dati (Articolo 5 del GDPR), che impone di raccogliere solo ciò che è strettamente necessario, cozza violentemente con la necessità di un’intelligenza artificiale generica di “osservare tutto” per imparare a muoversi in ambienti non strutturati.

Se il robot deve “adattarsi in tempo reale”, deve processare costantemente l’ambiente circostante.

In pratica, stiamo finanziando la creazione della più vasta rete di telecamere mobili della storia, mascherata da progresso nell’automazione.

E chi ha accesso a questi dati? Gli investitori includono Jeff Bezos e Nvidia. Non serve essere complottisti per intravedere il conflitto di interessi.

Amazon ha bisogno di robot efficienti per i magazzini, ma ha anche una fame insaziabile di dati comportamentali. Nvidia vende l’hardware su cui girano questi calcoli. È un ecosistema chiuso dove il prodotto siamo, ancora una volta, noi e i nostri spazi fisici.

Il paradosso della sicurezza (e il silenzio dei regolatori)

C’è poi l’aspetto della sicurezza fisica, spesso oscurato dall’entusiasmo per l’AGI (Intelligenza Artificiale Generale).

Quando un modello linguistico come ChatGPT “allucina”, scrive una sciocchezza.

Quando un robot da 100 kg gestito da un’IA “allucina” in un ambiente fisico, rompe cose o persone.

L’idea che un software possa gestire robot su cui “non è mai stato addestrato” è tecnicamente affascinante ma operativamente terrificante.

Stiamo parlando di una startup fondata a Pittsburgh solo nel 2023 che oggi pretende di aver risolto la complessità del mondo fisico. La velocità con cui questa tecnologia viene spinta sul mercato, dopata da capitali di rischio che cercano un ritorno rapido, non lascia tempo per una verifica seria degli standard di sicurezza.

Il Regolamento Europeo sull’IA (AI Act) classifica i sistemi di sicurezza nei prodotti come “ad alto rischio”, ma la fluidità di questi modelli “general purpose” rende difficile l’applicazione delle norme.

Se il software cambia e impara costantemente, come si certifica la sua sicurezza? È un bersaglio mobile che i legislatori, lenti per natura, non riusciranno a colpire.

Mentre SoftBank e soci festeggiano l’ennesima valutazione miliardaria, noi dovremmo chiederci: siamo pronti a vivere in un mondo dove l’infrastruttura fisica è gestita da una scatola nera algoritmica il cui unico obiettivo è massimizzare l’efficienza e la raccolta dati?

La rivoluzione robotica è arrivata, ma sembra che l’unico a non essere stato invitato al tavolo delle decisioni sia, come al solito, l’utente finale.