Il Dominio di OpenAI nel 2025: Realtà e Minacce Nascoste

Nonostante la leadership di OpenAI, l’attenzione si sposta verso l’inferenza locale e i modelli open source, aprendo nuove prospettive sull’evoluzione dell’intelligenza artificiale.

Se guardiamo alla storia recente dell’informatica, il 2025 doveva essere l’anno della frammentazione, il momento in cui il monopolio iniziale di un singolo attore si sarebbe sgretolato sotto il peso della concorrenza open source e della potenza di fuoco delle Big Tech. Invece, arrivati a questo 22 dicembre, ci troviamo davanti a uno scenario che ricorda più il dominio di Windows negli anni ’90 che la guerra dei browser dei primi anni 2000.

Il panorama delle intelligenze artificiali generative, tre anni dopo il “momento Netscape” di ChatGPT, appare incredibilmente statico nelle quote di mercato, ma tecnicamente in ebollizione sotto la superficie.

Nonostante gli sforzi titanici di Google e la retorica aggressiva di xAI, OpenAI mantiene una presa ferrea sul settore. Non è solo una questione di abitudine o di brand awareness; c’è una componente tecnica di “lock-in” che molti analisti generalisti tendono a sottovalutare. Per chi scrive codice e integra queste API quotidianamente, la resistenza al cambiamento non è pigrizia, ma una valutazione pragmatica dei costi di transizione in un ecosistema dove il prompt engineering è diventato debito tecnico.

La fotografia scattata dai dati di fine anno è impietosa per gli sfidanti. ChatGPT mantiene una quota di mercato globale superiore al 60%, una cifra che oscilla tra il 60,4% e il 67% a seconda delle metriche di traffico analizzate. È un dominio che sfida la logica tradizionale del software, dove solitamente l’integrazione verticale (come quella di Apple o Google) vince sul prodotto stand-alone. Qui, il prodotto stand-alone è diventato l’infrastruttura stessa.

L’inerzia dell’ecosistema e la trappola dell’integrazione

Per capire perché Google non abbia ancora “vinto” questa partita, bisogna guardare oltre i comunicati stampa e analizzare l’architettura delle soluzioni. Gemini, ex Bard, ha avuto un percorso accidentato, segnato da rebranding confusi che hanno minato la fiducia degli sviluppatori. Nonostante Gemini si fermi a una quota di mercato del 13,5% pur con l’integrazione nativa in Android, la sua crescita è stata frenata non dalla mancanza di capacità, ma dalla frizione nell’esperienza utente e da un modello di rilascio che definirei “schizofrenico”.

Dal punto di vista tecnico, Gemini ha carte eccellenti: una finestra di contesto enorme e capacità multimodali native (gestire video, audio e testo nello stesso stream di token) che sulla carta superano l’architettura “mixture of experts” di GPT-4. Tuttavia, nel mondo reale, la latenza e la consistenza delle risposte sono le metriche che contano.

Per un utente medio, o per un’azienda che integra AI, il fatto che Gemini possa analizzare un video di un’ora è irrilevante se fallisce nel fornire una risposta JSON formattata correttamente per un’API, un compito dove i modelli OpenAI eccellono da anni grazie a un fine-tuning maniacale.

C’è poi il paradosso di Microsoft Copilot. Con una quota del 14,1%, Copilot si trova in una posizione bizzarra: compete con il prodotto che ne fornisce il motore (OpenAI) ma vive all’interno della suite Office. Tecnicamente, Copilot soffre di quello che chiamiamo “over-safety engineering”. I layer di sicurezza e i metaprompt che Microsoft inietta prima che la richiesta dell’utente raggiunga il modello aggiungono latenza e spesso sterilizzano le risposte, rendendo l’esperienza meno fluida rispetto all’uso diretto di ChatGPT. È il classico caso in cui l’architettura enterprise, necessaria per la compliance, soffoca l’usabilità.

Il paradosso di Microsoft e la nicchia rumorosa

Mentre i giganti si scontrano sui decimali, c’è chi cerca di giocare una partita diversa. Grok di xAI, la creatura di Elon Musk integrata nella piattaforma X (ex Twitter), rappresenta un caso studio affascinante di “product-market fit” mancato, almeno per ora. Con uno share che non supera lo 0,6%, Grok è statisticamente irrilevante nel grande schema delle cose, ma tecnicamente interessante per la sua pipeline di addestramento in tempo reale sui dati di X.

Il problema di Grok non è il modello in sé – che ha dimostrato buone capacità di ragionamento – ma il canale di distribuzione. Limitare un LLM (Large Language Model) a una singola piattaforma social e posizionarlo come un’alternativa “anti-woke” lo relega a una nicchia ideologica, precludendogli l’adozione nel settore enterprise, che è dove si fanno i veri volumi di inferenza. Nessun CTO sano di mente integrerebbe nei propri sistemi aziendali un’AI progettata per essere “arguta” piuttosto che affidabile.

Inoltre, guardando ai dati statunitensi, il mercato dell’IA generativa mostra ancora una netta preferenza per le soluzioni consolidate, suggerendo che la “fatica da abbonamento” sta iniziando a farsi sentire. Gli utenti hanno scelto il loro cavallo vincente nel 2023 e, a meno di rivoluzioni copernicane nelle capacità di ragionamento (non semplici incrementi di velocità), non hanno intenzione di migrare la propria cronologia di chat e i propri “Custom GPT” altrove.

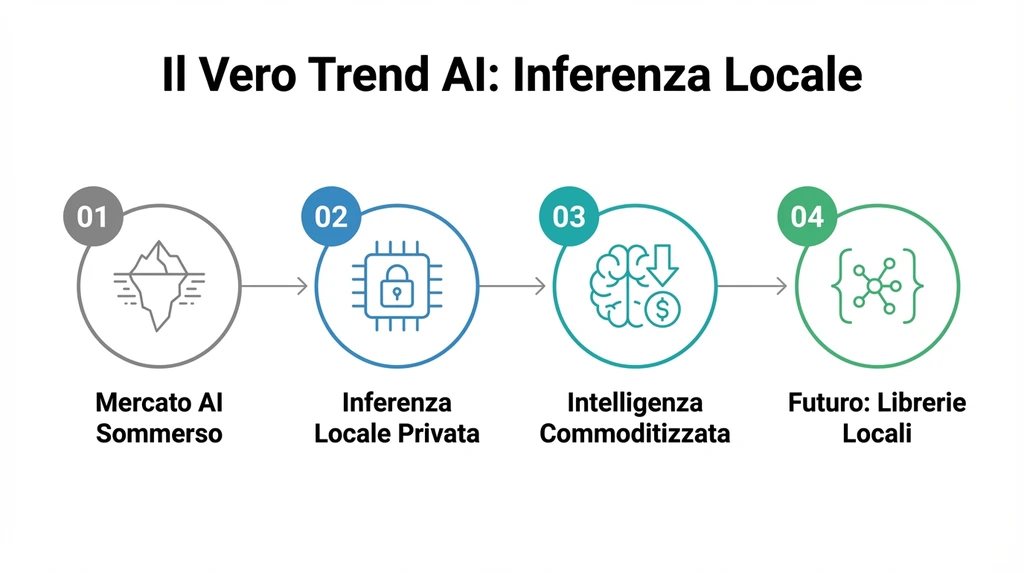

Quello che i grafici non dicono: l’inferenza locale

Tuttavia, analizzare il mercato basandosi solo sul traffico web o sugli utenti attivi mensili (450 milioni per Gemini contro gli 800 milioni settimanali di ChatGPT) nasconde una parte fondamentale della storia tecnica di questo 2025: l’ascesa dell’inferenza locale e dei modelli open weights.

I dati ufficiali non tracciano chi scarica Llama 3, Mistral o i modelli di DeepSeek per farli girare su server privati o addirittura su laptop dotati di Apple Silicon. Questo è il “mercato sommerso” dell’AI. Mentre OpenAI domina il mercato consumer e le API generaliste, c’è una migrazione silenziosa di sviluppatori e aziende verso modelli che offrono trasparenza totale e controllo dei dati. Tecnologie come la quantizzazione (che permette di ridurre la precisione dei pesi del modello per farlo girare su hardware meno costoso senza perdere troppa “intelligenza”) stanno rendendo l’autarchia tecnologica una via percorribile.

La vera minaccia per OpenAI non è Gemini, che è solo un’altra versione chiusa e centralizzata dello stesso paradigma. La minaccia è la commoditizzazione dell’intelligenza. Se un modello open source che posso far girare “in casa” raggiunge il 95% delle prestazioni di GPT-4 a costo zero (escluso l’hardware), il modello di business basato sull’abbonamento mensile o sul costo per token inizia a scricchiolare.

Siamo di fronte a un oligopolio che sembra stabile solo perché stiamo guardando le metriche sbagliate. OpenAI ha vinto la battaglia dell’interfaccia utente e del “brand”, diventando sinonimo di AI come Google lo è di ricerca. Ma sotto il cofano, l’architettura del software mondiale si sta riorganizzando.

La domanda da porsi per il 2026 non è se Gemini supererà ChatGPT, ma se avremo ancora bisogno di questi immensi oracoli centralizzati o se l’intelligenza diventerà una libreria locale, invisibile e onnipresente, integrata silenziosamente nel codice che scriviamo ogni giorno. L’attuale dominio del 60% potrebbe essere l’apice di un’era, non l’inizio di un impero eterno.