L’ia generativa e il futuro incerto del mid-market nel 2026

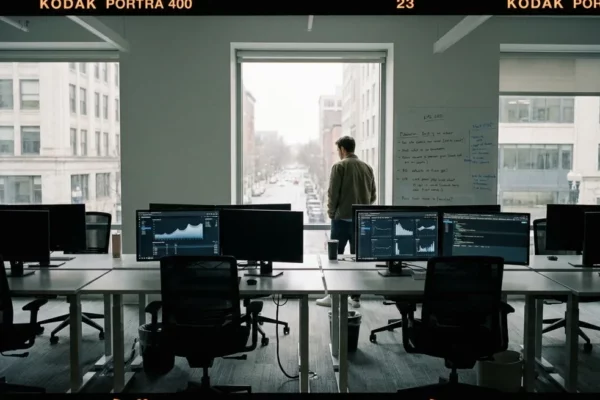

IA generativa e divario digitale: le aziende medie di fronte alla sfida dell’integrazione per non soccombere alla disparità tecnologica.

Se guardiamo sotto il cofano dell’economia globale in questo inizio di 2026, ignorando per un attimo i keynote luccicanti della Silicon Valley, noteremo un rumore di fondo preoccupante. Non è il ronzio dei server farm, ma lo scricchiolio del cosiddetto mid-market, quel tessuto di aziende medie che storicamente genera un terzo del PIL e dell’occupazione nel settore privato.

Siamo entrati ufficialmente nella fase due dell’era dell’Intelligenza Artificiale Generativa. La fase uno era quella dello stupore, delle chat divertenti e delle demo tecniche impressionanti ma isolate.

La fase due è quella dell’integrazione strutturale, o per usare un termine più tecnico, della “messa in produzione”. E qui i nodi stanno venendo al pettine con una brutalità algoritmica.

Mentre le Big Tech hanno passato l’ultimo triennio a costruire le infrastrutture fondamentali — i Foundation Models — la vera partita economica si gioca sulla capacità delle aziende medie di agganciare queste API ai propri database legacy, spesso disordinati e frammentati.

La promessa è allettante: uno studio stima il potenziale economico globale dell’IA generativa tra i 6 e gli 8 trilioni di dollari, una cifra che potrebbe rivitalizzare un settore che ha dimostrato una resilienza straordinaria nelle crisi del 2007 e del 2020.

Tuttavia, tra la promessa teorica e l’implementazione pratica c’è di mezzo un oceano di debito tecnico.

L’architettura invisibile della disparità

Dal punto di vista sistemistico, il problema non è la mancanza di strumenti, ma la loro complessità architetturale. L’abbassamento dei costi di inferenza è crollato di quasi dieci volte all’anno, rendendo teoricamente accessibile a chiunque l’uso di modelli avanzati.

Ma l’accessibilità del modello non equivale all’utilità aziendale.

Per far funzionare l’IA in un contesto aziendale reale, non basta una chiamata API a un modello ospitato nel cloud. Serve un’infrastruttura di dati pulita, pipeline ETL robuste e sistemi di RAG che impediscano al modello di “allucinare” inventando numeri di bilancio.

Le grandi corporation hanno dipartimenti IT interi dedicati a questa idraulica dei dati. Le aziende medie, spesso, hanno un paio di sistemisti eroi che gestiscono tutto, dal Wi-Fi che non va alla cybersecurity.

Il risultato è un divario di adozione che sta assumendo contorni critici. I dati più recenti mostrano che l’utilizzo dell’IA tra le grandi aziende è circa tre volte superiore rispetto alle realtà più piccole.

Questo non è solo un problema di “chi arriva prima”, ma una questione di sopravvivenza darwiniana del business.

Chi non automatizza i processi a basso valore aggiunto non potrà competere sui margini.

I paesi, le istituzioni e le organizzazioni che non riescono a integrare l’IA nelle loro strategie di ricerca e innovazione rischiano di rimanere indietro rispetto a concorrenti più agili e innovativi. In un’economia globale sempre più definita dalla conoscenza e dalla velocità, questo divario può diventare rapidamente strategico.

— Dr Daniel Hook, CEO di Digital Science

Agenti autonomi e il costo dell’inferenza

Tecnicamente, stiamo assistendo a una transizione dai semplici chatbot agli “Agentic AI”, ovvero sistemi ad agenti autonomi.

A livello di codice, non stiamo più chiedendo a un LLM di “scrivere una mail”, ma stiamo istanziando agenti capaci di leggere la mail in arrivo, interrogare il gestionale ERP per verificare la disponibilità di un prodotto, calcolare uno sconto basato sullo storico cliente e inviare una risposta, il tutto senza intervento umano.

L’eleganza tecnica di queste soluzioni è innegabile: si passa da flussi di lavoro imperativi a flussi dichiarativi. Tuttavia, questa automazione “agentica” è un’arma a doppio taglio.

Se implementata male — pensiamo a un agente che concede sconti non autorizzati a causa di un prompt injection — i danni possono essere immediati e su larga scala.

L’IA è passata dalla sperimentazione alla produzione in tutta l’impresa. Questo cambiamento modifica l’economia del rischio. Non ci si può permettere di scoprire problemi di sicurezza a posteriori.

— Peter McKay, CEO di Snyk

Il tasso di fallimento dei progetti pilota di IA nelle aziende medie raggiunge picchi del 95%. Molti falliscono non perché l’IA non sia intelligente, ma perché i dati sottostanti sono “sporchi”.

Un modello addestrato o connesso a dati di scarsa qualità amplificherà semplicemente il caos esistente a una velocità supersonica. È la vecchia legge dell’informatica: Garbage In, Garbage Out, elevata alla potenza dell’intelligenza artificiale.

Il debito tecnico sociale

C’è poi un livello di astrazione superiore, quello macroeconomico, che non possiamo ignorare. L’efficienza tecnica porta inevitabilmente a una ridistribuzione del carico di lavoro.

Se un’architettura a microservizi basata su agenti AI può svolgere il lavoro di data entry, analisi preliminare e supporto clienti di primo livello, cosa accade ai ruoli junior che tradizionalmente occupavano quelle posizioni?

Qui la visione si fa cupa.

L’FMI ha lanciato allarmi precisi: i guadagni di produttività dell’IA potrebbero schiacciare la classe media e creare barriere all’occupazione giovanile.

La tecnologia, per sua natura, tende a concentrare i benefici dove c’è già scalabilità. Un’azienda che ha già digitalizzato i suoi processi moltiplica la sua efficienza; chi lavora ancora su carta o fogli di calcolo sconnessi viene tagliato fuori.

Non è solo questione di “perdere il lavoro”, ma di vedere stagnare i salari mentre la produttività aumenta, un disaccoppiamento che tecnicamente arricchisce solo i detentori del capitale e i lavoratori ad altissima specializzazione che sanno orchestrare questi sistemi complessi.

L’open source gioca qui un ruolo fondamentale ma ambiguo. Da un lato, modelli come le ultime iterazioni di Llama o Mistral permettono alle aziende medie di non dipendere totalmente dai giganti americani, potendo ospitare i modelli on-premise per questioni di privacy e costi.

Siamo di fronte a un paradosso tecnico-sociale: abbiamo costruito strumenti di una potenza inaudita, capaci di democratizzare l’accesso alla “conoscenza sintetica”, ma l’infrastruttura sociale ed economica necessaria per distribuire questi benefici sembra ancora girare su un vecchio codice legacy, pieno di bug e vulnerabilità.

La domanda che dobbiamo porci, mentre osserviamo i log di sistema di questa trasformazione globale, non è se l’IA funzionerà — tecnicamente funziona già fin troppo bene — ma se il nostro tessuto economico è abbastanza elastico da assorbire l’aggiornamento senza andare in crash.

Stiamo ottimizzando il sistema per l’efficienza massima o stiamo inavvertitamente scrivendo la procedura di shutdown per la classe media?