Google sta automatizzando il lavoro dei ricercatori e degli analisti

Google sta infiltrando l'IA in domini specialistici come ricerca e finanza, automatizzando processi critici e sfidando il ruolo dell'autorevolezza umana.

Google sta portando l’intelligenza artificiale nei processi specialistici di ricerca e finanza, ridefinendo il ruolo degli esperti.

Immagina di essere un ricercatore universitario, è mezzanotte, la scadenza per la conferenza è domani e il grafico che dovrebbe spiegare la tua scoperta più importante sembra ancora uscito da un esperimento di fisica delle particelle degli anni ’80.

Fino a ieri, avresti imprecato contro il software di visualizzazione e bevuto il terzo caffè. Oggi, forse, chiedi aiuto a un nuovo collega digitale.

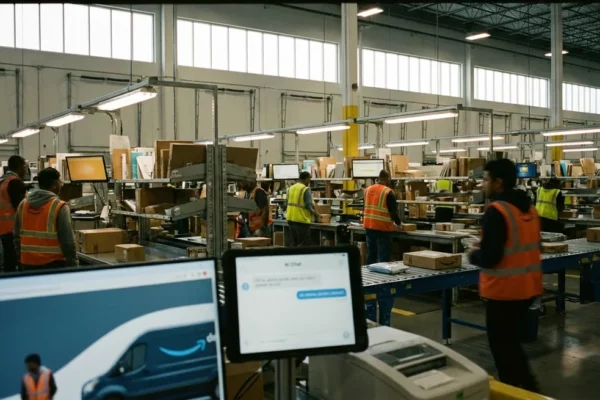

Quello che sta succedendo in laboratori, redazioni finanziarie e uffici di ricerca non è solo l’arrivo di un chatbot più bravo. È un’infiltrazione silenziosa e capillare dell’intelligenza artificiale in domini specialistici dove il sapere umano era l’unica valuta. Google, spesso associata al motore di ricerca per tutti, sta piazzando i suoi pezzi in un gioco più sottile: automatizzare i processi critici del pensiero stesso, dalla validazione di un’idea al suo valore sul mercato.

Non solo chat: l’IA diventa il tuo braccio destro (digitale) in laboratorio

Prendi il mondo accademico, tradizionale e lento per definizione. L’8 aprile 2026, Google ha presentato due agenti IA accademici pensati per snellire due nodi cruciali della produzione scientifica. Il primo è un agente per figure accademiche chiamato PaperVizAgent, che trasforma descrizioni testuali in visualizzazioni complesse. Il secondo, ScholarPeer, è un revisore automatico accademico in grado di valutare un articolo con rigore metodologico.

L’obiettivo dichiarato è “migliorare il flusso di lavoro”, non sostituire il ricercatore. Ma quando uno strumento come PaperVizAgent ottiene un punteggio di 60.2 su 100 nelle valutazioni, la domanda sorge spontanea: quanto tempo prima questo diventerà lo standard per preparare una submission? E se l’IA iniziasse a dettare, attraverso i suoi critori di valutazione automatici, cosa è un buon paper o una figura efficace?

Dai grafici ai grafici a candela: quando l’IA valuta il mercato

Se in accademia si automatizza la peer-review, nella finanza si automatizza l’analisi. La nuova versione di Google Finance in 100+ paesi è un esempio perfetto di come l’IA stia diventando un interlocutore privilegiato per decisioni complesse. Non si tratta più di solo storico dei prezzi. Ora puoi fare ricerche complesse con l’IA sui mercati, porre domande in linguaggio naturale su asset e trend.

Il salto è ancora più evidente durante gli annunci degli utili. La piattaforma offre approfondimenti IA in tempo reale, sincronizzando audio, trascrizioni e generando riassunti e punti chiave al volo. Il lavoro di ore di un analista – ascoltare la call, prendere appunti, incrociare dati – viene compresso in pochi secondi. La barriera all’ingresso per un’analisi sofisticata si abbassa drasticamente. Ma dove finisce l’assistenza e inizia la delega del giudizio?

Il sapere umano nell’era dell’automazione cognitiva

Questa non è una semplice evoluzione degli strumenti. È una ridefinizione del valore. In un mondo dove l’IA può produrre una figura scientifica decente o distillare il senso di un report finanziario, il mestiere dello specialista si sposta un gradino più in alto. Dalla pura esecuzione o dall’analisi di prima istanza, alla formulazione delle domande giuste, alla contestualizzazione critica, alla verifica di ciò che la macchina produce.

Google stessa sta già pensando al passo successivo: preparare le nuove generazioni a questo nuovo equilibrio. Con un esperimento di ricerca chiamato Vantage, si punta a sviluppare competenze future con l’IA. Il tool, pensato per studenti delle scuole superiori e universitari, usa l’IA generativa per valutare skills come il pensiero critico in scenari simulati. È un’ammissione implicita: il futuro non è della competizione uomo-macchina, ma della collaborazione.

La vera rivoluzione, quindi, non sta nella macchina che scrive, ma in quella che ragiona al nostro fianco in settori iper-specializzati. Il rischio? Una comoda deresponsabilizzazione, l’accettazione acritica di un output “tecnico” che sembra autorevole. L’opportunità? Liberare tempo mentale per quello che gli umani sanno ancora fare meglio: dubitare, connettere mondi disparati, avere un’intuizione. La posta in gioco non è l’efficienza, ma l’autorevolezza. E su quella, non esistono ancora shortcut algoritmici.