Un modello di embedding si specializza in poche ore.

Con una GPU e dati sintetici generati da LLM, il fine-tuning di embedding per domini specifici diventa accessibile in poche ore, come dimostrato da NVIDIA e Atlassian.

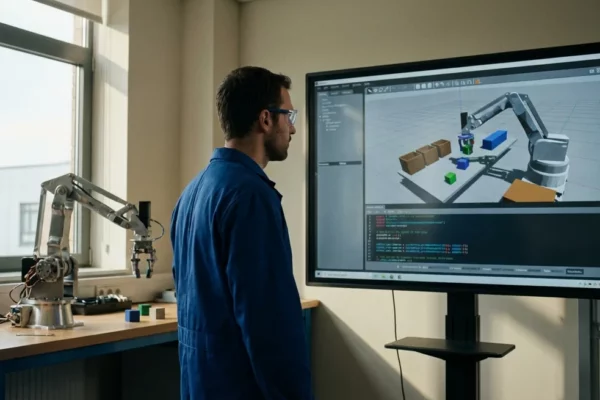

Il processo, reso accessibile da NVIDIA, sfrutta dati sintetici generati da LLM per addestrare e valutare agenti in poche ore.

Con una singola GPU e meno di un giorno di addestramento, potete trasformare un modello di embedding generico in uno specializzato sul vostro dominio: il fine-tuning di embedding per domini specifici non è più un’operazione da laboratorio di ricerca, ma un’opzione pratica per qualsiasi team.

Il segreto? Dati sintetici generati da LLM, che stanno diventando il carburante per l’auto-miglioramento degli agenti AI.

Dati sintetici su misura: il motore dell’adattamento

La ricetta, resa popolare da NVIDIA, prevede l’uso di un LLM come parte di la pipeline di addestramento per generare coppie domanda-risposta contestuali. La generazione di dati sintetici viene gestita da tool come NeMo Data Designer, che automatizzano la creazione di corpus pertinenti. I risultati sono tangibili: Atlassian ha ottenuto un aumento del 26% della Recall@60 dopo aver applicato il fine-tuning al proprio dataset JIRA. L’intero processo, da zero a modello specializzato, è fattibile in poche ore.

Supervisione in tempo reale: quando l’agente deve essere controllato

Addestrare agenti con dati sintetici solleva il problema del controllo. OpenAI ha implementato un sistema di monitoraggio alimentato da GPT-5.4, dedicato a il monitoraggio per il misalignment delle catene di pensiero e delle azioni degli agenti di codifica. Quando il sistema rileva un’anomalia potenziale, la segnala per la revisione umana, inserendo un giudizio esperto nel ciclo di automazione. Questo protocollo è essenziale in ambienti non controllati.

Valutazione bot-to-bot: il banco di prova per gli agenti vocali

La valutazione stessa si evolve grazie ai dati sintetici. ServiceNow ha rilasciato il framework di valutazione EVA, che utilizza un’architettura bot-to-bot per testare conversazioni vocali complesse. Il dataset di valutazione EVA parte da 50 scenari per compagnie aeree, mettendo alla prova la valutazione di agenti vocali su ragionamento temporale, rispetto delle policy e gestione di vincoli. Crea un terreno di prova sintetico ma realistico, scalando la valutazione oltre i limiti dei test umani.

Per gli sviluppatori, lo stack si arricchisce di due componenti critici: un generatore di dati sintetici e un monitor di sicurezza in tempo reale. Il fine-tuning domain-specific diventa un layer accessibile, ma va bilanciato con un sistema di osservabilità che ispezioni il ragionamento dell’agente, non solo il suo output. L’eleganza sta nel ciclo chiuso: dati sintetici per addestrare, dati sintetici per valutare, e un sorvegliante AI per intervenire. La posta in gioco è la creazione di agenti che possono evolversi in autonomia, ma senza scivolare in comportamenti inattesi.