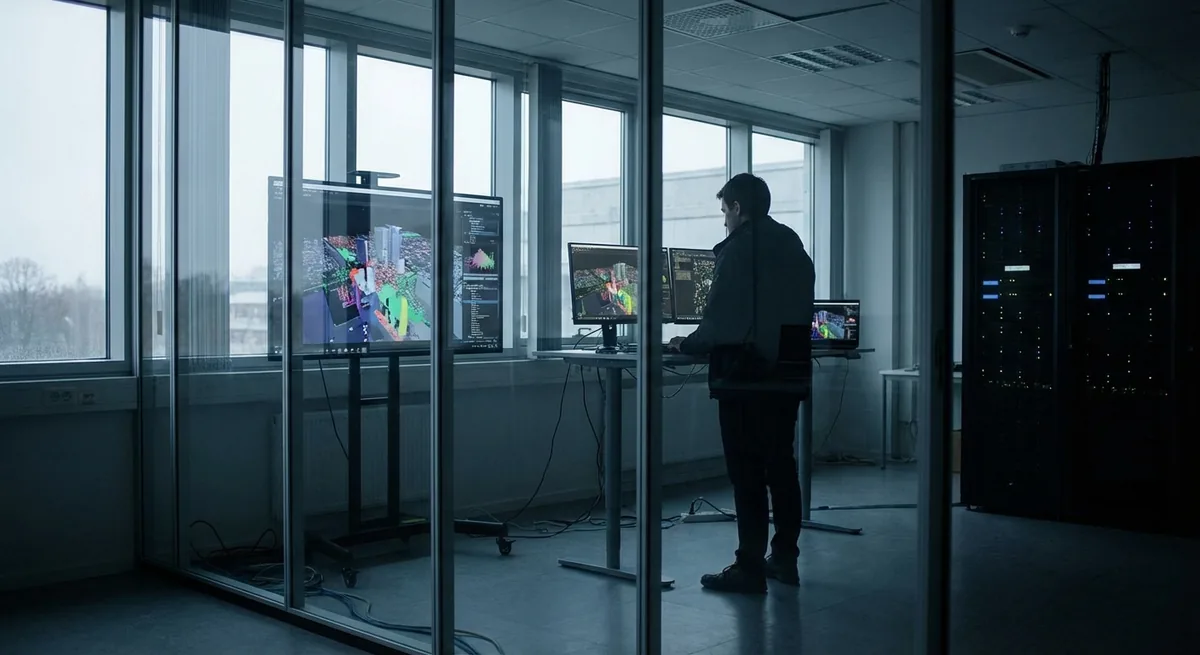

Le aziende stanno costruendo mondi paralleli per addestrare l’IA.

Modelli AI come Falcon Perception si addestrano su milioni di immagini web. Holo3 crea universi sintetici controllati, sfidando le norme privacy come il GDPR e sollevando questioni etiche fondamentali.

I dati sintetici usati per l’addestramento aggirano le normative sulla privacy e sfuggono al controllo democratico

Quante delle immagini che guardi online sono state generate da un’IA per addestrare un’altra IA? E se la risposta minasse il concetto stesso di privacy?

Modelli come Falcon Perception si allenano su milioni di immagini raccolte dal web, organizzate tramite clustering gerarchico. Ciò che vedono viene descritto da modelli visione-linguaggio, producendo descrizioni dense categorizzate per complessità. Per evitare allucinazioni, il sistema estrae negativi difficili da questi stessi dati. Ma il passo successivo è più radicale: creare interi universi sintetici.

Il mondo parallelo ha già il suo motore

Holo3 è addestrato per eseguire flussi di lavoro reali all’interno di ambienti aziendali sintetici. Il suo volano di Holo3 utilizza dati di navigazione sintetici generati da istruzioni umane. Applica aumento fuori dominio in Holo3 per estendere gli scenari. E impiega un apprendimento per rinforzo di Holo3 curato con filtraggio avanzato dei dati. La Synthetic Environment Factory di Holo3 riproduce fedelmente la realtà dei sistemi aziendali. I suoi compiti verificabili in Holo3 sono di varia difficoltà. Le performance sono misurate su H Corporate Benchmarks di Holo3, una suite di 486 compiti realistici.

E su hub aperti come Hugging Face questi modelli trovano casa, mentre le big tech recintano l’innovazione. Il paradosso è proprio qui: l’open source diventa il veicolo per diffondere tecnologie che, per loro natura, sfuggono a qualsiasi controllo democratico.

Chi scrive le leggi della simulazione?

Quando l’addestramento avviene in ambienti sintetici, chi decide le regole del gioco? Le aziende che sviluppano questi modelli definiscono i parametri della realtà simulata. E lo fanno su scale che i regolatori faticano anche solo a immaginare.

Il GDPR e le norme sulla privacy si basano su un principio semplice: i dati personali appartengono agli individui. Ma come si applica a dati sintetici generati da un’IA che ha assimilato milioni di tracce digitali? Tecnicamente, non ci sono volti reali o nomi veri. Eppure, le dinamiche sociali, le abitudini, persino i pregiudizi vengono riprodotti e amplificati.

E il bypass delle normative è quasi perfetto.

Non solo: questi ambienti sintetici sono progettati per essere iper-realistici, ma completamente controllati dalle corporazioni. La Synthetic Environment Factory non è un laboratorio neutro: è uno strumento per creare mondi paralleli dove le aziende possono testare prodotti, strategie di marketing, persino strumenti di sorveglianza, senza mai confrontarsi con il rumore e l’imprevedibilità del mondo reale.

Trasparenza: accesso negato

Il rischio più sottile è l’erosione della trasparenza. Un modello addestrato su dati reali può essere esaminato, magari con difficoltà, ma i suoi input sono riconducibili a fonti verificabili. Un modello addestrato in una simulazione risponde a logiche che esistono solo nel codice proprietario.

Cosa succede quando le decisioni che influenzano la nostra vita – dall’accesso al credito alla selezione del personale – saranno prese da AI che hanno imparato in universi fabbricati? E chi sarà responsabile quando queste decisioni rifletteranno distorsioni inscritte nella simulazione stessa?

I regolatori antitrust dovrebbero preoccuparsi: il controllo su questi ambienti sintetici potrebbe diventare il prossimo campo di battaglia per il dominio del mercato. Se la realtà in cui si addestrano le AI è di proprietà di poche aziende, il mondo parallelo che ne emergerà sarà inevitabilmente modellato a loro immagine.

Stiamo costruendo una fabbrica di sintesi che produce non solo intelligenza artificiale, ma intere dimensioni alternative. Dimensioni senza privacy, senza diritti, senza possibilità di appello.

La domanda finale è: siamo ancora in tempo a chiedere di chi è questo mondo?